Investoren haben in einem einzigen Jahr 6,1 Milliarden Dollar in humanoide Roboter gesteckt – viermal so viel wie im Vorjahr. Dieser Kapitalzufluss kam nicht von besseren Motoren oder billigeren Aktuatoren. Er kam von einem grundlegenden Durchbruch in der Art, wie Roboter lernen, der seit 2015 leise heranwuchs und jetzt den Science-Fiction-Roboter in ein plausibles technisches Ziel verwandelt hat.

- Warum Roboterlernen nach 2015 alles veränderte

- Von Regeln zu Reinforcement: Die Simulations-Ära

- Wie Foundation Models Robotern gesunden Menschenverstand gaben

- Die Grenzen, die die Branche noch zurückhalten

- Was das für Roboterkäufer und den Hardware-Markt bedeutet

- Häufig gestellte Fragen

Warum Roboterlernen nach 2015 alles veränderte

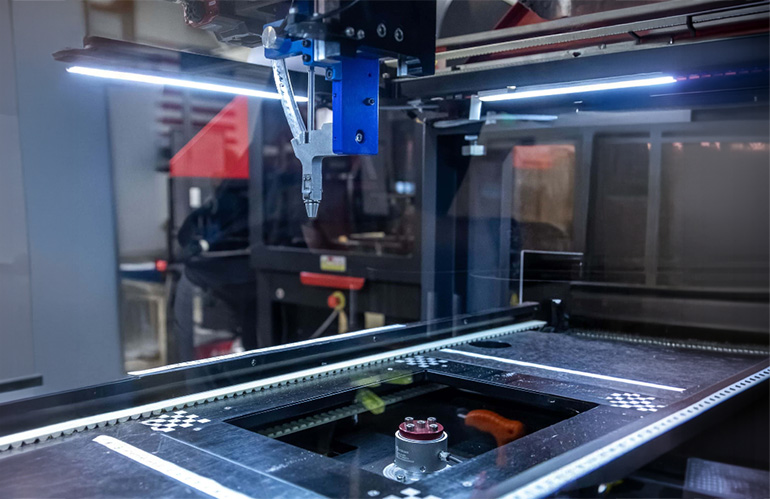

Den größten Teil der Robotikgeschichte bedeutete Intelligenz Regeln – tausende von handcodierten Anweisungen, die Ingenieure für jede vorstellbare Situation schrieben. Ein Roboterarm, der Wäsche faltet, brauchte explizite Logik für Ärmelausrichtung, Stoffsteifigkeit, Kragendetektion und Dutzende von Randfällen. Das Regelwerk explodierte in der Komplexität, bevor es je zuverlässig wurde.

Dieser Ansatz lieferte zuverlässige Industrieroboter für strukturierte Umgebungen – Schweißstraßen, Pick-and-Place-Zellen, Fördersysteme – aber er konnte nicht verallgemeinern. Bewege denselben Arm in einen anderen Kontext, ändere die Beleuchtung, bringe eine neue Objektform ein, und die Leistung brach sofort ein.

Die Kluft zwischen dem, was Roboter konnten, und dem, wovon Forscher träumten, blieb hartnäckig groß. Dann, um 2015, änderte sich die Methodik.

Laut einem tiefgehenden Artikel des MIT Technology Review zur zeitgenössischen Geschichte des Roboterlernens war die entscheidende Veränderung der Wechsel von der Kodierung von Regeln zu datengetriebenem Trial-and-Error – und dann, nach 2022, zu KI-Foundation-Modellen, die aus Internet-großen Daten lernten, anstatt aus handgefertigten Simulationen allein.

Von Regeln zu Reinforcement: Die Simulations-Ära

Um 2015 herum begannen führende Robotiklabore, handgeschriebene Regeln durch Bestärkendes Lernen (Reinforcement Learning, RL) zu ersetzen – eine Trainingsmethode, bei der ein KI-Agent Belohnungssignale für erfolgreiche Aktionen und Bestrafungssignale für Misserfolge erhält und dann millionenfach iteriert, um eigene Strategien zu entdecken.

OpenAIs Dactyl-Projekt, eine fünf-fingrige Roboterhand, die vollständig in der Simulation trainiert wurde, zeigte sowohl die Stärke als auch die zentrale Einschränkung dieses Ansatzes. Dactyl lernte, kleine Würfel zu manipulieren, indem es in digitalen Umgebungen – im Wesentlichen einer virtuellen Physik-Engine – trainierte, bevor es auf echter Hardware eingesetzt wurde. Das Problem: Selbst geringe Abweichungen zwischen der simulierten Welt und der physischen Realität ließen die Leistung stark nachlassen.

Die technische Lösung war Domain Randomisation – das absichtliche Einführen zufälliger Variationen in Millionen von simulierten Trainingsumgebungen. Reibungskoeffizienten, Lichtverhältnisse, Objektfarben und Oberflächentexturen wurden alle zufällig variiert, sodass die trainierte Policy robust genug war, um die Unordentlichkeit der realen Welt zu bewältigen. Die Technik funktionierte gut genug, dass Dactyl schließlich Rubiks Würfel löste – allerdings nur zu 60 % bei normalen Scrambles und zu 20 % bei schwierigeren Konfigurationen.

Diese Zahlen sind wichtig, um zu verstehen, wo das Feld damals stand. Simulationstrainiertes RL erzeugte beeindruckende Fingerfertigkeit, aber die Zuverlässigkeit reichte nicht für den kommerziellen Einsatz. OpenAI schloss seine Robotikabteilung 2021, was die Grenze widerspiegelte, die die Technik erreicht hatte.

Die Simulations-zu-Realität-Lücke: Wichtigste technische Herausforderungen

| Herausforderung | Beschreibung | Angewandte Minderung |

|---|---|---|

| Visuelle Diskrepanz | Farben und Texturen unterscheiden sich von der Simulation | Domain Randomisation |

| Physikalische Eigenschaften | Reibung, Verformung nicht perfekt modelliert | Randomisierte Physikparameter |

| Sensorrauschen | Echte Sensoren führen Latenz und Fehler ein | Rauschinjektion im Training |

| Mechanischer Verschleiß | Aktuatoren degradieren mit der Zeit | Nicht durch Sim-to-Real allein gelöst |

Wie Foundation Models Robotern gesunden Menschenverstand gaben

Die Einführung großer Sprachmodelle veränderte die Robotik grundlegender als jeder Hardwarefortschritt des letzten Jahrzehnts. Die entscheidende Einsicht war architektonisch: LLMs lernen, indem sie vorhersagen, welches Token (Wort, Unterwort oder Zeichen) als nächstes in einer Sequenz kommt, und dabei riesige Textkorpora aufnehmen, um reichhaltige interne Repräsentationen von Sprache und Weltwissen aufzubauen. Robotiker stellten eine offensichtliche, aber transformative Frage – könnte dieselbe Architektur funktionieren, wenn die Tokens stattdessen Sensorablesungen, Kamerabilder und Gelenkpositionen wären?

Google DeepMinds Antwort war RT-1 und sein Nachfolger RT-2 (Robotic Transformer). RT-1 wurde auf 17 Monaten Teleoperationsdaten trainiert, die 700 verschiedene Aufgaben abdeckten. Er erhielt Kameraansichten und Arm-Gelenkzustände als Eingaben und erzeugte Motorbefehle als Ausgaben. Bei Aufgaben, die er während des Trainings gesehen hatte, erreichte er 97 % Erfolg. Bei völlig neuen Anweisungen schaffte er immer noch 76 % – eine dramatische Verbesserung gegenüber allem, was reine Simulationsansätze erreicht hatten.

RT-2 ging noch weiter, indem er Internet-große Bild- und Textdaten einbezog und dem Roboter eine Art gesunden Menschenverstand gab, der in der breiteren visuellen Welt verankert war, nicht nur im Robotiklabor. Dies ist der konzeptionelle Sprung: Anstatt Roboter mit Regeln zu programmieren oder sie nur auf roboterspezifischen Daten zu trainieren, entdeckten Forscher, dass allgemeines Weltwissen – die Art, die in Vision-Language-Modellen während des Web-großen Vortrainings eingebrannt wird – überraschend gut auf physische Manipulationsaufgaben übertragbar ist.

Die praktische Auswirkung ist bedeutend. Ein Roboter, der während des Vortrainings Millionen von Bildern von Küchen, Schubladen und Tassen gesehen hat, hat kontextuelles Verständnis, das regelbasierte Systeme nie erlangen könnten. Er ist sich nicht sicher, welche Tasse der Mensch will, aber er hat eine vernünftige Vorannahme. Diese Vorannahme reduziert drastisch die Menge an roboterspezifischen Trainingsdaten, die erforderlich sind, um brauchbare Leistungsniveaus zu erreichen.

Die Grenzen, die die Branche noch zurückhalten

Die derzeitige Aufregung ist real, aber es lohnt sich, zu kartieren, was wirklich ungelöst bleibt. Foundation Models für Robotik haben ein Datenproblem, das es für Sprachmodelle in dieser Form nicht gibt. Textdaten sind reichlich vorhanden, billig und leicht aus dem Web zu scrapen. Hochwertige Roboterdemonstrationsdaten – vielfältig, physisch fundiert und genau gekennzeichnet – sind teuer zu sammeln, hardwareabhängig und schwer zwischen verschiedenen Roboter-Morphologien zu übertragen.

Frühe soziale Roboter veranschaulichen eine andere Einschränkung: Fähigkeit ohne Zuverlässigkeit. Jibo, der am MIT entwickelte soziale Haushaltsroboter, der 3,7 Millionen Dollar Crowdfunding einbrachte und für 749 Dollar verkauft wurde, hatte eine überzeugende Vision, wurde aber letztlich durch die vor-LLM-Sprachtechnologie seiner Zeit untergraben. Seine Unterhaltungen stützten sich auf skriptbasierte Antwort-Schnipsel, die sich schnell repetitiv und oberflächlich anfühlten. Die heutige Sprach-KI würde verwandeln, was Jibo hätte sein können – aber die neue Generation von KI-gestütztem Spielzeug birgt das gegenteilige Risiko. Skriptbasierte Systeme konnten nicht aus der Spur geraten; generative KI-Systeme können das definitiv, wie dokumentierte Fälle von KI-Begleitern, die Kindern gefährliche Anweisungen gaben, gezeigt haben.

Das Feld hat eine Reihe von Einschränkungen (Starrheit, Sprödigkeit) gegen eine andere (Unberechenbarkeit, Sicherheitsunsicherheit) eingetauscht. Kein Problem ist vollständig gelöst. Was sich geändert hat, ist, dass die Verbesserungskurve jetzt messbar steiler ist.

Was das für Roboterkäufer und den Hardware-Markt bedeutet

Die KI-Lernrevolution ist nicht nur eine akademische Geschichte – sie formt bereits Hardwarebewertungen in einer Weise, die für Käufer und Betreiber jetzt relevant ist.

Roboter, deren Fähigkeiten an ihre ursprüngliche Programmierung gebunden waren, verlieren im aktuellen Markt schnell an Wert. Industriearme der zweiten Generation mit festen Bewegungsprogrammen haben sinkende Wiederverkaufswerte, da Käufer zunehmend Anpassungsfähigkeit erwarten. Gleichzeitig behalten Hardwareplattformen, die für lernbasierte Software ausgelegt sind – mit zugänglicher Rechenleistung, offenen APIs und ausreichenden Sensorlasten – ihren Wert robuster.

Für Käufer, die heute eine Anschaffung evaluieren, ergeben sich mehrere Implikationen:

- Die Erweiterbarkeit der Plattform ist genauso wichtig wie die aktuelle Leistungsfähigkeit. Ein Cobot, der modernes ML-Inferencing lokal ausführt, wird eine längere Nutzungsdauer haben als einer, der an herstellerspezifische Programmierumgebungen gebunden ist.

- Die Preisgestaltung gebrauchter Hardware spiegelt die KI-Bereitschaft wider. Roboter von Plattformen, die größere lernbasierte Software-Updates erhalten haben, behalten ihren Wert; diejenigen, die von ihren Herstellern zurückgelassen wurden, werden erheblich abgezinst.

- Dateninfrastruktur ist der neue Differenzierer. Käufer, die mehrere Einheiten einsetzen, sollten von Anfang an Teleoperationsdatenerfassung planen – diese Demonstrationsdaten werden zum Trainingskorpus für verbesserte Leistung.

Für Betreiber, die einen Einstieg in den Einsatz erwägen, bietet der aktuelle Markt für gebrauchte Industrieroboter Zugang zu leistungsfähiger Hardware zu reduzierten Kosten, wobei Käufer die Software-Upgrade-Fahrpläne sorgfältig prüfen sollten. Ebenso ist die wachsende Kategorie der Cobots besonders gut positioniert, um von der Einführung von Foundation Models zu profitieren, angesichts der inhärent flexiblen, menschennahen Betriebskontexte von Cobots.

Häufig gestellte Fragen

Der Haupttreiber war die Reifung von KI-Foundation-Modellen – insbesondere die Entdeckung, dass Vision-Language-Modelle, die auf Internet-großen Daten trainiert wurden, angepasst werden konnten, um Roboter-Motorbefehle mit weitaus größerer Generalisierungsfähigkeit zu erzeugen als frühere regelbasierte oder simulationsonly-Ansätze. Die Investitionen stiegen, nachdem Forschungen zeigten, dass Modelle wie RT-2 neuartige Aufgaben ohne aufgabenspezifisches Training ausführen konnten, was einen glaubwürdigen Weg zu Allzweckrobotern eröffnete. Aktuelle Zahlen zeigen, dass sich die Investitionen im Jahresvergleich vervierfacht haben und 6,1 Milliarden Dollar erreichten.

Was ist Domain Randomisation in der Robotik und warum ist sie wichtig?

Domain Randomisation ist eine Simulationstrainings-Technik, bei der während des Trainings Tausende von leicht unterschiedlichen virtuellen Umgebungen erzeugt werden – die Beleuchtung, Reibung, Objektfarben und Physikparameter werden zufällig variiert. Sie adressiert die Sim-to-Real-Lücke (die Leistungsverschlechterung, wenn simulationstrainierte Policys auf physischer Hardware ausgeführt werden), indem sie die gelernte Policy zwingt, über viele mögliche Weltkonfigurationen robust zu sein. OpenAIs Dactyl verwendete diesen Ansatz, um das Lösen von Rubiks Würfeln mit einer Roboterhand zu erreichen, obwohl die Erfolgsraten bei 60 % für normale Schwierigkeitsgrade ein Plateau erreichten.

Wie unterscheiden sich Foundation Models für Robotik von Standard-LLMs?

Standard Large Language Models verarbeiten Text-Tokens sowohl als Eingabe als auch als Ausgabe. Robotik-Foundation-Modelle erweitern diese Architektur, um Kamerabilder, Tiefensensorablesungen und Roboter-Gelenkpositionen als zusätzliche Eingabe-Tokens zu behandeln und Motorgeschwindigkeitsbefehle als Ausgabe-Tokens. Die Kernvorhersageaufgabe – „Was kommt als nächstes, gegeben den vorherigen Kontext?“ – bleibt strukturell ähnlich. Der entscheidende Vorteil ist, dass das Vortraining auf Internet-großen visuellen und Sprachdaten diesen Modellen Weltwissen und gesunden Menschenverstand verleiht, den reine Roboterdemonstrationsdaten nicht effizient bereitstellen können.

Werden KI-adaptive Roboter ältere festprogrammierte Roboter schnell obsolet machen?

Nicht sofort. Festprogrammierte Industrieroboter bleiben für Aufgaben mit hohem Volumen und geringer Variation wie Schweißen und Stanzen, wo Anpassungsfähigkeit keinen Mehrwert bietet, äußerst kosteneffizient. Der Druck der Obsoleszenz ist am höchsten in der Logistik mit gemischten SKUs, der leichten Montage und in Serviceumgebungen, wo Aufgabenvarianz inhärent ist. Käufer sollten evaluieren, ob ihr spezifisches Aufgabenprofil tatsächlich von Anpassungsfähigkeit profitiert, bevor sie annehmen, dass neuere KI-fähige Plattformen den Preisaufschlag gegenüber bewährter Legacy-Hardware rechtfertigen.

Was sind die wichtigsten ungelösten Probleme im Roboterlernen heute?

Drei Herausforderungen bleiben bedeutend: (1) die hohen Kosten und die begrenzte Verfügbarkeit vielfältiger Roboterdemonstrationsdaten im Vergleich zu Textdaten für Sprachmodelle; (2) die Sicherheitsunberechenbarkeit generativer KI-Systeme, die in physischen Umgebungen eingesetzt werden, insbesondere solcher, die mit gefährdeten Bevölkerungsgruppen interagieren; und (3) zuverlässige geschickte Manipulation – feinmotorische Aufgaben wie das Einfädeln von Kabeln oder das Handhaben von verformbaren Materialien überfordern die meisten derzeitigen Systeme unter realen Bedingungen, im Gegensatz zu kontrollierten Laboreinstellungen.

Die Robotik-Lernrevolution ist real, aber nicht abgeschlossen. Foundation Models haben die Decke zerschlagen, die regelbasierte Systeme auferlegten, und die Investitionszahlen spiegeln echten technologischen Fortschritt wider, nicht reine Spekulation. Die Kluft zwischen Science-Fiction-Robotern und einsetzbarer Hardware hat sich in den letzten drei Jahren mehr verringert als in den vorangegangenen drei Jahrzehnten.

Der nächste Engpass ist nicht algorithmisch. Es sind Daten, Sicherheitsvalidierung und Hardwarezuverlässigkeit in der Breite – die harten Ingenieurprobleme, die Finanzierung allein nicht über ein bestimmtes Tempo hinaus beschleunigen kann.

Welcher Lernansatz – Reinforcement Learning, Foundation Models oder Teleoperationsdaten – wird Ihrer Meinung nach darüber entscheiden, wer das Rennen um die Humanoiden gewinnt?

Beteilige dich an der Diskussion

Which robot learning approach — RL, foundation models, or teleoperation data — will determine who wins the humanoid race?