Der Tastsinn ist der Sinn, der humanoide Roboter zurückhält – und ein neuer graphenbasierter Tastsensor der University of Cambridge könnte die glaubwürdigste Lösung sein. Veröffentlicht in Nature Materials, erkennt das Gerät in Echtzeit 3D-Kraftvektoren, Oberflächentextur und Objektschlupf mit einer räumlichen Auflösung, die mit menschlichen Fingerspitzen konkurriert. Für humanoide Plattformen wie Figure, Apptronik und Tesla Optimus war diese Lücke lange der stille Begrenzer für geschickte Manipulation.

- Warum der Tastsinn der am schwierigsten zu entwickelnde Sinn für Roboter ist

- Wie der Graphen-Tastsensor tatsächlich funktioniert

- Benchmark-Leistung: Wie schneidet er ab?

- Was das für humanoide Roboter und Cobots bedeutet

- Was das für Robotik-Käufer und Entwickler bedeutet

- Häufig gestellte Fragen

Warum der Tastsinn der am schwierigsten zu entwickelnde Sinn für Roboter ist

Die meisten Robotersysteme können mit millimetergenauer Präzision sehen und sich mit submillimetergenauer Wiederholbarkeit bewegen. Doch sobald sie ein rohes Ei handhaben, ein Etikett abziehen oder ein Kabel einfädeln müssen – Aufgaben, die jedes Menschenkind instinktiv bewältigt – versagen sie. Der Grund ist taktile Blindheit.

Menschliche Finger tragen vier verschiedene Mechanorezeptortypen (SA1, SA2, FA1, FA2), die jeweils auf unterschiedliche Reize abgestimmt sind: anhaltenden Druck, Hautdehnung, Vibration und feine Textur. Zusammen erzeugen sie einen kontinuierlichen, hochbandbreitigen Strom multidimensionaler Daten, die das Gehirn nutzt, um die Greifkraft in Millisekunden zu modulieren. Aktuelle Roboter-Greifer haben nichts Vergleichbares.

Professor Tawfique Hasan, der das Cambridge-Forschungsteam leitete, bringt das Problem auf den Punkt: „Die meisten existierenden taktilen Sensoren sind entweder zu sperrig, zu zerbrechlich, zu komplex in der Herstellung oder nicht in der Lage, normal und tangentiale Kräfte genau zu unterscheiden. Dies war ein großes Hindernis für eine wirklich geschickte Roboter-Manipulation.“

Diese Einschränkung ist in jeder heutigen Demo humanoider Roboter sichtbar. Figure 02, Apptronik Apollo und Tesla Optimus beeindrucken alle in sorgfältig inszenierten Manipulationsaufgaben – aber wenn man genau hinsieht, erkennt man dieselbe Kompensationsstrategie: langsame, übermäßig vorsichtige Griffe, übermäßige Druckkraft, um Fallenlassen zu vermeiden, und nahezu keine Fähigkeit, auf unerwarteten Schlupf zu reagieren. Die Hände sind leistungsfähig. Die Haut ist es nicht.

Wie der Graphen-Tastsensor tatsächlich funktioniert

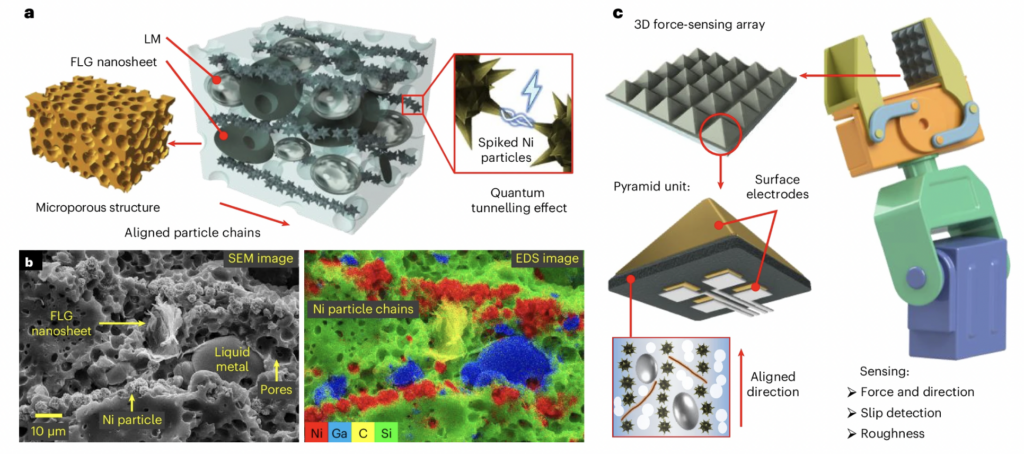

Der Cambridge-Sensor löst dieses Problem durch eine Kombination aus Materialwissenschaft und bioinspirierter Geometrie. Das Kernmaterial ist ein weicher Verbundstoff: Graphenblätter, verformbare Flüssigmetall-Mikrotröpfchen und Nickelpartikel, suspendiert in einer Silikonelastomer-Matrix. Wenn sich das Material unter Kontakt verformt, ändert sich seine elektrische Leitfähigkeit – und diese Änderungen kodieren Kraftinformationen.

Der Durchbruch liegt in der Geometrie. Der Verbundstoff wird zu winzigen pyramidenförmigen Mikrostrukturen geformt, einige nur 200 Mikrometer groß (etwa der doppelte Durchmesser eines menschlichen Haares). Diese Form ist bewusst von der Mikroarchitektur der menschlichen Haut übernommen, wo gerippte Strukturen mechanische Spannung an lokalisierten Punkten konzentrieren. Die Pyramidenspitzen tun dasselbe künstlich – sie verstärken die Spannungskonzentration, machen den Sensor empfindlich für extrem niedrige Kräfte und behalten gleichzeitig einen weiten Messbereich.

Unter jeder Pyramide erfassen vier Elektroden unabhängige elektrische Signale. Durch den Vergleich der relativen Größen dieser vier Messwerte rekonstruiert der Sensor mathematisch den vollständigen 3D-Kraftvektor – unterscheidet Normalkraft (direktes Drücken) von Scherkräften (seitliches Gleiten) – in Echtzeit. Diese Scherkraft-Erkennung ermöglicht die Schlupfvorhersage: Der Sensor erkennt den Beginn einer Objektbewegung, bevor der Griff tatsächlich versagt, und ermöglicht so das proaktive Anwenden von Korrekturkräften.

Auf kleineren Skalen können Arrays dieser Sensoren auch Oberflächentexturinformationen extrahieren und Objekteigenschaften – Masse, Geometrie und Materialdichte – allein aus den Kraftsignalmustern identifizieren, ohne dass Vorkenntnisse über das Objekt erforderlich sind.

Benchmark-Leistung: Wie schneidet er ab?

Die veröffentlichten Daten des Cambridge-Teams in Nature Materials positionieren den Sensor als einen bedeutenden Schritt über den aktuellen Stand der Technik hinaus. Die Kernaussage: Das neue Gerät verbessert bestehende flexible taktile Sensoren um etwa eine Größenordnung sowohl bei der minimal erfassbaren Kraft als auch beim Sensor-Fußabdruck.

| Metrik | Typische flexible taktile Sensoren | Cambridge Graphen-Sensor |

|---|---|---|

| Minimale Merkmalsgröße | ~2.000–5.000 µm | ~200 µm |

| Krafterfassungsfähigkeit | Millinewton-Bereich | Erkennt ein Sandkorn |

| Kraftdimensionalität | Nur Normalkraft (meistens) | Vollständiger 3D-Vektor (normal + Scherung) |

| Schlupferkennung | Nach dem Schlupf (reaktiv) | Vor dem Schlupf (prädiktiv) |

| Fertigungskomplexität | Hoch (Optik oder starre Strukturen) | Weicher Verbundstoff, keine Optik |

| Skalierbarkeitsziel | Begrenzt | Unter 50 µm (zukünftig) |

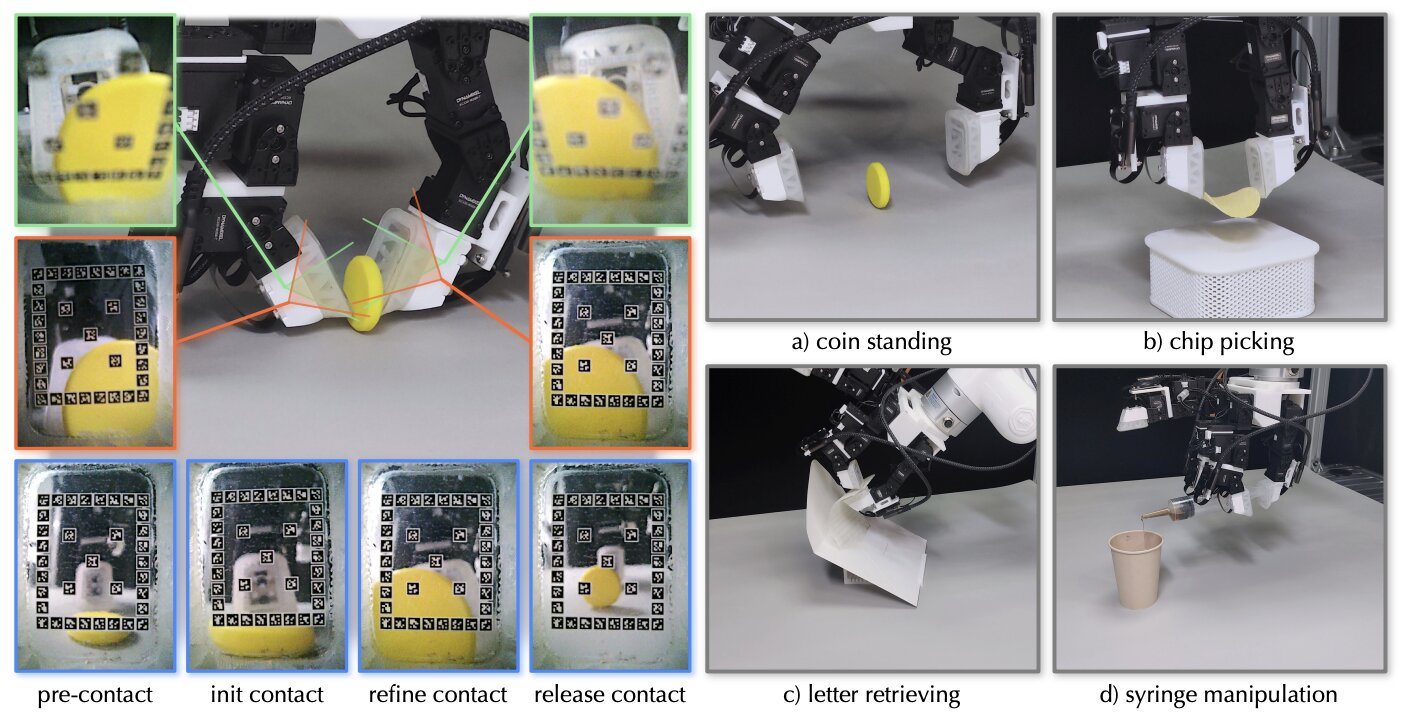

Der Sensor wurde in Demonstrationen mit Roboter-Greifern validiert, wo er Robotern ermöglichte, dünne Papierröhren zu greifen – Objekte, die unter jeder nennenswerten überschüssigen Kraft zerquetscht werden – ohne Beschädigung. Diese Art von Aufgabe erfordert eine Kraftregelung im Sub-Newton-Bereich, die in Echtzeit kalibriert wird. Herkömmliche Sensoren, die auf vorprogrammierten Annahmen über Objekteigenschaften beruhen, können dies nicht adaptiv leisten.

Was das für humanoide Roboter und Cobots bedeutet

Dieser Sensor löst nicht allein die Geschicklichkeit humanoider Roboter – aber er adressiert den hartnäckigsten Hardware-Engpass im Stack. Die visuelle Manipulation, der derzeitige Ausweichansatz der meisten humanoiden Plattformen, hat grundlegende physikalische Grenzen. Kamera-Latenz, Okklusion während des Kontakts und die Unfähigkeit, innere Greifkräfte zu erfassen, bedeuten, dass selbst die besten Vision-Language-Action-Modelle teilweise blind fliegen, sobald die Fingerspitzen ein Objekt berühren.

Eine taktile Haut mit prädiktiver Schlupferkennung und 3D-Kraftauflösung ändert die Rückkopplungsschleife vollständig. Anstatt auf einen Fall zu reagieren, nachdem er passiert ist, kann ein Roboter die Vektorverschiebung, die einen bevorstehenden Schlupf anzeigt, erkennen und im selben Steuerungszyklus korrigierendes Drehmoment anwenden. Für Aufgaben wie das Falten von Wäsche, das Handhaben von Glaswaren, das Montieren kleiner Komponenten oder die Unterstützung von Patienten im Gesundheitswesen ist dieser Unterschied die Grenze zwischen einsatzbereit und nicht einsatzbereit.

Auch die Miniaturisierungs-Roadmap ist hier wichtig. Das Team berichtet einen Weg zu Sensor-Merkmalen unter 50 Mikrometern – annähernd an die Mechanorezeptordichte menschlicher Haut – mit potenzieller Integration von Temperatur- und Feuchtigkeitssensorik in zukünftigen Iterationen. Diese Entwicklung stellt diese Arbeit auf einen glaubwürdigen Weg zu einer vollständigen künstlichen Haut für humanoide Hände, nicht nur zu isolierten Fingerspitzensensoren.

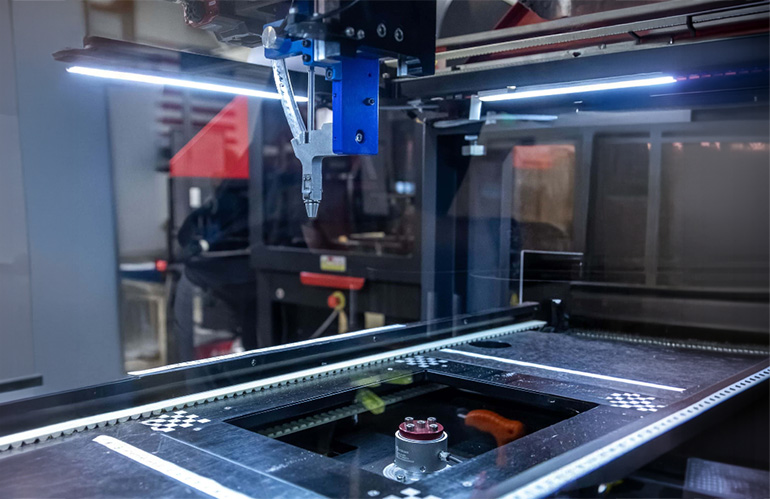

Für kollaborative Roboter (Cobots) sind die Auswirkungen ähnlich signifikant. Kraftsensitive Manipulation ist bereits ein Verkaufsargument für Plattformen wie die Universal Robots UR-Serie und die FANUC CRX-Linie, aber aktuelle Implementierungen erfassen aggregierte Handgelenkskräfte, nicht lokalisierte taktile Ereignisse an der Kontaktfläche. Sensoren wie dieser könnten pro Finger, pro Kontaktpunkt Daten auf Cobot-Greiferebene ermöglichen. Wenn Sie gebrauchte Cobots zum Verkauf für Montage- oder Inspektionsaufgaben evaluieren, ist dies die Fähigkeitsrichtung, die Sie im Auge behalten sollten.

Was das für Robotik-Käufer und Entwickler bedeutet

Für Entwickler und Käufer humanoider Roboter signalisiert diese Forschung, dass taktile Sensorik sich von einer akademischen Kuriosität zu einem kurzfristigen Hardware-Bestandteil entwickelt. Ein Patent wurde über Cambridge Enterprise eingereicht, was bedeutet, dass die Kommerzialisierung ein aktives Ziel ist, kein spekulatives Ergebnis. Es wurden keine Lizenz- oder kommerziellen Zeitpläne bekannt gegeben, aber die Beteiligung von ARIA (der britischen Advanced Research and Invention Agency) deutet darauf hin, dass eine Produktion im Maßstab in Betracht gezogen wird.

Für Integratoren von Cobots und Industriegreifern ist die Kombination aus 3D-Kraftvektor und Schlupferkennung sofort relevant für jede Präzisionsmontage, Handhabung medizinischer Geräte oder Lebensmittelverarbeitung, bei der die Griffsteuerung derzeit eine kundenspezifische Vorrichtung oder langsame, konservative Bewegungsprofile erfordert.

Für Prothetik-Entwickler weist das Papier explizit auf taktiles Feedback für fortschrittliche künstliche Gliedmaßen als direkten Anwendungspfad hin. Dieselbe miniaturisierte, hautförmige Sensorik, die Roboterhänden zugutekommt, könnte Prothesenträgern bedeutungsvolles taktiles Feedback zurückgeben – ein bedeutender sekundärer Markt für diese Technologie.

Die Forschung wurde unterstützt von der Royal Society, dem Henry Royce Institute und ARIA. Das Papier – Multiscale-structured miniaturized 3D force sensors – ist in Nature Materials (2026) veröffentlicht. Für Teams, die humanoide Roboter auf Botmarket evaluieren, ist die taktile Sensorik jetzt eine Überlegung wert, die in jede Hardware-Bewertungsmatrix aufgenommen werden sollte.

Häufig gestellte Fragen

Der Sensor ist ein weicher, flexibler Verbundstoff aus Graphen, Flüssigmetall-Mikrotröpfchen und Nickelpartikeln, geformt zu 200-Mikrometer-pyramidenförmigen Mikrostrukturen auf einem Silikonsubstrat. Er erkennt gleichzeitig Normalkraft, Scherkraft, 3D-Kraftvektoren, Oberflächentextur und Objektschlupf – Fähigkeiten, die der multidimensionalen Wahrnehmung menschlicher Fingerspitzen sehr nahe kommen.

Wie schneidet dieser Sensor im Vergleich zu bestehenden taktilen Robotersensoren ab?

Laut dem Nature Materials-Papier verbessert der Cambridge-Sensor bestehende flexible taktile Sensoren um etwa eine Größenordnung sowohl bei der minimal erfassbaren Kraft als auch bei der räumlichen Auflösung. Er fügt außerdem prädiktive Schlupferkennung und 3D-Kraftvektor-Rekonstruktion hinzu – Fähigkeiten, die die meisten kommerziellen Sensoren entweder gar nicht oder nur schlecht approximieren.

Wann wird dieser Graphen-Tastsensor in kommerziellen Robotern verfügbar sein?

Es wurde kein kommerzielles Veröffentlichungsdatum bekannt gegeben. Ein Patentantrag wurde über Cambridge Enterprise, den Kommerzialisierungsarm der University of Cambridge, eingereicht, was auf eine aktive Verfolgung von Lizenzierung oder Ausgründung hindeutet. Unterstützt durch ARIA scheint die Technologie auf eine Produktion im Maßstab abzuzielen, aber typische Zeitpläne von akademischer Patentanmeldung bis zur kommerziellen Einführung liegen für Sensor-Hardware zwischen 3–7 Jahren.

Warum ist Schlupferkennung für die Geschicklichkeit humanoider Roboter wichtig?

Schlupferkennung – insbesondere die prädiktive Schlupferkennung, die den Beginn einer Bewegung erkennt, bevor ein Griff versagt – ermöglicht es einem Roboter, in Echtzeit Korrekturkräfte anzuwenden, anstatt zu reagieren, nachdem ein Objekt bereits gefallen ist. Ohne sie müssen Roboter übermäßige Griffkraft als Sicherheitspuffer verwenden, was das Handhaben zerbrechlicher oder verformbarer Objekte verhindert. Dies ist ein direkter Engpass für humanoide Plattformen, die unstrukturierte Manipulationsaufgaben versuchen.

Könnte dieser Sensor in Prothesenhänden verwendet werden?

Ja. Die Cambridge-Forscher identifizieren explizit fortschrittliche Prothetik als Anwendungspfad. Dieselbe miniaturisierte 3D-Kraftmessung, die Robotergreifern zugutekommt, könnte taktiles Feedback an Prothesenträger zurückgeben und so die Griffkontrolle, das Sicherheitsbewusstsein und das Vertrauen der Benutzer bei der Objektinteraktion verbessern.

Was sind die nächsten Entwicklungsschritte für diese Technologie?

Die erklärte Roadmap des Teams umfasst die Miniaturisierung von Sensoren unter 50 Mikrometern – annähernd an die Mechanorezeptordichte der menschlichen Haut – und die Integration von Temperatur- und Feuchtigkeitssensorik in zukünftige Versionen, um sich einer vollständig multimodalen künstlichen Haut anzunähern, anstatt eines rein kraftbasierten Geräts.

Der Graphen-Tastsensor aus Cambridge stellt den technisch glaubwürdigsten Schritt dar, der bisher veröffentlicht wurde, um die taktile Sensoriklücke bei humanoiden und kollaborativen Robotern zu schließen. Er wird nicht in der nächsten Generation humanoider Hände verbaut sein – aber die Entwicklung von diesem Papier zu einem Produktionsbauteil ist klarer als je zuvor.

Wenn Sie heute humanoide Roboter bauen oder kaufen: Wie viel kostet Sie die taktile Blindheit tatsächlich in Ihrer Manipulations-Pipeline?

Beteilige dich an der Diskussion

Is tactile blindness the real ceiling on your robot's manipulation performance — or is it something else?