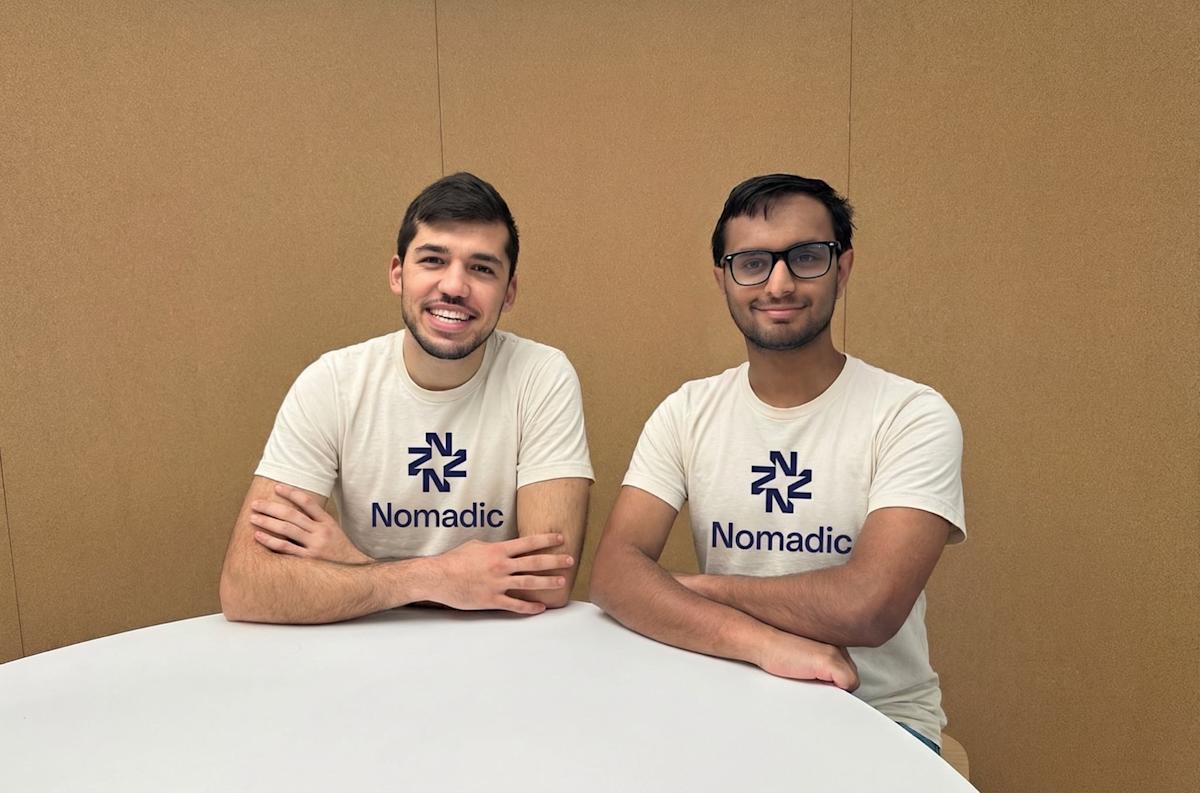

Autonome Fahrzeuge und Roboter produzieren mehr Sensordaten, als die meisten Organisationen tatsächlich nutzen können. Nomadic hat 8,4 Millionen Dollar Seed-Finanzierung eingesammelt, um das zu ändern – und baut eine Infrastrukturschicht auf, die rohes AV- und Robotermaterial mithilfe von Deep Learning in strukturierte, durchsuchbare Datensätze umwandelt. Damit wird ein Engpass adressiert, der leise das Tempo der Entwicklung autonomer Systeme in der gesamten Branche begrenzt.

Inhaltsverzeichnis

- Was macht Nomadic eigentlich?

- Warum sind AV- und Roboter-Daten so schwer zu verwalten?

- Wie funktioniert Nomadics Deep-Learning-Ansatz?

- Was bedeutet das für Robotik und Automatisierung?

- Häufig gestellte Fragen

Was macht Nomadic eigentlich?

Nomadic entwickelt eine Dateninfrastruktur-Plattform, die rohes Video- und Sensormaterial von autonomen Fahrzeugen und Robotern in strukturierte, abfragbare Datensätze umwandelt. Statt dass Rohmaterial ungenutzt im Speicher liegt – teuer in der Aufbewahrung, kaum durchsuchbar – nutzt Nomadics System Deep-Learning-Modelle, um diese Daten zu taggen, zu klassifizieren und zu indizieren, sodass Ingenieure tatsächlich finden, was sie brauchen.

Laut TechCrunch positioniert sich Nomadic mit der 8,4-Millionen-Dollar-Seed-Runde als Infrastruktur für den gesamten Physical-AI-Stack – nicht nur für AV-Programme, sondern für jedes Robotersystem, das kontinuierliche Sensorströme erzeugt, die in Trainingssignale umgewandelt werden müssen.

Stellen Sie sich den Unterschied vor zwischen einem Lagerhaus voller unbeschrifteter Kartons und einem vollständig indexierten Inventarsystem. Das Material existiert in beiden Fällen, aber nur eine Version ist operativ nutzbar. Diese Analogie wird im großen Maßstab brüchig – das Problem mit AV-Daten ist nicht nur die Beschriftung, sondern die schiere Menge in Kombination mit den Kosten menschlicher Annotation und der Seltenheit sicherheitskritischer Grenzfälle, die in Stunden routinemäßigen Materials verborgen sind.

Warum sind AV- und Roboter-Daten so schwer zu verwalten?

Ein einziges autonomes Fahrzeug kann je nach Sensorausstattung (Kameras, LiDAR, Radar, IMU) zwischen 1 und 40 Terabyte Rohdaten pro Tag erzeugen. Eine kleine Flotte von zehn Fahrzeugen im Dauerbetrieb produziert pro Woche mehr Daten, als die meisten Unternehmens-Datenpipelines verarbeiten können.

Das Problem verschärft sich in zwei Richtungen. Erstens steigen die Speicherkosten schnell, wenn Daten im Petabyte-Bereich für Modelltraining, Sicherheitsaudits und regulatorische Prüfungen aufbewahrt werden müssen. Zweitens – und noch wichtiger – ist der Großteil dieser Daten operativ inert: Sie können ohne erheblichen manuellen Beschriftungsaufwand nicht abgefragt, gefiltert oder erschlossen werden.

Für Robotik-Teams entsteht so eine schmerzhafte Rückkopplungsschleife:

- Roboter im Feld einsetzen

- Riesige Mengen an Sensordaten sammeln

- Mühsam die spezifischen Fehlerszenarien, Grenzfälle oder domainspezifischen Ereignisse extrahieren, die zur Verbesserung des Modells nötig sind

- Trainingsiteration verlangsamt sich

- Einsatzleistung stagniert

Manuelle Annotations-Workflows – die traditionelle Lösung – skalieren wirtschaftlich nicht. Die Beschriftungskosten für autonome Fahrdatensätze lagen historisch zwischen 0,05 und 0,50 Dollar pro Frame, und eine einzige Videostunde bei 30fps enthält 108.000 Frames. Die Ökonomie hält Teams aktiv davon ab, die gesamten Datenabfälle ihrer Flotten zu nutzen.

Wie funktioniert Nomadics Deep-Learning-Ansatz?

Nomadics Kernsystem wendet Deep-Learning-Modelle auf Rohmaterial an, um automatisch semantische Struktur aus Sensorströmen zu extrahieren. Anstatt dass Ingenieure Material manuell beschriften müssen, bevor es durchsuchbar wird, erkennt die Plattform, was in einer Szene passiert, taggt Ereignisse und Objekte und organisiert die Ausgabe in abfragbarer Form.

Die praktische Auswirkung ist erheblich: Robotik- und AV-Teams können Abfragen in natürlicher Sprache oder strukturiert stellen – „Zeig mir alle Fälle, in denen sich das Fahrzeug bei Regen unter 2 Metern einem Fußgänger genähert hat“ – und relevante Clips aus Millionen von Stunden Material abrufen, ohne manuelle Durchsicht.

Dieser Ansatz spiegelt wider, was moderne Vektordatenbanken für unstrukturierten Text tun, jedoch angewendet auf multimodale Sensordaten einschließlich Video, Punktwolken und IMU-Ströme. Das Deep-Learning-Modell fungiert als automatische Annotationsschicht, die die Kosten pro beschriftetem Beispiel drastisch senkt, während die Dichte des extrahierbaren Signals aus vorhandenen Daten steigt.

Nomadic vs. traditionelle Datenpipeline-Ansätze

| Ansatz | Annotationskosten | Abfragegeschwindigkeit | Skalierbarkeit | Erkennung von Grenzfällen |

|---|---|---|---|---|

| Manuelle Beschriftung | Hoch (0,05–0,50 $/Frame) | Langsam | Gering | Abhängig vom Prüfer |

| Regelbasiertes Auto-Tagging | Niedrig | Schnell | Mittel | Verpasst neue Ereignisse |

| Nomadic Deep Learning | Niedrig–Mittel | Schnell | Hoch | Stark bei trainierten Kategorien |

| Keine Pipeline (Rohspeicher) | Keine | Keine | Hoch (Kosten) | Null |

Der erwähnenswerte Vorbehalt: Deep-Learning-basierte Annotation erbt alle blinden Flecken, die in der Trainingsverteilung des Modells existieren. Bei seltenen, sicherheitskritischen Grenzfällen – genau den Ereignissen, die für das Training am wertvollsten sind – könnte ein Modell, das nicht genügend Beispiele gesehen hat, sie dennoch nicht zuverlässig identifizieren. Nomadics langfristiges Wertversprechen hängt wahrscheinlich davon ab, wie gut seine Modelle über verschiedene Roboter- und Fahrzeuginstallationen generalisieren.

Was bedeutet das für Robotik und Automatisierung?

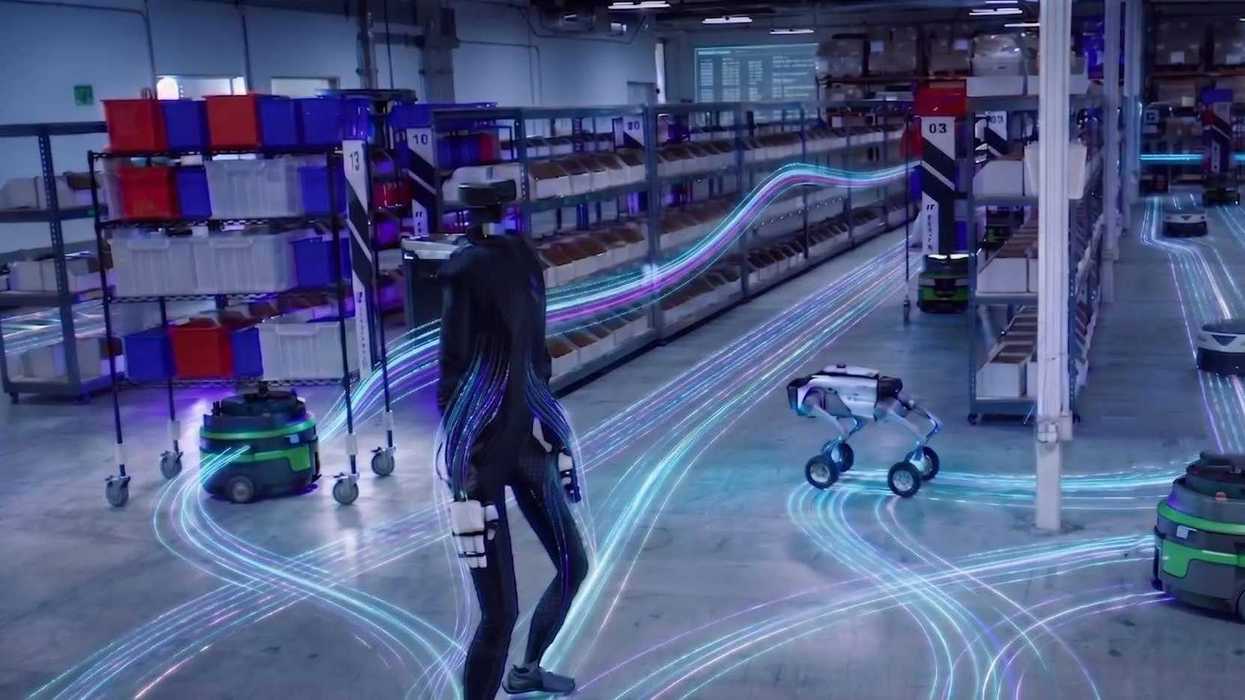

Der Datenengpass, den Nomadic angeht, ist nicht nur auf autonome Fahrzeuge beschränkt. Es ist dasselbe Problem, dem AMRs (autonome mobile Roboter) in Lagern, industrielle Inspektionsroboter, landwirtschaftliche Automatisierungssysteme und humanoiden Roboterprogramme gegenüberstehen – jedes verkörperte KI-System, das in der realen Welt kontinuierlich Wahrnehmungsdaten erzeugt.

Für Teams, die Roboterflotten betreiben oder beschaffen, ist das auf zwei konkrete Arten relevant.

Trainingsgeschwindigkeit: Die Geschwindigkeit, mit der sich ein Robotersystem verbessert, wird direkt dadurch begrenzt, wie schnell Teams aussagekräftige Trainingssignale aus Einsatzdaten extrahieren können. Infrastruktur, die diesen Kreislauf beschleunigt – selbst um den Faktor 2–3 – verkürzt den Verbesserungszeitraum entsprechend.

Flottenintelligenz im Maßstab: Wenn Roboterflotten wachsen, geht der operative Wert dieser Sensordaten über das reine Modelltraining hinaus. Strukturierte Daten ermöglichen Anomalieerkennung, Signale für vorausschauende Wartung und Leistungsbenchmarking über Einheiten hinweg – und verwandeln die Roboterflotte selbst in ein sich kontinuierlich selbst dokumentierendes System.

Für Betreiber, die gebrauchte oder generalüberholte Roboter einsetzen – bei denen die Sensorkonfigurationen variieren können und bestehende Datensätze weniger kuratiert sind – werden Plattformen wie Nomadic besonders relevant. Das Einspeisen von Felddaten von gebrauchten Industrierobotern in strukturierte Trainingspipelines war bisher ein manueller, teurer Prozess. Automatisierte Strukturierungsinfrastruktur ändert diese Rechnung.

Die 8,4 Millionen Dollar Seed-Finanzierung zeigt auch, wohin die Infrastrukturinvestitionen im Physical-AI-Stack fließen. Die Hardware – die Roboter selbst – bekommt die Aufmerksamkeit. Aber die Datenschicht zwischen Einsatz und Modellverbesserung wird zunehmend zum Ort, an dem Wettbewerbsvorteile entstehen und Kapital sich konzentriert.

Betreiber, die gebrauchte Cobots kaufen oder kleine Automatisierungsprogramme aufbauen, sollten die Kosten für Datenpipelines in die Gesamtbetriebskosten einrechnen – eine Frage, die Nomadic direkt für sich zu beantworten versucht.

Häufig gestellte Fragen

Nomadic ist ein Dateninfrastruktur-Unternehmen, das Deep Learning nutzt, um rohes Sensormaterial von autonomen Fahrzeugen und Robotern in strukturierte, durchsuchbare Datensätze umzuwandeln. Es löst das Skalierungsproblem von Daten aus autonomen Systemen – riesige Mengen an Material, die im Feld anfallen, aber ohne teure manuelle Annotation operativ unbrauchbar bleiben.

Wie viele Daten erzeugt ein autonomes Fahrzeug pro Tag?

Ein einzelnes autonomes Fahrzeug erzeugt je nach Kamera-, LiDAR- und Radarkonfiguration typischerweise zwischen 1 und 40 Terabyte Rohdaten pro Tag. Eine Flotte von zehn Fahrzeugen kann wöchentlich hunderte Terabyte anhäufen, was eine manuelle Verarbeitung im großen Maßstab wirtschaftlich untragbar macht.

Wie unterscheidet sich Nomadics Deep-Learning-Ansatz von manueller Beschriftung?

Manuelle Beschriftung kostet zwischen 0,05 und 0,50 Dollar pro Frame, was im Flottenmaßstab unerschwinglich ist. Nomadic wendet Deep-Learning-Modelle an, um Material automatisch zu taggen und zu indizieren, sodass Ingenieure ohne frame-weise menschliche Prüfung über große Datensätze abfragen können – was die Annotationskosten und die Zeit bis zur Erkenntnisgewinnung deutlich reduziert.

Betrifft der Datenengpass auch andere Roboter als autonome Fahrzeuge?

Ja. Jedes verkörperte KI-System – AMRs in Lagern, Inspektionsroboter, landwirtschaftliche Automatisierung, humanoide Plattformen – erzeugt kontinuierliche Sensordaten, die vor denselben Herausforderungen bei Strukturierung und Abruf stehen. Das Problem skaliert mit der Flottengröße und den Betriebsstunden, unabhängig von der spezifischen Roboteranwendung.

Was bedeutet diese Finanzierung für das gesamte Physical-AI-Ökosystem?

Die 8,4-Millionen-Dollar-Seed-Runde signalisiert die wachsende Erkenntnis der Investoren, dass die Dateninfrastrukturschicht – nicht nur die Hardware oder die zentralen KI-Modelle – ein kritischer Engpass bei der Entwicklung autonomer Systeme ist. Infrastrukturinvestitionen in Datenpipelines sind ein Frühindikator für reifende Physical-AI-Einsatzprogramme.

Die Datenabfälle autonomer Systeme waren schon immer enorm. Das fehlende Stück war die Infrastruktur, um sie in nutzbare Signale zu verwandeln. Nomadics Ansatz – Deep Learning als automatische Strukturierungsschicht – adressiert eine Einschränkung, die jede Organisation betrifft, die Roboter oder Fahrzeuge im großen Maßstab einsetzt. Die Seed-Finanzierung wird das Problem nicht über Nacht lösen, aber sie markiert eine klare Richtungsentscheidung, dass die Datenschicht der Ort ist, an dem der nächste Wettbewerbsvorteil in Physical AI entsteht.

Ist die Datenpipeline-Infrastruktur der Engpass, der die Verbesserung Ihrer Roboterflotte begrenzt – oder ist es immer noch die Hardware?

Beteilige dich an der Diskussion

Is data pipeline infrastructure the bottleneck limiting your robot fleet — or is hardware still the constraint?