Kenderaan autonomi dan robot menghasilkan lebih banyak data sensor daripada yang dapat digunakan oleh kebanyakan organisasi. Nomadic telah mengumpul $8.4 juta dalam pembiayaan benih untuk menyelesaikannya — membina lapisan infrastruktur yang menukar rakaman AV dan robot mentah menjadi set data berstruktur dan boleh dicari menggunakan pembelajaran mendalam, menangani kesesakan yang secara senyap mengehadkan kadar pembangunan sistem autonomi di seluruh industri.

Isi Kandungan

- Apa yang Sebenarnya Dilakukan oleh Nomadic?

- Mengapa Data AV dan Robot Sukar Diurus?

- Bagaimana Pendekatan Pembelajaran Mendalam Nomadic Berfungsi?

- Apa Maksudnya untuk Robotik dan Automasi?

- Soalan Lazim

Apa yang Sebenarnya Dilakukan oleh Nomadic?

Nomadic sedang membina platform infrastruktur data yang mengubah rakaman video dan sensor mentah yang ditangkap oleh kenderaan autonomi dan robot menjadi set data berstruktur dan boleh diquery. Daripada rakaman mentah yang disimpan — mahal untuk disimpan, hampir mustahil untuk dicari — sistem Nomadic menggunakan model pembelajaran mendalam untuk menandakan, mengklasifikasi, dan mengindeks data tersebut supaya jurutera dapat mencari apa yang mereka perlukan.

Menurut TechCrunch, pusingan benih $8.4 juta meletakkan Nomadic sebagai infrastruktur untuk timbunan AI Fizikal yang lebih luas — bukan sahaja untuk program AV, tetapi untuk mana-mana sistem robotik yang menghasilkan aliran sensor berterusan yang perlu dijadikan isyarat latihan.

Anggapkan ia seperti perbezaan antara gudang penuh kotak tidak berlabel dan sistem inventori yang diindeks sepenuhnya. Rakaman itu wujud dalam kedua-dua keadaan, tetapi hanya satu versi yang berguna secara operasi. Analogi itu mula tidak tepat pada skala besar — masalah dengan data AV bukan sekadar pelabelan, tetapi jumlahnya yang besar digabungkan dengan kos anotasi manusia dan jarangnya kes tepi kritikal keselamatan yang tersembunyi dalam berjam-jam rakaman rutin.

Mengapa Data AV dan Robot Sukar Diurus?

Sebuah kenderaan autonomi boleh menjana antara 1 hingga 40 terabait data sensor mentah setiap hari, bergantung pada set sensornya — kamera, LiDAR, radar, IMU. Sebuah armada kecil sepuluh kenderaan yang beroperasi secara berterusan menghasilkan lebih banyak data setiap minggu daripada yang direka bentuk untuk dikendalikan oleh kebanyakan saluran paip data perusahaan.

Masalah ini bertambah dalam dua arah. Pertama, kos penyimpanan cepat meningkat apabila data berskala petabait perlu disimpan untuk latihan model, audit keselamatan, dan semakan kawal selia. Kedua, dan yang lebih penting, kebanyakan data tersebut tidak aktif secara operasi — ia tidak boleh diquery, ditapis, atau diperoleh tanpa usaha pelabelan manual yang ketara.

Untuk pasukan robotik secara khusus, ini mewujudkan gelung maklum balas yang menyakitkan:

- Gunakan robot di lapangan

- Kumpul jumlah data sensor yang besar

- Bergelut untuk mengekstrak senario kegagalan tertentu, kes tepi, atau peristiwa khusus domain yang diperlukan untuk menambah baik model

- Iterasi latihan menjadi perlahan

- Prestasi penggunaan terbantut

Aliran kerja anotasi manusia — penyelesaian tradisional — tidak berskala secara ekonomi. Kos pelabelan untuk set data pemanduan autonomi secara sejarahnya antara $0.05 hingga $0.50 setiap bingkai, dan satu jam video pada 30fps mengandungi 108,000 bingkai. Ekonomi ini secara aktif tidak menggalakkan pasukan daripada menggunakan sepenuhnya data ekzos daripada armada mereka.

Bagaimana Pendekatan Pembelajaran Mendalam Nomadic Berfungsi?

Sistem teras Nomadic menggunakan model pembelajaran mendalam pada rakaman mentah untuk mengekstrak secara automatik struktur semantik daripada aliran sensor. Daripada memerlukan jurutera melabel rakaman secara manual sebelum ia boleh dicari, platform ini membuat inferens tentang apa yang berlaku dalam adegan, menandakan peristiwa dan objek, dan menyusun output ke dalam bentuk yang boleh diquery.

Implikasi praktikalnya adalah signifikan: pasukan robotik dan AV boleh mengeluarkan pertanyaan bahasa semula jadi atau berstruktur — "tunjukkan semua kejadian di mana kenderaan menghampiri pejalan kaki pada jarak bawah 2 meter dalam hujan" — dan memperoleh klip relevan daripada berjuta-juta jam rakaman tanpa semakan manual.

Pendekatan ini menyerupai apa yang dilakukan oleh pangkalan data vektor moden untuk teks tidak berstruktur, tetapi digunakan pada data sensor multimodal termasuk video, awan titik, dan aliran IMU. Model pembelajaran mendalam bertindak sebagai lapisan anotasi automatik, mengurangkan kos setiap contoh berlabel secara drastik sambil meningkatkan ketumpatan isyarat yang boleh diekstrak daripada data sedia ada.

Nomadic vs. Pendekatan Saluran Paip Data Tradisional

| Pendekatan | Kos Anotasi | Kelajuan Carian | Skalabiliti | Ingatan Kes Tepi |

|---|---|---|---|---|

| Pelabelan manual manusia | Tinggi ($0.05–$0.50/bingkai) | Perlahan | Lemah | Bergantung pada penyemak |

| Auto-pelabelan berasaskan peraturan | Rendah | Cepat | Sederhana | Tertinggal peristiwa baru |

| Pembelajaran mendalam Nomadic | Rendah–Sederhana | Cepat | Tinggi | Kuat pada kategori terlatih |

| Tiada saluran paip (storan mentah) | Tiada | Tiada | Tinggi (kos) | Sifar |

Awas yang perlu dicatat: anotasi berasaskan pembelajaran mendalam mewarisi sebarang titik buta yang wujud dalam taburan latihan model. Untuk kes tepi kritikal keselamatan yang jarang — tepatnya peristiwa yang paling bernilai untuk latihan — model yang tidak melihat cukup contoh mungkin masih gagal untuk memperolehnya dengan boleh dipercayai. Proposisi nilai jangka panjang Nomadic mungkin bergantung pada sejauh mana modelnya dapat mengitlak merentasi pelbagai penggunaan robot dan kenderaan.

Apa Maksudnya untuk Robotik dan Automasi

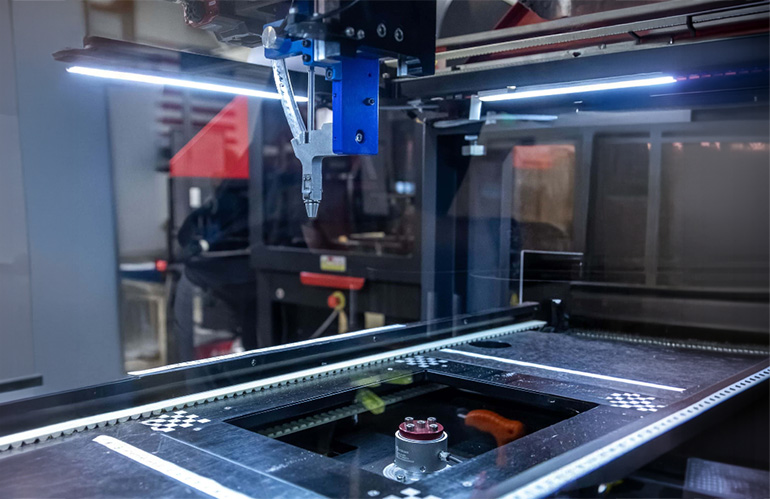

Kesesakan data yang diserang oleh Nomadic bukan unik kepada kenderaan autonomi. Ia adalah masalah yang sama dihadapi oleh AMR gudang (robot mudah alih autonomi), robot pemeriksaan industri, sistem automasi pertanian, dan program robot humanoid — mana-mana sistem AI yang dijelmakan yang menjana data persepsi berterusan di dunia nyata.

Bagi pasukan yang mengendalikan atau memperoleh armada robot, ini penting dalam dua cara yang konkrit.

Kelajuan latihan: Kadar di mana sistem robotik bertambah baik adalah secara langsung dihadkan oleh seberapa pantas pasukan dapat mengekstrak isyarat latihan yang bermakna daripada data penggunaan. Infrastruktur yang mempercepatkan gelung itu — walaupun dengan faktor 2–3× — memampatkan garis masa penambahbaikan secara berkadar.

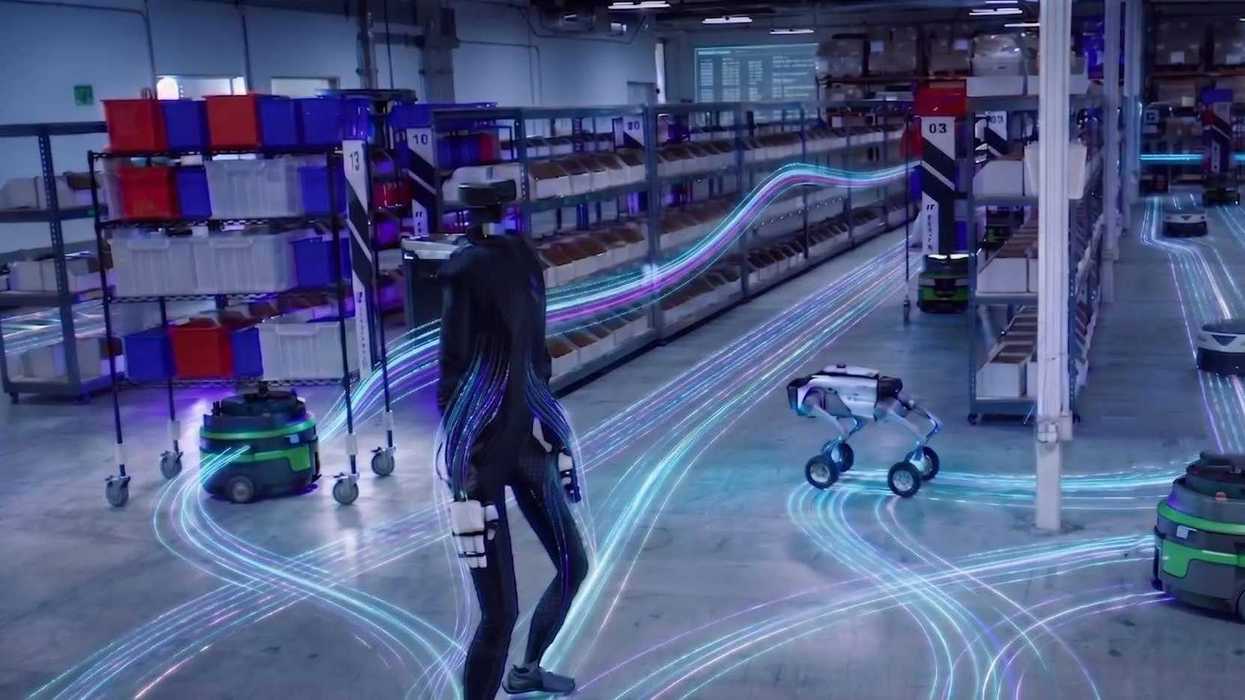

Kepintaran armada pada skala besar: Apabila armada robot berkembang, nilai operasi data sensor tersebut melangkaui latihan model. Data berstruktur membuka kunci pengesanan anomali, isyarat penyelenggaraan ramalan, dan penanda aras prestasi merentas unit — mengubah armada robot itu sendiri menjadi sistem yang mendokumentasikan diri secara berterusan.

Bagi pengendali yang mempertimbangkan penggunaan robot terpakai atau diubah suai — di mana konfigurasi sensor mungkin berbeza dan set data sedia ada kurang dikurasi — platform seperti Nomadic menjadi sangat relevan. Memberi makan data lapangan daripada robot industri terpakai kembali ke dalam saluran paip latihan berstruktur secara historisnya adalah proses manual yang mahal. Infrastruktur penstrukturan automatik mengubah kalkulus itu.

Angka pembiayaan benih $8.4 juta juga memberi isyarat di mana pelaburan infrastruktur mengalir dalam timbunan AI Fizikal. Perkakasan — robot itu sendiri — mendapat perhatian. Tetapi lapisan data antara penggunaan dan penambahbaikan model semakin menjadi tempat kelebihan daya saing dibina dan di mana modal mula tertumpu.

Pengendali yang menilai cobot terpakai untuk dijual atau membina program automasi skala kecil harus memasukkan kos saluran paip data ke dalam jumlah kos penggunaan — satu soalan yang Nomadic secara langsung memposisikan dirinya untuk menjawabnya.

Soalan Lazim

Nomadic adalah syarikat infrastruktur data yang menggunakan pembelajaran mendalam untuk menukar rakaman sensor mentah daripada kenderaan autonomi dan robot menjadi set data berstruktur dan boleh dicari. Ia menyelesaikan masalah penskalaan data sistem autonomi — di mana jumlah rakaman yang besar dihasilkan di lapangan tetapi kekal tidak boleh digunakan secara operasi tanpa anotasi manual yang mahal.

Berapa banyak data yang dijana oleh kenderaan autonomi setiap hari?

Sebuah kenderaan autonomi biasanya menjana antara 1 hingga 40 terabait data sensor mentah setiap hari, bergantung pada konfigurasi kamera, LiDAR, dan radarnya. Armada sepuluh kenderaan boleh mengumpul beratus-ratus terabait setiap minggu, menjadikan pemprosesan manual tidak ekonomik pada skala besar.

Bagaimana pendekatan pembelajaran mendalam Nomadic berbeza daripada pelabelan manual?

Pelabelan manual berharga antara $0.05 hingga $0.50 setiap bingkai, menjadikannya sangat mahal pada skala armada. Nomadic menggunakan model pembelajaran mendalam untuk menandakan dan mengindeks rakaman secara automatik, membolehkan jurutera membuat pertanyaan merentas set data besar tanpa semakan manusia bingkai demi bingkai — mengurangkan kos anotasi dan masa untuk mendapatkan pandangan secara signifikan.

Adakah masalah kesesakan data menjejaskan robot di luar kenderaan autonomi?

Ya. Mana-mana sistem AI yang dijelmakan — AMR gudang, robot pemeriksaan, automasi pertanian, platform humanoid — menjana data sensor berterusan yang menghadapi cabaran penstrukturan dan pengambilan semula yang sama. Masalah ini berskala dengan saiz armada dan jam operasi tanpa mengira aplikasi robotik tertentu.

Apakah maksud pembiayaan ini untuk ekosistem AI Fizikal yang lebih luas?

Pusingan benih $8.4 juta ini memberi isyarat pengiktirafan pelabur yang semakin meningkat bahawa lapisan infrastruktur data — bukan sahaja perkakasan atau model AI teras — adalah kesesakan kritikal dalam pembangunan sistem autonomi. Pelaburan infrastruktur dalam saluran paip data adalah penunjuk utama pematangan program penggunaan AI Fizikal.

Data ekzos daripada sistem autonomi sentiasa besar. Bahagian yang hilang adalah infrastruktur untuk mengubahnya menjadi isyarat yang boleh digunakan. Pendekatan Nomadic — menggunakan pembelajaran mendalam sebagai lapisan penstrukturan automatik — menangani kekangan yang menjejaskan setiap organisasi yang menggunakan robot atau kenderaan pada skala besar. Pembiayaan benih tidak akan menyelesaikan masalah dalam sekelip mata, tetapi ia menandakan pertaruhan arah yang jelas bahawa lapisan data adalah tempat kelebihan daya saing seterusnya dalam AI Fizikal dibina.

Adakah infrastruktur saluran paip data menjadi kesesakan yang menghadkan penambahbaikan armada robot anda — atau adakah perkakasan masih menjadi kekangan?

Sertai perbincangan

Is data pipeline infrastructure the bottleneck limiting your robot fleet — or is hardware still the constraint?