Inwestorzy w ciągu jednego roku włożyli 6,1 mld USD w roboty humanoidalne – cztery razy więcej niż rok wcześniej. Ten przypływ kapitału nie wynika z lepszych silników czy tańszych siłowników. Przyczyną jest fundamentalny przełom w sposobie, w jaki roboty się uczą – cicho budowany od 2015 roku, który sprawił, że roboty science fiction stały się realnym celem inżynieryjnym.

- Dlaczego uczenie robotów zmieniło wszystko po 2015 roku

- Od reguł do uczenia przez wzmacnianie: era symulacji

- Jak modele podstawowe dały robotom zdrowy rozsądek

- Ograniczenia, które wciąż hamują branżę

- Co to oznacza dla nabywców robotów i rynku sprzętu

- Najczęściej zadawane pytania

Dlaczego uczenie robotów zmieniło wszystko po 2015 roku

Przez większość historii robotyki inteligencja oznaczała reguły – tysiące ręcznie kodowanych instrukcji pisanych przez inżynierów, aby pokryć każdą przewidywalną sytuację. Ramie robota składające pranie potrzebowało jawnej logiki do orientacji rękawa, sztywności materiału, wykrywania kołnierza i dziesiątek przypadków brzegowych. Zbiór reguł rozrastał się w złożoności, zanim stał się niezawodny.

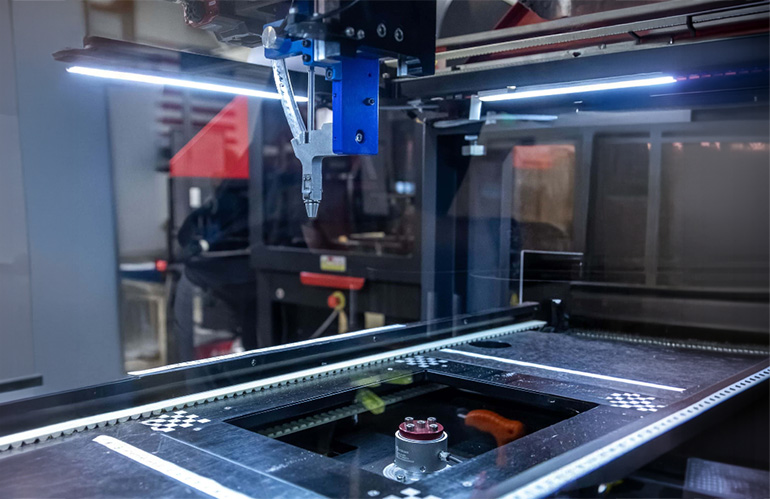

To podejście dało niezawodne roboty przemysłowe dla ustrukturyzowanych środowisk – linie spawalnicze, komórki pick-and-place, systemy przenośników – ale nie potrafiło generalizować. Przenieś to samo ramię do innego kontekstu, zmień oświetlenie, wprowadź nowy kształt obiektu, a wydajność natychmiast spadała.

Przepaść między tym, co roboty mogły zrobić, a tym, o czym marzyli badacze, pozostawała uparcie szeroka. Potem, około 2015 roku, metodologia się zmieniła.

Według dogłębnej analizy MIT Technology Review na temat współczesnej historii uczenia robotów, kluczową zmianą było przejście od kodowania reguł do prób i błędów opartych na danych – a następnie, po 2022 roku, do modeli podstawowych AI, które uczyły się na danych ze skali internetu, a nie tylko na ręcznie stworzonych symulacjach.

Od reguł do uczenia przez wzmacnianie: era symulacji

Około 2015 roku wiodące laboratoria robotyki zaczęły zastępować ręcznie pisane reguły uczeniem przez wzmacnianie (RL) – metodą treningu, w której agent AI otrzymuje sygnały nagrody za udane działania i sygnały kary za porażki, a następnie iteruje miliony razy, aby odkryć własne strategie.

Projekt Dactyl od OpenAI – pięciopalczasta ręka robotyczna trenowana w całości w symulacji – pokazał zarówno siłę, jak i podstawowe ograniczenie tego podejścia. Dactyl nauczył się manipulować małymi kostkami, trenując w cyfrowych środowiskach (wirtualnym silniku fizycznym), zanim został wdrożony na rzeczywistym sprzęcie. Problem: nawet drobne rozbieżności między symulowanym światem a fizyczną rzeczywistością powodowały gwałtowny spadek wydajności.

Rozwiązaniem inżynieryjnym była randomizacja domeny – celowe wprowadzanie losowych zmian w milionach symulowanych środowisk treningowych. Współczynniki tarcia, warunki oświetlenia, kolory obiektów i tekstury powierzchni były losowo zmieniane, aby wytrenowana polityka była wystarczająco odporna na rzeczywisty bałagan. Technika działała na tyle dobrze, że Dactyl ostatecznie rozwiązywał kostki Rubika – choć tylko w 60% przypadków przy standardowych ułożeniach, spadając do 20% przy trudniejszych konfiguracjach.

Te liczby mają znaczenie dla zrozumienia, gdzie wówczas znajdowała się dziedzina. Uczenie przez wzmacnianie w symulacji dawało imponującą zręczność, ale niezawodność była niewystarczająca do wdrożenia komercyjnego. OpenAI zamknął swoją sekcję robotyki w 2021 roku, co odzwierciedlało pułap, jaki osiągnęła ta technika.

Luka symulacja-rzeczywistość: kluczowe wyzwania techniczne

| Wyzwanie | Opis | Zastosowane środki zaradcze |

|---|---|---|

| Niedopasowanie wizualne | Kolory i tekstury różnią się od symulacji | Randomizacja domeny |

| Właściwości fizyczne | Tarcie, odkształcenia nie są idealnie modelowane | Losowane parametry fizyczne |

| Szum czujników | Rzeczywiste czujniki wprowadzają opóźnienia i błędy | Wstrzykiwanie szumu podczas treningu |

| Zużycie mechaniczne | Siłowniki degradują się z czasem | Nierozwiązane przez samą symulację-rzeczywistość |

Jak modele podstawowe dały robotom zdrowy rozsądek

Pojawienie się dużych modeli językowych zmieniło robotykę bardziej niż jakikolwiek postęp sprzętowy ostatniej dekady. Kluczowym spostrzeżeniem było architektoniczne: LLM-y uczą się, przewidując, jaki token (słowo, podsłowo lub znak) pojawi się jako następny w sekwencji, przetwarzając ogromne korpusy tekstu, aby zbudować bogate reprezentacje języka i wiedzy o świecie. Robotycy zadali oczywiste, ale przełomowe pytanie – czy ta sama architektura mogłaby działać, gdyby tokenami były odczyty czujników, klatki kamery i pozycje stawów zamiast słów?

Odpowiedzią Google DeepMind były RT-1 i jego następca RT-2 (Robotic Transformer). RT-1 był trenowany na 17 miesiącach danych z teleoperacji obejmujących 700 różnych zadań, przyjmując jako wejście widoki z kamery robota i stany stawów ramienia, a generując jako wyjście polecenia silników. W zadaniach widzianych podczas treningu osiągnął 97% sukcesów. W przypadku zupełnie nowych instrukcji radził sobie na poziomie 76% – dramatyczna poprawa w porównaniu z tym, co osiągały wyłącznie symulacyjne podejścia.

RT-2 poszedł dalej, włączając dane obrazowe i tekstowe z internetu, dając robotowi formę zdrowego rozsądku opartego na szerszym świecie wizualnym, a nie tylko na laboratorium robotyki. To jest kluczowy skok koncepcyjny: zamiast programować roboty regułami lub trenować je wyłącznie na danych specyficznych dla robotów, badacze odkryli, że ogólna wiedza o świecie – taka, jaka jest wbudowana w modele wizyjno-językowe podczas pre-treningu na skalę internetu – zaskakująco dobrze przenosi się na fizyczne zadania manipulacyjne.

Praktyczne implikacje są znaczące. Robot, który widział miliony obrazów kuchni, szuflad i kubków podczas pre-treningu, przychodzi z kontekstowym zrozumieniem, którego systemy oparte na regułach nigdy by nie zdobyły. Nie jest pewien, którego kubka chce człowiek, ale ma rozsądne prawdopodobieństwo wstępne. To prawdopodobieństwo drastycznie zmniejsza ilość danych specyficznych dla robota wymaganych do osiągnięcia użytecznego poziomu wydajności.

Ograniczenia, które wciąż hamują branżę

Obecne podekscytowanie jest realne, ale warto określić, co wciąż pozostaje nierozwiązane. Modele podstawowe dla robotyki stoją przed problemem danych, który nie występuje w takiej formie w przypadku modeli językowych. Dane tekstowe są obfite, tanie i łatwe do zebrania z sieci. Wysokiej jakości dane demonstracyjne robotów – zróżnicowane, fizycznie ugruntowane i dokładnie oznaczone – są drogie w zbieraniu, zależne od sprzętu i trudne do przeniesienia między różnymi morfologiami robotów.

Wczesne roboty społeczne ilustrują inne ograniczenie: możliwości bez niezawodności. Jibo, opracowany w MIT domowy robot społeczny, który zebrał 3,7 mln USD w crowdfundingu i kosztował 749 USD, miał przekonującą wizję, ale ostatecznie został podważony przez przed-LLM-ową technologię językową swojej ery. Jego rozmowy opierały się na skryptowanych fragmentach odpowiedzi, które szybko stawały się powtarzalne i płytkie. Dzisiejsza AI głosowa zmieniłaby to, czym Jibo mógł być – ale nowa generacja zabawek napędzanych AI niesie odwrotne ryzyko. Systemy skryptowane nie mogły zejść z torów; generatywne systemy AI absolutnie mogą, jak udokumentowano w przypadkach, w których towarzysze AI udzielali dzieciom niebezpiecznych wskazówek.

Dziedzina wymieniła jeden zestaw ograniczeń (sztywność, kruchość) na inny (nieprzewidywalność, niepewność bezpieczeństwa). Żaden problem nie jest w pełni rozwiązany. Zmieniło się to, że trajektoria poprawy jest teraz mierzalnie bardziej stroma.

Co to oznacza dla nabywców robotów i rynku sprzętu

Rewolucja w uczeniu AI to nie tylko historia akademicka – już teraz zmienia wyceny sprzętu w sposób, który ma znaczenie dla kupujących i operatorów.

Roboty, których możliwości były przypisane do ich oryginalnego programowania, szybko tracą na wartości na obecnym rynku. Drugiej generacji ramiona przemysłowe ze stałymi programami ruchu mają malejącą wartość odsprzedaży, ponieważ kupujący coraz częściej oczekują adaptacyjności. Tymczasem platformy sprzętowe zaprojektowane do uruchamiania oprogramowania opartego na uczeniu – z dostępnym obliczeniowo sprzętem, otwartymi API i wystarczającymi ładunkami czujników – utrzymują wartość bardziej stabilnie.

Dla kupujących oceniających dzisiejsze zakupy wynika kilka implikacji:

- Rozszerzalność platformy ma znaczenie tak samo jak obecne możliwości. Kobot, który uruchamia lokalnie nowoczesne wnioskowanie ML, będzie miał dłuższy okres użytkowania niż ten zamknięty w specyficznych dla producenta środowiskach programistycznych.

- Ceny używanego sprzętu odzwierciedlają gotowość AI. Roboty z platform, które otrzymały poważne aktualizacje oprogramowania opartego na uczeniu, zachowują wartość; te pozostawione przez producentów są znacząco przecenione.

- Infrastruktura danych jest nowym wyróżnikiem. Kupujący wdrażający wiele jednostek powinni planować zbieranie danych z teleoperacji od pierwszego dnia – te dane demonstracyjne staną się korpusem treningowym dla poprawy wydajności.

Dla operatorów rozważających wdrożenie na poziomie podstawowym, obecny rynek używanych robotów przemysłowych oferuje dostęp do wydajnego sprzętu po obniżonej cenie, choć kupujący powinni dokładnie ocenić mapy drogowe aktualizacji oprogramowania. Podobnie, rosnąca kategoria kobotów jest szczególnie dobrze przygotowana do korzystania z wdrożenia modeli podstawowych, ze względu na ich nieodłącznie elastyczne konteksty pracy w sąsiedztwie człowieka.

Najczęściej zadawane pytania

Głównym czynnikiem było dojrzewanie modeli podstawowych AI – konkretnie odkrycie, że modele wizyjno-językowe trenowane na danych ze skali internetu można zaadaptować do generowania poleceń silników robota z o wiele większą generalizacją niż poprzednie podejścia oparte na regułach lub wyłącznie symulacji. Inwestycje wzrosły po tym, jak badania pokazały, że modele takie jak RT-2 mogą wykonywać nowe zadania bez treningu specyficznego dla zadania, odblokowując wiarygodną ścieżkę do uniwersalnych robotów. Ostatnie liczby wskazują na czterokrotny wzrost inwestycji rok do roku, osiągając 6,1 mld USD.

Czym jest randomizacja domeny w robotyce i dlaczego jest ważna?

Randomizacja domeny to technika treningu symulacyjnego, w której podczas treningu generuje się tysiące nieco różnych wirtualnych środowisk – losowo zmieniając oświetlenie, tarcie, kolory obiektów i parametry fizyczne. Rozwiązuje ona problem luki symulacja-rzeczywistość (spadek wydajności, gdy polityki trenowane w symulacji działają na fizycznym sprzęcie), zmuszając nauczoną politykę do odporności na wiele możliwych konfiguracji świata. Dactyl od OpenAI użył tego podejścia, aby osiągnąć rozwiązywanie kostki Rubika za pomocą robotycznej dłoni, choć wskaźniki sukcesu zatrzymały się na 60% dla standardowego poziomu trudności.

Czym różnią się modele podstawowe dla robotyki od standardowych LLM-ów?

Standardowe duże modele językowe przetwarzają tokeny tekstowe zarówno jako wejście, jak i wyjście. Modele podstawowe dla robotyki rozszerzają tę architekturę, traktując klatki kamery, odczyty czujników głębokości i pozycje stawów robota jako dodatkowe tokeny wejściowe, a polecenia prędkości silników jako tokeny wyjściowe. Podstawowe zadanie przewidywania – „co będzie dalej, biorąc pod uwagę poprzedni kontekst?” – pozostaje strukturalnie podobne. Kluczową zaletą jest to, że pre-trenowanie na danych wizualnych i językowych na skalę internetu daje tym modelom wiedzę o świecie i zdrowy rozsądek, których czyste dane demonstracyjne robotów nie mogą skutecznie zapewnić.

Czy roboty adaptujące się do AI szybko uczynią starsze roboty ze stałym programem przestarzałymi?

Nie natychmiast. Roboty przemysłowe ze stałym programem pozostają wysoce opłacalne w przypadku zadań o dużej objętości i małej zmienności, takich jak spawanie i tłoczenie, gdzie adaptacyjność nie przynosi korzyści. Presja przestarzałości jest największa w logistyce mieszanych SKU, lekkim montażu i środowiskach usługowych, gdzie zmienność zadań jest nieodłączna. Kupujący powinni ocenić, czy ich konkretny profil zadań faktycznie korzysta z adaptacyjności, zanim założą, że nowsze platformy z AI uzasadniają premię cenową w stosunku do sprawdzonego starszego sprzętu.

Jakie są główne nierozwiązane problemy w dzisiejszym uczeniu robotów?

Pozostają trzy znaczące wyzwania: (1) wysoki koszt i ograniczona dostępność zróżnicowanych danych demonstracyjnych robotów w porównaniu z danymi tekstowymi dla modeli językowych; (2) nieprzewidywalność bezpieczeństwa generatywnych systemów AI wdrożonych w fizycznych środowiskach, szczególnie tych wchodzących w interakcje z wrażliwymi populacjami; oraz (3) niezawodna zręczna manipulacja – zadania motoryczne precyzyjne, takie jak przeciąganie kabli czy obróbka materiałów odkształcalnych, wciąż pokonują większość obecnych systemów w rzeczywistych warunkach, a nie w kontrolowanych laboratoriach.

Rewolucja w uczeniu robotów jest realna, ale nie jest zakończona. Modele podstawowe rozbiły sufit, który narzucały systemy oparte na regułach, a liczby inwestycyjne odzwierciedlają prawdziwy postęp technologiczny, a nie czystą spekulację. Przepaść między robotami science fiction a wdrażalnym sprzętem zawęziła się bardziej w ciągu ostatnich trzech lat niż w poprzednich trzech dekadach.

Następnym ograniczeniem nie jest algorytmiczne. To dane, walidacja bezpieczeństwa i niezawodność sprzętu na dużą skalę – trudne problemy inżynieryjne, których samo finansowanie nie może przyspieszyć poza pewne tempo.

Które podejście do uczenia robotów – uczenie przez wzmacnianie, modele podstawowe czy dane z teleoperacji – Twoim zdaniem zdecyduje o tym, kto wygra wyścig humanoidów?

Dołącz do dyskusji

Which robot learning approach — RL, foundation models, or teleoperation data — will determine who wins the humanoid race?