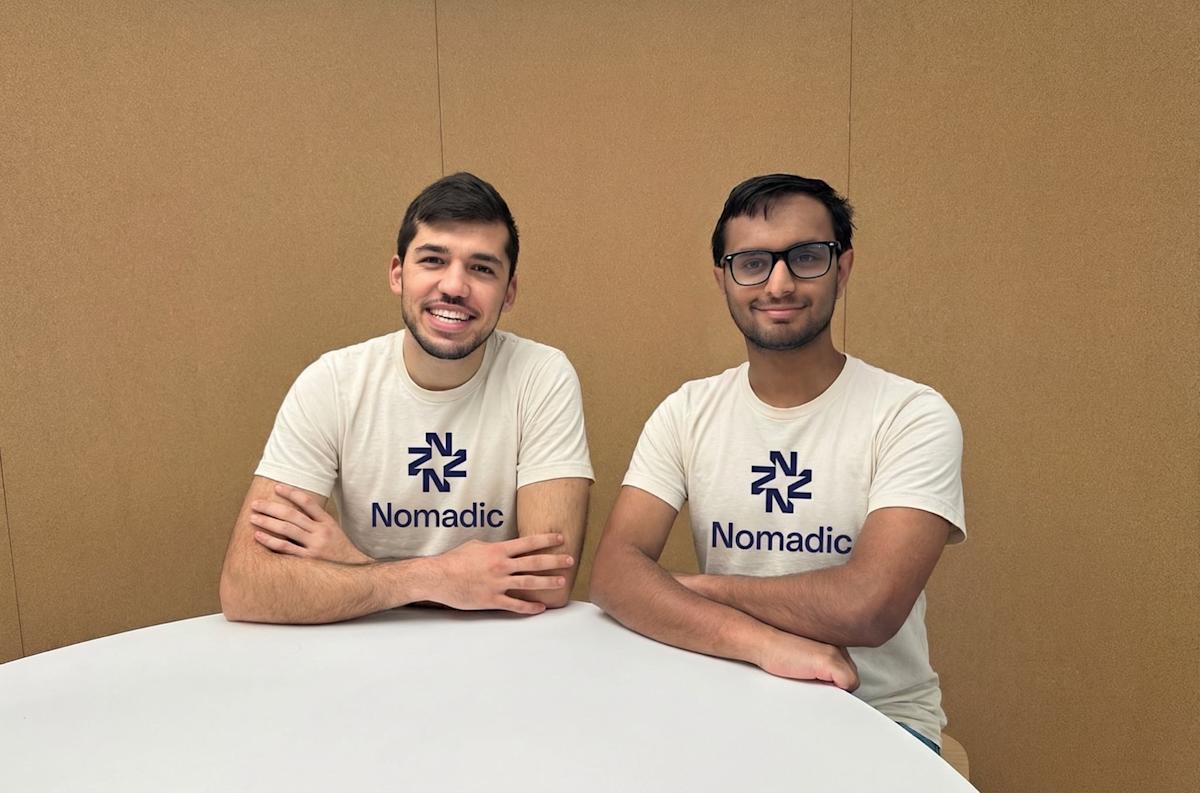

Pojazdy autonomiczne i roboty generują więcej danych z czujników, niż większość organizacji jest w stanie faktycznie wykorzystać. Nomadic pozyskał $8.4 million w ramach finansowania zalążkowego, aby to naprawić — budując warstwę infrastruktury, która przekształca surowe nagrania z pojazdów autonomicznych i robotów w strukturyzowane, przeszukiwalne zbiory danych przy użyciu deep learningu, rozwiązując wąskie gardło, które po cichu ogranicza tempo rozwoju systemów autonomicznych w całej branży.

Spis treści

- Co właściwie robi Nomadic?

- Dlaczego dane z AV i robotów są tak trudne do zarządzania?

- Jak działa podejście Nomadic oparte na deep learningu?

- Co to oznacza dla robotyki i automatyzacji?

- Najczęściej zadawane pytania

Co właściwie robi Nomadic?

Nomadic buduje platformę infrastruktury danych, która przekształca surowe nagrania wideo i z czujników, rejestrowane przez pojazdy autonomiczne i roboty, w strukturyzowane, przeszukiwalne zbiory danych. Zamiast przechowywać surowy materiał — drogi w utrzymaniu i praktycznie niemożliwy do przeszukania — system Nomadic wykorzystuje modele deep learningu do tagowania, klasyfikowania i indeksowania danych, aby inżynierowie mogli łatwo znaleźć to, czego potrzebują.

Według TechCrunch, runda $8.4 million pozycjonuje Nomadic jako infrastrukturę dla szerszego stosu Physical AI — nie tylko dla programów AV, ale dla każdego systemu robotycznego generującego ciągłe strumienie sensoryczne, które trzeba przekształcić w sygnał treningowy.

Można to porównać do różnicy między magazynem pełnym nieoznakowanych pudeł a w pełni zaindeksowanym systemem inwentaryzacyjnym. Nagrania istnieją w obu przypadkach, ale tylko jedna wersja jest operacyjnie użyteczna. Ta analogia załamuje się jednak przy skali — problem z danymi AV to nie tylko etykietowanie, ale ogromna objętość połączona z kosztem ręcznej adnotacji i rzadkością krytycznych przypadków skrajnych ukrytych w godzinach rutynowych nagrań.

Dlaczego dane z AV i robotów są tak trudne do zarządzania?

Pojedynczy pojazd autonomiczny może generować od 1 do 40 terabajtów surowych danych z czujników dziennie, w zależności od konfiguracji — kamery, LiDAR, radar, IMU. Mała flota dziesięciu pojazdów pracujących w trybie ciągłym wytwarza w ciągu tygodnia więcej danych, niż większość korporacyjnych potoków danych została zaprojektowana do obsłużenia.

Problem pogłębia się w dwóch kierunkach. Po pierwsze, koszty przechowywania szybko rosną, gdy dane na poziomie petabajtów muszą być przechowywane do trenowania modeli, audytów bezpieczeństwa i przeglądów regulacyjnych. Po drugie, co ważniejsze, większość tych danych jest operacyjnie martwa — nie można ich przeszukiwać, filtrować ani wydobywać bez znacznego ręcznego etykietowania.

Dla zespołów robotycznych tworzy to bolesną pętlę sprzężenia zwrotnego:

- Wdrożenie robotów w terenie

- Gromadzenie ogromnych ilości danych sensorycznych

- Trudności z wydobyciem konkretnych scenariuszy awarii, przypadków skrajnych lub zdarzeń specyficznych dla domeny, potrzebnych do ulepszenia modelu

- Spowolnienie iteracji treningu

- Stagnacja wydajności wdrożenia

Ręczne procesy adnotacji — tradycyjne rozwiązanie — nie skalują się ekonomicznie. Koszty etykietowania zestawów danych dla pojazdów autonomicznych historycznie wynosiły od $0.05 do $0.50 na klatkę, a jedna godzina wideo w 30 klatkach na sekundę zawiera 108 000 klatek. Ekonomia aktywnie zniechęca zespoły do wykorzystywania pełnego strumienia danych swoich flot.

Jak działa podejście Nomadic oparte na deep learningu?

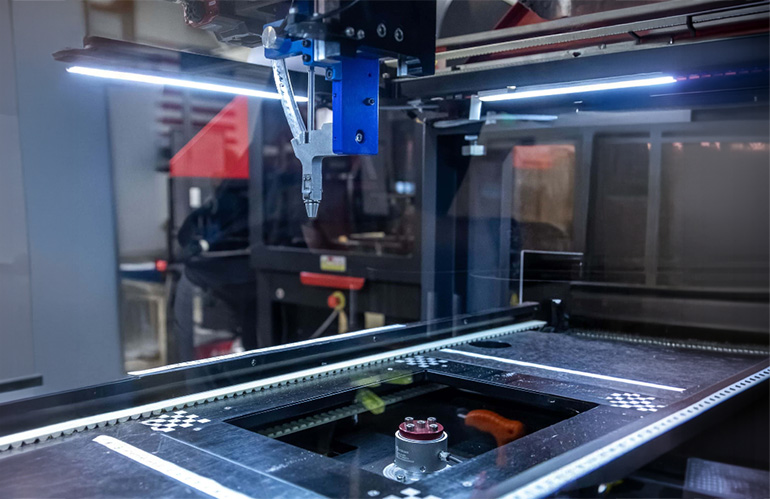

Podstawowy system Nomadic stosuje modele deep learningu do surowych nagrań, aby automatycznie wydobyć strukturę semantyczną ze strumieni sensorycznych. Zamiast wymagać od inżynierów ręcznego etykietowania nagrań, zanim staną się przeszukiwalne, platforma wnioskuje, co dzieje się w scenie, taguje zdarzenia i obiekty, a następnie organizuje wyniki w formie umożliwiającej zapytania.

Praktyczne implikacje są znaczące: zespoły robotyczne i AV mogą zadawać zapytania w języku naturalnym lub strukturyzowane — „pokaż wszystkie przypadki, w których pojazd zbliżył się do pieszego na odległość poniżej 2 metrów podczas deszczu” — i wyświetlić odpowiednie klipy z milionów godzin nagrań bez ręcznego przeglądania.

To podejście przypomina to, co robią nowoczesne bazy danych wektorowych dla nieustrukturyzowanego tekstu, ale zastosowane do multimodalnych danych sensorycznych, w tym wideo, chmur punktów i strumieni IMU. Model deep learningu działa jako automatyczna warstwa adnotacji, znacznie obniżając koszt oznakowanego przykładu, jednocześnie zwiększając gęstość sygnału, który można wydobyć z istniejących danych.

Nomadic a tradycyjne podejścia do potoków danych

| Podejście | Koszt adnotacji | Szybkość zapytań | Skalowalność | Odzyskiwanie przypadków skrajnych |

|---|---|---|---|---|

| Ręczne etykietowanie | Wysoki ($0.05–$0.50/klatka) | Wolna | Niska | Zależne od recenzenta |

| Automatyczne tagowanie regułowe | Niski | Szybka | Umiarkowana | Pomija nowe zdarzenia |

| Deep learning Nomadic | Niski–Średni | Szybka | Wysoka | Silna w wyszkolonych kategoriach |

| Brak potoku (surowy magazyn) | Brak | Brak | Wysoka (koszt) | Zero |

Zastrzeżenie warte odnotowania: adnotacja oparta na deep learningu dziedziczy wszelkie ślepe punkty istniejące w rozkładzie treningowym modelu. W przypadku rzadkich, krytycznych dla bezpieczeństwa przypadków skrajnych — dokładnie tych zdarzeń, które są najcenniejsze do trenowania — model, który nie widział wystarczającej liczby przykładów, może nadal nie być w stanie ich niezawodnie wyodrębnić. Długoterminowa wartość Nomadic prawdopodobnie zależy od tego, jak dobrze jego modele generalizują na różnych wdrożeniach robotów i pojazdów.

Co to oznacza dla robotyki i automatyzacji

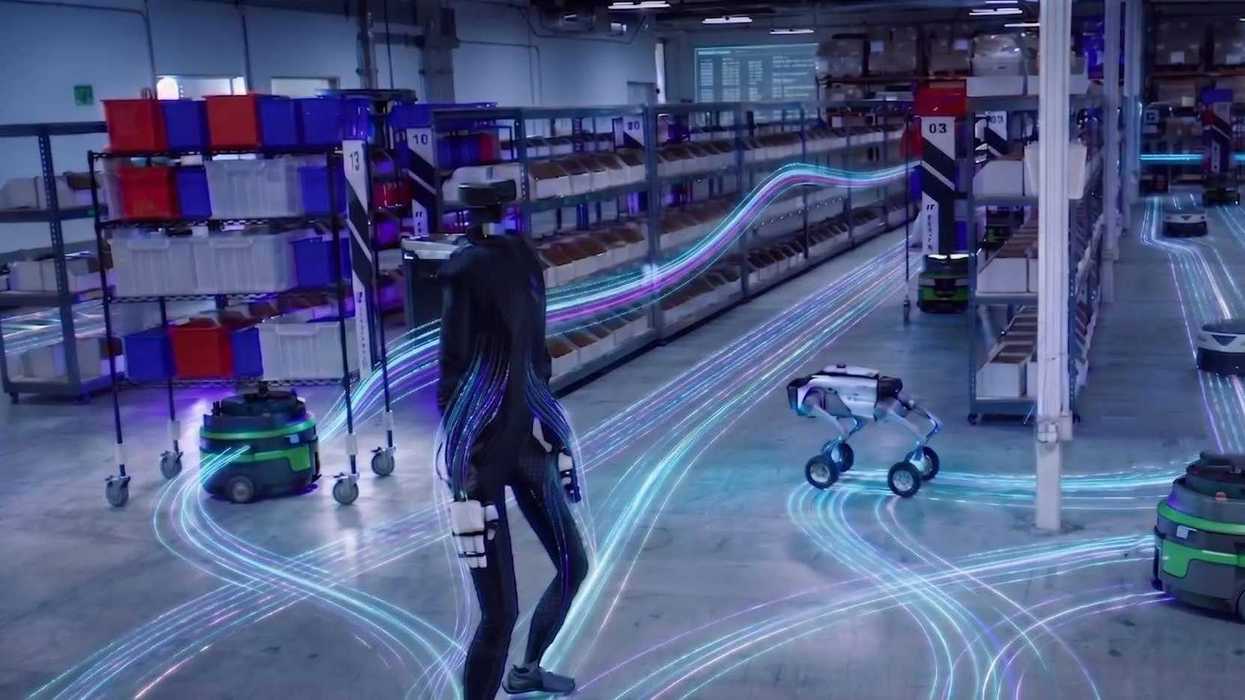

Wąskie gardło danych, które Nomadic atakuje, nie jest unikalne dla pojazdów autonomicznych. To ten sam problem, z którym mierzą się magazynowe AMR (autonomiczne roboty mobilne), przemysłowe roboty inspekcyjne, systemy automatyzacji rolnictwa i programy robotów humanoidalnych — każdy system ucieleśnionego AI, który generuje ciągłe dane percepcyjne w rzeczywistym świecie.

Dla zespołów obsługujących lub nabywających floty robotów ma to znaczenie w dwóch konkretnych aspektach.

Szybkość trenowania: Tempo, w jakim poprawia się system robotyczny, jest bezpośrednio ograniczone przez to, jak szybko zespoły mogą wydobyć znaczący sygnał treningowy z danych wdrożeniowych. Infrastruktura, która przyspiesza tę pętlę — nawet 2–3-krotnie — proporcjonalnie skraca czas ulepszeń.

Inteligencja floty na dużą skalę: W miarę wzrostu flot robotów wartość operacyjna tych danych sensorycznych wykracza poza trenowanie modeli. Ustrukturyzowane dane umożliwiają wykrywanie anomalii, sygnały predykcyjnego utrzymania ruchu i porównywanie wydajności między jednostkami — przekształcając flotę robotów w system ciągłego samodokumentowania.

Dla operatorów rozważających wdrożenie używanych lub odnowionych robotów — gdzie konfiguracje czujników mogą się różnić, a istniejące zestawy danych są mniej uporządkowane — platformy takie jak Nomadic stają się szczególnie istotne. Wprowadzanie danych terenowych z używanych robotów przemysłowych z powrotem do ustrukturyzowanych potoków treningowych było historycznie ręcznym, kosztownym procesem. Infrastruktura automatycznego strukturyzowania zmienia te rachunki.

Kwota $8.4 million w rundzie zalążkowej sygnalizuje również, gdzie płyną inwestycje infrastrukturalne w stos Physical AI. Sprzęt — same roboty — przyciąga uwagę. Ale warstwa danych między wdrożeniem a ulepszaniem modelu staje się coraz bardziej obszarem budowania przewagi konkurencyjnej i tam zaczyna koncentrować się kapitał.

Operatorzy oceniający używane coboty na sprzedaż lub budujący małe programy automatyzacji powinni uwzględnić koszty potoku danych w całkowitym koszcie wdrożenia — pytanie, na które Nomadic bezpośrednio stara się odpowiedzieć.

Najczęściej zadawane pytania

Nomadic to firma zajmująca się infrastrukturą danych, która wykorzystuje deep learning do przekształcania surowych nagrań z czujników pojazdów autonomicznych i robotów w strukturyzowane, przeszukiwalne zbiory danych. Rozwiązuje problem skalowania danych w systemach autonomicznych — gdzie ogromne ilości nagrań są generowane w terenie, ale pozostają operacyjnie bezużyteczne bez kosztownej ręcznej adnotacji.

Ile danych generuje pojazd autonomiczny dziennie?

Pojedynczy pojazd autonomiczny generuje zazwyczaj od 1 do 40 terabajtów surowych danych z czujników dziennie, w zależności od konfiguracji kamer, LiDAR i radaru. Flota dziesięciu pojazdów może gromadzić setki terabajtów tygodniowo, co czyni ręczne przetwarzanie ekonomicznie nieopłacalnym na dużą skalę.

Czym podejście Nomadic oparte na deep learningu różni się od ręcznego etykietowania?

Ręczne etykietowanie kosztuje od $0.05 do $0.50 na klatkę, co czyni je niezwykle kosztownym przy skali floty. Nomadic stosuje modele deep learningu do automatycznego tagowania i indeksowania nagrań, umożliwiając inżynierom przeszukiwanie dużych zbiorów danych bez ręcznego przeglądania klatka po klatce — znacznie obniżając koszt adnotacji i czas uzyskania wglądu.

Czy problem wąskiego gardła danych dotyczy robotów innych niż pojazdy autonomiczne?

Tak. Każdy system ucieleśnionego AI — magazynowe AMR, roboty inspekcyjne, automatyzacja rolnictwa, platformy humanoidalne — generuje ciągłe dane sensoryczne, które napotykają te same wyzwania związane ze strukturyzacją i odzyskiwaniem. Problem skaluje się wraz z wielkością floty i godzinami pracy, niezależnie od konkretnego zastosowania robotycznego.

Co to finansowanie oznacza dla szerszego ekosystemu Physical AI?

Runda zalążkowa w wysokości $8.4 million sygnalizuje rosnące uznanie inwestorów, że warstwa infrastruktury danych — a nie tylko sprzęt czy podstawowe modele AI — jest krytycznym wąskim gardłem w rozwoju systemów autonomicznych. Inwestycje infrastrukturalne w potoki danych są wiodącym wskaźnikiem dojrzewania programów wdrożeniowych Physical AI.

Strumień danych z systemów autonomicznych zawsze był ogromny. Brakującym elementem była infrastruktura do przekształcenia go w użyteczny sygnał. Podejście Nomadic — zastosowanie deep learningu jako automatycznej warstwy strukturyzującej — rozwiązuje ograniczenie, które dotyka każdą organizację wdrażającą roboty lub pojazdy na dużą skalę. To finansowanie zalążkowe nie rozwiąże problemu z dnia na dzień, ale wyznacza wyraźny kierunek: warstwa danych jest miejscem, gdzie buduje się kolejną przewagę konkurencyjną w Physical AI.

Czy infrastruktura potoku danych jest wąskim gardłem ograniczającym ulepszanie twojej floty robotów — czy sprzęt wciąż stanowi ograniczenie?

Dołącz do dyskusji

Is data pipeline infrastructure the bottleneck limiting your robot fleet — or is hardware still the constraint?