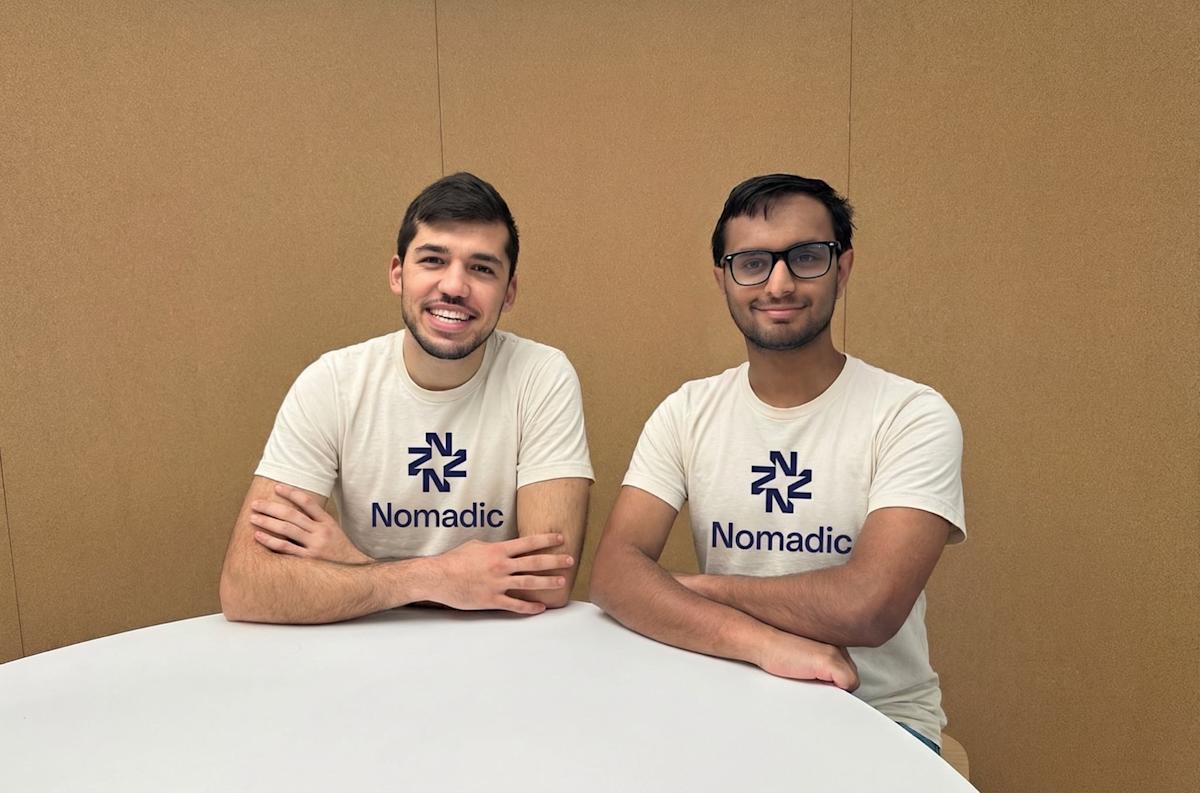

Autonoma fordon och robotar genererar mer sensordata än de flesta organisationer faktiskt kan använda. Nomadic har tagit in 8,4 miljoner dollar i startkapital för att åtgärda det – genom att bygga ett infrastrukturlager som omvandlar råa AV- och robotfilmer till strukturerade, sökbara dataset med hjälp av djupinlärning, och därmed adressera en flaskhals som i tysthet begränsar takten i utvecklingen av autonoma system över hela branschen.

Innehållsförteckning

- Vad gör Nomadic egentligen?

- Varför är AV- och robotdata så svårhanterlig?

- Hur fungerar Nomadics djupinlärningsmetod?

- Vad innebär detta för robotik och automation?

- Vanliga frågor och svar

Vad gör Nomadic egentligen?

Nomadic bygger en datainfrastrukturplattform som omvandlar råa video- och sensorfilmer från autonoma fordon och robotar till strukturerade, sökbara dataset. Istället för att råmaterialet ligger i lagring – dyrt att behålla, nästan omöjligt att söka i – använder Nomadics system djupinlärningsmodeller för att tagga, klassificera och indexera den datan så att ingenjörer faktiskt kan hitta vad de behöver.

Enligt TechCrunch positionerar den 8,4 miljoner dollar stora startrundan Nomadic som infrastruktur för den bredare Physical AI-stacken – inte bara för AV-program, utan för alla robotsystem som genererar kontinuerliga sensorströmmar som måste omvandlas till träningssignaler.

Tänk på det som skillnaden mellan ett lager fullt med omärkta lådor och ett fullt indexerat inventoriesystem. Filmerna finns där oavsett, men bara en version är operationellt användbar. Den analogin faller dock vid större skala – problemet med AV-data handlar inte bara om märkning, det är den enorma volymen kombinerad med kostnaden för manuell annotering och sällsyntheten av säkerhetskritiska gränsfall som är begravda i timmar av rutinmässiga filmer.

Varför är AV- och robotdata så svårhanterlig?

Ett enda autonomt fordon kan generera mellan 1 och 40 terabyte rå sensordata per dag, beroende på dess sensoruppsättning – kameror, LiDAR, radar, IMU. En liten flotta på tio fordon i kontinuerlig drift producerar mer data per vecka än de flesta företags datapipelines är designade för att hantera.

Problemet förvärras i två riktningar. För det första ackumuleras lagringskostnaderna snabbt när data i petabyte-skala måste bevaras för modellträning, säkerhetsgranskning och regulatorisk översyn. För det andra, och viktigare, är större delen av den datan operationellt inert – den kan inte sökas, filtreras eller tas fram utan betydande manuell märkningsinsats.

För robotikteam specifikt skapar detta en smärtsam återkopplingsslinga:

- Distribuera robotar i fält

- Samla in enorma mängder sensordata

- Kämpa för att extrahera de specifika felscenarierna, gränsfallen eller domänspecifika händelser som behövs för att förbättra modellen

- Träningsiterationen saktar ner

- Prestandan i drift stagnerar

Manuella annotationsarbetsflöden – den traditionella lösningen – skalar inte ekonomiskt. Märkningskostnader för autonoma körningsdataset har historiskt legat på mellan 0,05 och 0,50 dollar per bildruta, och en enda timmes video i 30 fps innehåller 108 000 bildrutor. Ekonomin motverkar aktivt team från att utnyttja hela datautflödet från sina flottor.

Hur fungerar Nomadics djupinlärningsmetod?

Nomadics kärnsystem tillämpar djupinlärningsmodeller på råa filmer för att automatiskt extrahera semantisk struktur från sensorströmmar. Istället för att ingenjörer manuellt måste märka filmer innan de blir sökbara, slutar plattformen sig av vad som händer i en scen, taggar händelser och objekt och organiserar utdata i sökbar form.

Den praktiska konsekvensen är betydande: robotik- och AV-team kan ställa naturliga språk- eller strukturerade frågor – "visa mig alla tillfällen där fordonet närmade sig en fotgängare på under 2 meter i regn" – och få fram relevanta klipp från miljontals timmars film utan manuell granskning.

Detta tillvägagångssätt speglar vad moderna vektordatabaser gör för ostrukturerad text, men tillämpat på multimodal sensordata inklusive video, punktmoln och IMU-strömmar. Djupinlärningsmodellen fungerar som ett automatiskt annotationslager, vilket dramatiskt minskar kostnaden per märkt exempel samtidigt som tätheten av extraherbar signal från befintlig data ökar.

Nomadic vs. traditionella datapipeline-metoder

| Metod | Annotationskostnad | Sökhastighet | Skalbarhet | Återkallning av gränsfall |

|---|---|---|---|---|

| Manuell märkning | Hög (0,05–0,50 $/bild) | Långsam | Dålig | Beroende av granskare |

| Regelbaserad automatagging | Låg | Snabb | Måttlig | Missar nya händelser |

| Nomadic djupinlärning | Låg–Medel | Snabb | Hög | Stark på tränade kategorier |

| Ingen pipeline (rålagring) | Ingen | Ingen | Hög (kostnad) | Noll |

Förbehållet värt att notera: djupinlärningsbaserad annotation ärver eventuella blindfläckar som finns i modellens träningsfördelning. För sällsynta, säkerhetskritiska gränsfall – exakt de händelser som är mest värdefulla för träning – kan en modell som inte sett tillräckligt många exempel fortfarande misslyckas med att fånga upp dem på ett tillförlitligt sätt. Nomadics långsiktiga värdeerbjudande kommer troligen att bero på hur väl dess modeller generaliserar över olika robot- och fordonsinstallationer.

Vad innebär detta för robotik och automation?

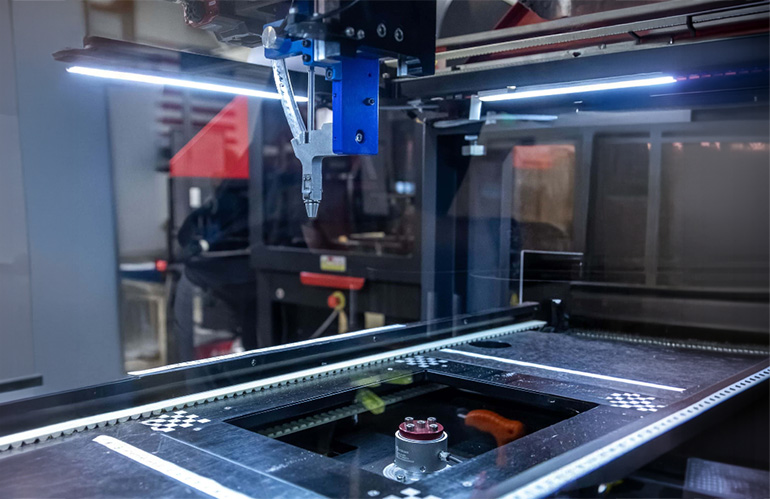

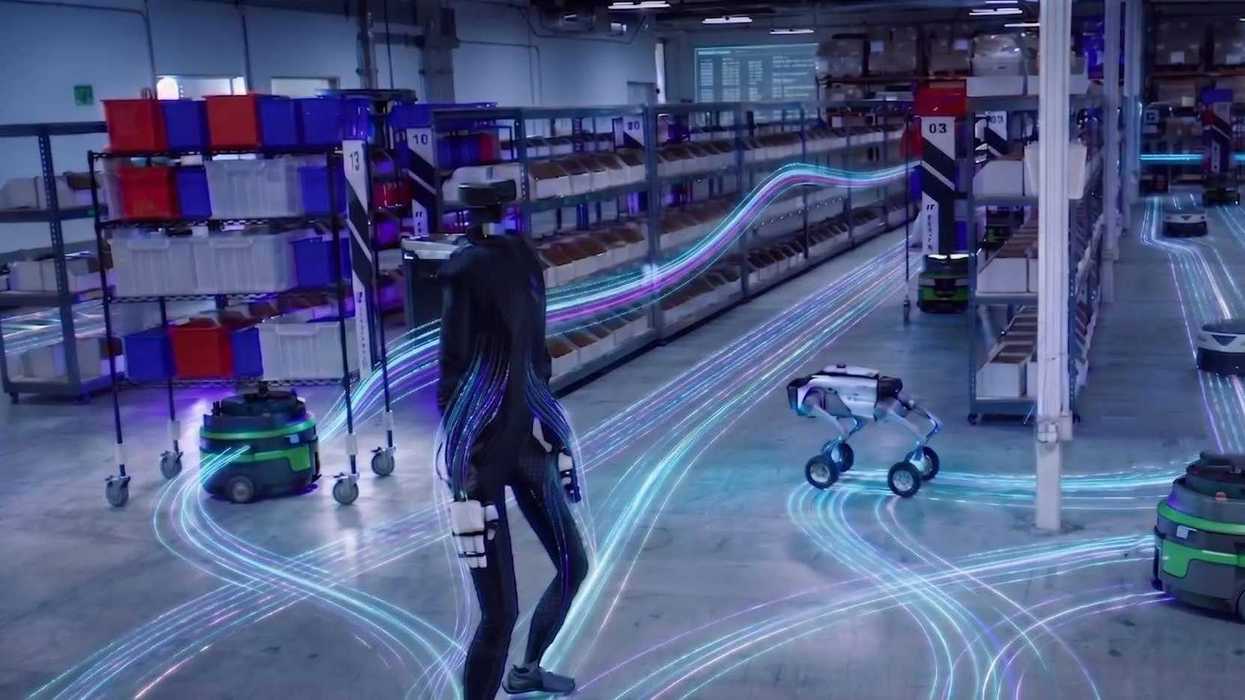

Den dataflaskhals som Nomadic angriper är inte unik för autonoma fordon. Det är samma problem som drabbar AMR:er (autonoma mobila robotar) i lager, industriella inspektionsrobotar, jordbruksautomationssystem och humanoida robotprogram – alla förkroppsligade AI-system som genererar kontinuerliga perceptuella data i den verkliga världen.

För team som driver eller anskaffar robotflottor är detta relevant på två konkreta sätt.

Träningshastighet: Hur snabbt ett robotsystem förbättras är direkt begränsat av hur snabbt team kan extrahera meningsfulla träningssignaler från distributionsdata. Infrastruktur som accelererar den loop – även med en faktor 2–3 – komprimerar förbättringstidslinjen proportionellt.

Flottintelligens i skala: När robotflottor växer sträcker sig det operativa värdet av sensordata bortom modellträning. Strukturerad data möjliggör avvikelsedetektion, prediktiva underhållssignaler och prestandajämförelser mellan enheter – vilket förvandlar robotflottan själv till ett kontinuerligt självdokumenterande system.

För operatörer som överväger använda eller renoverade robotar – där sensorkonfigurationer kan variera och befintliga dataset är mindre kuraterade – blir plattformar som Nomadic särskilt relevanta. Att mata fältdata från begagnade industrirobotar tillbaka i strukturerade träningspipelines har historiskt varit en manuell, dyr process. Automatiserad struktureringsinfrastruktur förändrar den kalkylen.

Siffran 8,4 miljoner dollar i startkapital signalerar också var infrastrukturinvesteringar flödar inom Physical AI-stacken. Hårdvaran – robotarna själva – får uppmärksamheten. Men datalagret mellan distribution och modellförbättring är allt oftare där konkurrensfördelar byggs och där kapital börjar koncentreras.

Operatörer som utvärderar begagnade cobots till salu eller bygger upp småskaliga automatiseringsprogram bör ta hänsyn till datapipelinekostnader i den totala distributionskostnaden – en fråga som Nomadic direkt positionerar sig för att besvara.

Vanliga frågor och svar

Nomadic är ett datainfrastrukturföretag som använder djupinlärning för att omvandla råa sensorfilmer från autonoma fordon och robotar till strukturerade, sökbara dataset. Det löser skalningsproblemet med autonoma systems data – där stora volymer filmer genereras i fält men förblir operationellt oanvändbara utan dyr manuell annotering.

Hur mycket data genererar ett autonomt fordon per dag?

Ett enda autonomt fordon genererar vanligtvis mellan 1 och 40 terabyte rå sensordata per dag, beroende på dess kamera-, LiDAR- och radarkonfiguration. En flotta på tio fordon kan ackumulera hundratals terabyte per vecka, vilket gör manuell bearbetning ekonomiskt ohållbar i större skala.

Hur skiljer sig Nomadics djupinlärningsmetod från manuell märkning?

Manuell märkning kostar mellan 0,05 och 0,50 dollar per bildruta, vilket gör den oöverkomligt dyr i flottskala. Nomadic tillämpar djupinlärningsmodeller för att automatiskt tagga och indexera filmer, vilket gör att ingenjörer kan söka över stora dataset utan bildruta-för-bildruta manuell granskning – vilket avsevärt minskar annotationskostnad och tid till insikt.

Påverkar dataflaskhalsen även andra robotar än autonoma fordon?

Ja. Alla förkroppsligade AI-system – AMR:er i lager, inspektionsrobotar, jordbruksautomation, humanoida plattformar – genererar kontinuerlig sensordata som står inför samma strukturerings- och återvinningsutmaningar. Problemet skalar med flottstorlek och drifttimmar oavsett specifik robotapplikation.

Vad innebär denna finansiering för det bredare Physical AI-ekosystemet?

Startrundan på 8,4 miljoner dollar signalerar ett växande investerarerkännande av att datainfrastrukturlagret – inte bara hårdvara eller kärn-AI-modeller – är en kritisk flaskhals i utvecklingen av autonoma system. Infrastrukturinvesteringar i datapipelines är en ledande indikator på mognande Physical AI-distributionsprogram.

Datautflödet från autonoma system har alltid varit enormt. Den saknade biten har varit infrastrukturen för att omvandla det till användbar signal. Nomadics tillvägagångssätt – att tillämpa djupinlärning som ett automatiskt struktureringslager – adresserar en begränsning som påverkar varje organisation som distribuerar robotar eller fordon i stor skala. Startkapitalet kommer inte att lösa problemet över en natt, men det markerar en tydlig riktningsbetoning på att datalagret är där nästa konkurrensfördel inom Physical AI byggs.

Är datapipelineinfrastruktur flaskhalsen som begränsar din robotflottas förbättring – eller är hårdvaran fortfarande hindret?

Gå med i diskussionen

Is data pipeline infrastructure the bottleneck limiting your robot fleet — or is hardware still the constraint?