Yatırımcılar, tek bir yılda insansı robotlara 6,1 milyar dolar akıttı; bu, bir önceki yılın toplamının dört katı. Bu sermaye patlaması daha iyi motorlardan veya daha ucuz aktüatörlerden gelmedi. 2015'ten beri sessizce inşa edilen ve artık bilim kurgu robotlarını mühendislik açısından makul bir hedef haline getiren, robotların nasıl öğrendiğine dair temel bir atılımdan geldi.

- 2015 Sonrası Robot Öğrenmesi Neden Her Şeyi Değiştirdi

- Kurallardan Pekiştirmeye: Simülasyon Çağı

- Temel Modeller Robotlara Nasıl Sağduyu Kazandırdı

- Sektörü Hâlâ Geride Tutan Sınırlar

- Robot Alıcıları ve Donanım Piyasası İçin Anlamı

- Sıkça Sorulan Sorular

2015 Sonrası Robot Öğrenmesi Neden Her Şeyi Değiştirdi

Robotik tarihinin büyük bölümünde zekâ, kurallar anlamına geliyordu: mühendislerin akla gelebilecek her durum için yazdığı binlerce elle kodlanmış talimat. Çamaşır katlayan bir robot kol, kol yönü, kumaş sertliği, yaka algılama ve düzinelerce uç durum için açık mantığa ihtiyaç duyuyordu. Kural seti, güvenilir hale gelmeden önce karmaşıklıkta patlama yapıyordu.

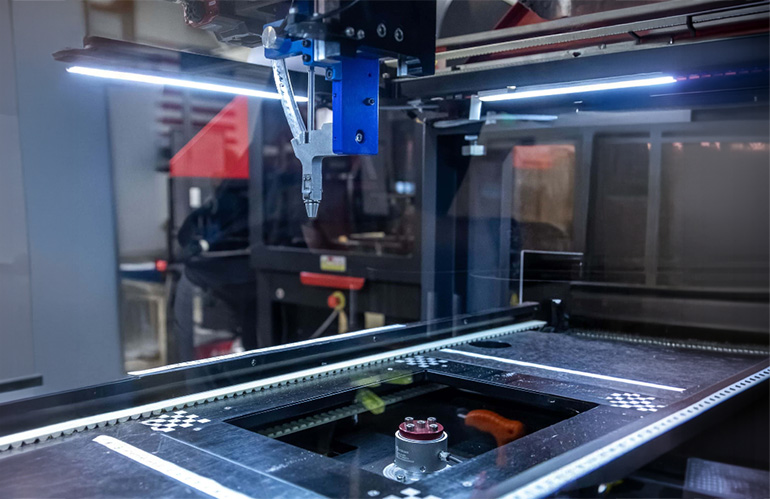

Bu yaklaşım, yapılandırılmış ortamlar için güvenilir endüstriyel robotlar üretti - kaynak hatları, yerleştirme ve alma hücreleri, konveyör sistemleri - ancak genelleme yapamıyordu. Aynı kolu farklı bir bağlama taşıyın, ışığı değiştirin, yeni bir nesne şekli ekleyin ve performans anında çöküyordu.

Robotların yapabildikleri ile araştırmacıların hayal ettikleri arasındaki uçurum inatla geniş kaldı. Ardından, 2015 civarında, metodoloji değişti.

MIT Technology Review'ün robot öğrenmesinin yakın tarihine dair derinlemesine analizine göre, dönüm noktası kural kodlamadan veri odaklı deneme-yanılmaya ve ardından 2022'den sonra yalnızca elle hazırlanmış simülasyonlardan ziyade internet ölçeğindeki verilerden öğrenen yapay zeka temel modellerine geçişti.

Kurallardan Pekiştirmeye: Simülasyon Çağı

2015 civarında, önde gelen robotik laboratuvarları elle yazılmış kuralların yerine pekiştirmeli öğrenmeyi (RL) koymaya başladı; bu, bir yapay zeka ajanının başarılı eylemler için ödül sinyalleri ve başarısızlıklar için ceza sinyalleri aldığı ve kendi stratejilerini keşfetmek için milyonlarca kez yineleme yaptığı bir eğitim yöntemidir.

OpenAI'in Dactyl projesi, tamamen simülasyonda eğitilmiş beş parmaklı robotik bir el, bu yaklaşımın hem gücünü hem de temel sınırlamasını gösterdi. Dactyl, gerçek donanıma dağıtılmadan önce dijital ortamlarda - esasen sanal bir fizik motoru - eğitim alarak küçük küpleri manipüle etmeyi öğrendi. Sorun: simüle edilmiş dünya ile fiziksel gerçeklik arasındaki küçük tutarsızlıklar bile performansın keskin bir şekilde düşmesine neden oldu.

Mühendislik çözümü alan rastgeleleştirmesiydi - milyonlarca simüle edilmiş eğitim ortamına kasıtlı olarak rastgele varyasyon eklemek. Sürtünme katsayıları, aydınlatma koşulları, nesne renkleri ve yüzey dokuları rastgele değiştirildi, böylece eğitilen politika gerçek dünyanın dağınıklığıyla başa çıkacak kadar sağlam olacaktı. Teknik, Dactyl'in sonunda Rubik Küpleri çözmesine yetecek kadar iyi çalıştı - ancak standart karıştırmalarda yalnızca %60 oranında, daha zor konfigürasyonlarda %20'ye düşerek.

Bu sayılar, alanın o zamanlar nerede olduğunu anlamak için önemlidir. Simülasyonla eğitilmiş RL gerçekten etkileyici bir el becerisi üretti, ancak güvenilirlik ticari dağıtım için yetersizdi. OpenAI, 2021'de robotik bölümünü kapattı ve tekniğin ulaştığı tavanı yansıttı.

Simülasyondan Gerçeğe Geçiş Boşluğu: Temel Teknik Zorluklar

| Zorluk | Açıklama | Kullanılan Hafifletme |

|---|---|---|

| Görsel uyumsuzluk | Renkler ve dokular simülasyondan farklı | Alan rastgeleleştirmesi |

| Fiziksel özellikler | Sürtünme, deformasyon mükemmel modellenmemiş | Rastgele fizik parametreleri |

| Sensör gürültüsü | Gerçek sensörler gecikme ve hata ekler | Eğitimde gürültü enjeksiyonu |

| Mekanik aşınma | Aktüatörler zamanla bozulur | Sim'dan gerçeğe tek başına çözülmemiş |

Temel Modeller Robotlara Nasıl Sağduyu Kazandırdı

Büyük dil modellerinin gelişi, robotikte son on yılın herhangi bir donanım atılımından daha derin bir şekilde değiştirdi. Kilit içgörü mimariydi: LLM'ler, bir dizide hangi tokenin (kelime, alt kelime veya karakter) geleceğini tahmin ederek öğrenir, zengin dil ve dünya bilgisi temsilleri oluşturmak için büyük metin külliyatlarını sindirir. Robotikçiler bariz ama dönüştürücü bir soru sordular - aynı mimari, tokenler kelimeler yerine sensör okumaları, kamera kareleri ve eklem konumları olsaydı da işe yarayabilir miydi?

Google DeepMind'in cevabı RT-1 ve ardılı RT-2 (Robotik Transformer) oldu. RT-1, 17 aylık teleoperasyon verisi ile 700 farklı görevi kapsayacak şekilde eğitildi, girdi olarak robot kamera görüntüleri ve kol eklem durumlarını alıp çıktı olarak motor komutları üretti. Eğitim sırasında gördüğü görevlerde %97 başarı elde etti. Tamamen yeni talimatlarda ise %76'yı yönetti - bu, yalnızca simülasyon yaklaşımlarının elde ettiğinin çok ötesinde bir iyileşmeydi.

RT-2, internet ölçeğindeki görüntü ve metin verilerini dahil ederek daha da ileri gitti ve robota yalnızca robotik laboratuvarına değil, daha geniş görsel dünyaya dayalı bir tür sağduyu kazandırdı. Bu, kavramsal sıçramadır: robotlara kurallar programlamak veya onları yalnızca robota özgü verilerle eğitmek yerine, araştırmacılar genel dünya bilgisinin - web ölçeğinde ön eğitim sırasında görsel-dil modellerine yerleşen türden - fiziksel manipülasyon görevlerine şaşırtıcı derecede iyi aktarıldığını keşfetti.

Pratik etki önemlidir. Ön eğitim sırasında milyonlarca mutfak, çekmece ve fincan görüntüsü görmüş bir robot, kural tabanlı sistemlerin asla edinemeyeceği bağlamsal anlayışla gelir. İnsanın hangi fincanı istediğinden emin değildir, ancak makul bir önseli vardır. Bu önsel, faydalı performans seviyelerine ulaşmak için gereken robota özgü eğitim verisi miktarını önemli ölçüde azaltır.

Sektörü Hâlâ Geride Tutan Sınırlar

Mevcut heyecan gerçek, ancak hâlâ çözülmemiş olanın haritasını çıkarmakta fayda var. Robotik için temel modeller, dil modelleri için aynı biçimde var olmayan bir veri sorunuyla karşı karşıyadır. Metin verileri bol, ucuz ve web'den kolayca kazınabilir. Yüksek kaliteli robot gösteri verileri - çeşitli, fiziksel olarak temellendirilmiş ve doğru etiketlenmiş - toplaması pahalı, donanıma bağımlı ve robot morfolojileri arasında aktarılması zordur.

Erken dönem sosyal robotlar, farklı bir sınırlamayı gösterir: güvenilirlik olmadan yetenek. MIT tarafından geliştirilen, 3,7 milyon dolar kitle fonlaması toplayan ve 749 dolara perakende satılan ev sosyal robotu Jibo, etkileyici bir vizyona sahipti ancak sonuçta döneminin LLM öncesi dil teknolojisi tarafından baltalandı. Sohbetleri, kısa sürede tekrarlayıcı ve sığ gelen senaryolu yanıt parçacıklarına dayanıyordu. Günümüzün sesli yapay zekası, Jibo'nun ne olabileceğini dönüştürebilirdi - ancak yeni nesil yapay zeka destekli oyuncaklar, tam tersi riski getiriyor. Senaryolu sistemler çığırından çıkamazdı; üretken yapay zeka sistemleri kesinlikle çıkabilir; yapay zeka arkadaşlarının çocuklara tehlikeli rehberlik vermesi belgelenmiş vakalarda görüldüğü gibi.

Alan, bir dizi sınırlamayı (katılık, kırılganlık) bir başkasıyla (öngörülemezlik, güvenlik belirsizliği) takas etti. Hiçbir sorun tam olarak çözülmedi. Değişen şey, iyileştirme yörüngesinin artık ölçülebilir şekilde daha dik olmasıdır.

Robot Alıcıları ve Donanım Piyasası İçin Anlamı

Yapay zeka öğrenme devrimi yalnızca akademik bir hikaye değil - şu anda alıcılar ve operatörler için önemli olan şekillerde donanım değerlemelerini yeniden şekillendiriyor.

Yetkinlikleri orijinal programlamalarına kilitlenmiş robotlar, mevcut piyasada hızla değer kaybediyor. Sabit hareket programlarına sahip ikinci nesil endüstriyel kollar, alıcılar giderek daha fazla uyarlanabilirlik bekledikçe düşen yeniden satış değerine sahip. Bu arada, öğrenmeye dayalı yazılımları çalıştırmak üzere tasarlanmış donanım platformları - erişilebilir bilgi işlem, açık API'ler ve yeterli sensör yükleri ile - değerlerini daha sağlam koruyor.

Bugün satın alma değerlendirmesi yapan alıcılar için birkaç çıkarım öne çıkıyor:

- Platform genişletilebilirliği, mevcut yetenek kadar önemlidir. Modern ML çıkarımını yerel olarak çalıştıran bir cobot, satıcıya özel programlama ortamlarına kilitlenmiş olandan daha uzun bir kullanım ömrüne sahip olacaktır.

- Kullanılmış donanım fiyatlandırması, yapay zeka hazırlığını yansıtır. Büyük öğrenmeye dayalı yazılım güncellemeleri alan platformlardan robotlar değerini korur; üreticileri tarafından geride bırakılanlar önemli ölçüde indirim yapıyor.

- Veri altyapısı yeni farklılaştırıcıdır. Birden çok birim konuşlandıran alıcılar, ilk günden itibaren teleoperasyon veri toplamayı planlamalıdır - bu gösteri verileri, iyileştirilmiş performans için eğitim külliyatı haline gelir.

Giriş seviyesi dağıtımı düşünen operatörler için mevcut kullanılmış endüstriyel robot pazarı, indirimli maliyetle yetenekli donanıma erişim sunar, ancak alıcılar yazılım güncelleme yol haritalarını dikkatlice değerlendirmelidir. Benzer şekilde, büyüyen cobot kategorisi, cobotların doğası gereği esnek, insana bitişik çalışma bağlamları göz önüne alındığında, temel model dağıtımından yararlanmak için özellikle iyi konumlanmıştır.

Sıkça Sorulan Sorular

Birincil itici güç, yapay zeka temel modellerinin olgunlaşmasıydı - özellikle, internet ölçeğindeki verilerle eğitilmiş görsel-dil modellerinin, önceki kural tabanlı veya yalnızca simülasyon yaklaşımlarından çok daha fazla genelleme ile robot motor komutları üretmek üzere uyarlanabileceğinin keşfi. Yatırım, RT-2 gibi modellerin göreve özgü eğitim olmadan yeni görevler gerçekleştirebileceğini ve genel amaçlı robotlara güvenilir bir yol açtığını gösteren araştırmalardan sonra arttı. Son rakamlar, yatırımın yıldan yıla dört katına çıkarak 6,1 milyar dolara ulaştığını gösteriyor.

Robotikte alan rastgeleleştirmesi nedir ve neden önemlidir?

Alan rastgeleleştirmesi, eğitim sırasında binlerce biraz farklı sanal ortamın oluşturulduğu bir simülasyon eğitim tekniğidir - aydınlatma, sürtünme, nesne renkleri ve fizik parametreleri rastgele değiştirilir. Simülasyondan gerçeğe geçiş boşluğunu (simülasyonla eğitilmiş politikalar fiziksel donanımda çalıştığında performans düşüşü) ele alır ve öğrenilen politikayı birçok olası dünya konfigürasyonunda sağlam olmaya zorlar. OpenAI'in Dactyl'i, bu yaklaşımı kullanarak robotik bir el ile Rubik Küpü çözmeyi başardı, ancak başarı oranları standart zorluk seviyelerinde %60'ta platoya ulaştı.

Robotik için temel modeller standart LLM'lerden nasıl farklıdır?

Standart büyük dil modelleri, hem girdi hem de çıktı olarak metin tokenlerini işler. Robotik temel modeller bu mimariyi, kamera karelerini, derinlik sensörü okumalarını ve robot eklem konumlarını ek girdi tokenleri olarak ve motor hız komutlarını çıktı tokenleri olarak ele alacak şekilde genişletir. Temel tahmin görevi - "önceki bağlam verildiğinde sırada ne var?" - yapısal olarak benzer kalır. Kritik avantaj, internet ölçeğindeki görsel ve dil verileri üzerinde ön eğitimin bu modellere, saf robot gösteri verilerinin verimli bir şekilde sağlayamayacağı dünya bilgisi ve sağduyu kazandırmasıdır.

Yapay zeka uyumlu robotlar, eski sabit programlı robotları hızla geçersiz kılacak mı?

Hemen değil. Sabit programlı endüstriyel robotlar, uyarlanabilirliğin hiçbir değer sağlamadığı yüksek hacimli, düşük varyasyonlu kaynak ve damgalama gibi görevler için oldukça uygun maliyetli olmaya devam ediyor. Eskime baskısı en yüksek, görev değişkenliğinin doğal olduğu karma ürün lojistiği, hafif montaj ve hizmet ortamlarındadır. Alıcılar, daha yeni yapay zeka yetenekli platformların kanıtlanmış eski donanıma göre fiyat primini haklı çıkarıp çıkarmadığını varsaymadan önce, belirli görev profillerinin uyarlanabilirlikten gerçekten faydalanıp faydalanmadığını değerlendirmelidir.

Günümüzde robot öğrenmesindeki başlıca çözülmemiş sorunlar nelerdir?

Üç zorluk önemini koruyor: (1) dil modelleri için metin verilerine kıyasla çeşitli robot gösteri verilerinin yüksek maliyeti ve sınırlı bulunabilirliği; (2) fiziksel ortamlarda, özellikle savunmasız popülasyonlarla etkileşime giren üretken yapay zeka sistemlerinin güvenlik öngörülemezliği; ve (3) güvenilir el becerisi manipülasyonu - kabloları geçirme veya deforme olabilen malzemeleri kullanma gibi ince motor görevleri, kontrollü laboratuvar ortamlarından ziyade gerçek dünya koşullarında çoğu mevcut sistemi hâlâ yenilgiye uğratıyor.

Robot öğrenme devrimi gerçek, ancak bitmedi. Temel modeller, kural tabanlı sistemlerin dayattığı tavanı paramparça etti ve yatırım rakamları, tamamen spekülasyondan ziyade gerçek teknolojik ilerlemeyi yansıtıyor. Bilim kurgu robotları ile kullanılabilir donanım arasındaki uçurum, son üç yılda önceki otuz yılda olduğundan daha fazla daraldı.

Bir sonraki kısıtlama algoritmik değil. Veri, güvenlik doğrulaması ve ölçekte donanım güvenilirliği - fonlamanın tek başına belirli bir hızın ötesine hızlandıramayacağı zor mühendislik problemleri.

Sizce hangi robot öğrenme yaklaşımı - pekiştirmeli öğrenme, temel modeller veya teleoperasyon verileri - insansı yarışı kimin kazanacağını belirleyecek?

Tartışmaya katıl

Which robot learning approach — RL, foundation models, or teleoperation data — will determine who wins the humanoid race?