Gli investitori hanno versato 6,1 miliardi di dollari in robot umanoidi in un solo anno recente — quattro volte il totale dell'anno precedente. Questo afflusso di capitali non è arrivato da motori migliori o attuatori più economici. È arrivato da un salto fondamentale nel modo in cui i robot imparano, un percorso silenzioso iniziato nel 2015 e che ora ha reso il robot da fantascienza un obiettivo ingegneristico plausibile.

- Perché l'apprendimento dei robot ha cambiato tutto dopo il 2015

- Dalle regole al reinforcement learning: l'era della simulazione

- Come i foundation model hanno dato buon senso ai robot

- I limiti che ancora frenano il settore

- Cosa significa per gli acquirenti di robotica e il mercato hardware

- Domande frequenti

Perché l'apprendimento dei robot ha cambiato tutto dopo il 2015

Per gran parte della storia della robotica, l'intelligenza significava regole — migliaia di istruzioni scritte a mano da ingegneri per coprire ogni situazione prevedibile. Un braccio robotico che piegava la biancheria aveva bisogno di logica esplicita per l'orientamento della manica, la rigidità del tessuto, il rilevamento del colletto e dozzine di casi limite. L'insieme di regole esplodeva in complessità prima ancora di diventare affidabile.

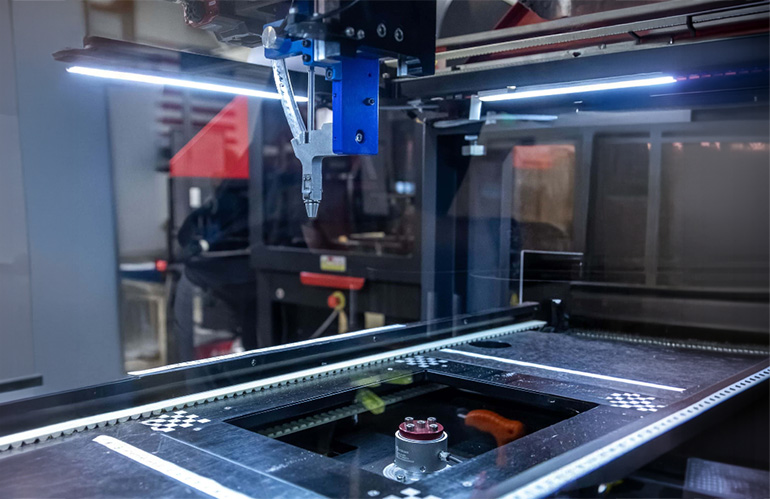

Questo approccio ha prodotto robot industriali affidabili per ambienti strutturati — linee di saldatura, celle pick-and-place, sistemi di trasporto — ma non riusciva a generalizzare. Sposta lo stesso braccio in un contesto diverso, cambia l'illuminazione, introduci una nuova forma di oggetto, e le prestazioni crollavano immediatamente.

Il divario tra ciò che i robot potevano fare e ciò che i ricercatori sognavano rimaneva ostinatamente ampio. Poi, intorno al 2015, la metodologia è cambiata.

Secondo l'analisi approfondita del MIT Technology Review sulla storia contemporanea dell'apprendimento dei robot, il cambiamento cruciale è stato il passaggio dalla codifica di regole al tentativo ed errore basato sui dati — e poi, dopo il 2022, ai foundation model AI che hanno imparato da dati su scala internet anziché da simulazioni create a mano.

Dalle regole al reinforcement learning: l'era della simulazione

Intorno al 2015, i principali laboratori di robotica hanno iniziato a sostituire le regole scritte a mano con il reinforcement learning (RL) — un metodo di addestramento in cui un agente AI riceve segnali di ricompensa per azioni riuscite e segnali di penalità per fallimenti, poi itera milioni di volte per scoprire le proprie strategie.

Il progetto Dactyl di OpenAI, una mano robotica a cinque dita addestrata interamente in simulazione, ha dimostrato sia la potenza che il limite centrale di questo approccio. Dactyl ha imparato a manipolare piccoli cubi addestrandosi in ambienti digitali — essenzialmente un motore fisico virtuale — prima di essere schierato su hardware reale. Il problema: anche piccole discrepanze tra il mondo simulato e la realtà fisica causavano un netto calo delle prestazioni.

La soluzione ingegneristica è stata la randomizzazione del dominio — introdurre deliberatamente variazioni casuali in milioni di ambienti di addestramento simulati. Coefficienti di attrito, condizioni di illuminazione, colori degli oggetti e texture superficiali venivano variati casualmente in modo che la politica addestrata fosse abbastanza robusta da gestire il caos del mondo reale. La tecnica ha funzionato abbastanza bene che Dactyl alla fine ha risolto i cubi di Rubik — anche se solo il 60% delle volte con mescolamenti standard, scendendo al 20% con configurazioni più difficili.

Questi numeri contano per capire dove si trovava il settore all'epoca. L'RL addestrato in simulazione produceva una destrezza genuinamente impressionante, ma l'affidabilità era insufficiente per un'implementazione commerciale. OpenAI ha chiuso la sua divisione di robotica nel 2021, riflettendo il soffitto che la tecnica aveva raggiunto.

Il divario simulazione-realtà: sfide tecniche chiave

| Sfida | Descrizione | Mitigazione utilizzata |

|---|---|---|

| Discrepanza visiva | Colori e texture diversi dalla simulazione | Randomizzazione del dominio |

| Proprietà fisiche | Attrito, deformazione non modellati perfettamente | Parametri fisici randomizzati |

| Rumore dei sensori | I sensori reali introducono latenza ed errori | Iniezione di rumore nell'addestramento |

| Usura meccanica | Gli attuatori degradano nel tempo | Non risolto da sim-to-real da solo |

Come i foundation model hanno dato buon senso ai robot

L'arrivo dei grandi modelli linguistici ha cambiato la robotica più profondamente di qualsiasi avanzamento hardware dell'ultimo decennio. L'intuizione chiave è stata architetturale: gli LLM imparano prevedendo quale token (parola, sottoparola o carattere) viene dopo in una sequenza, ingerendo enormi corpora di testo per costruire ricche rappresentazioni interne del linguaggio e della conoscenza del mondo. I robotici hanno posto una domanda ovvia ma trasformativa — la stessa architettura potrebbe funzionare se i token fossero letture di sensori, fotogrammi della telecamera e posizioni delle articolazioni invece di parole?

La risposta di Google DeepMind è stata RT-1 e il suo successore RT-2 (Robotic Transformer). RT-1 è stato addestrato su 17 mesi di dati di teleoperazione che coprivano 700 attività distinte, ricevendo come input le viste della telecamera del robot e gli stati delle articolazioni del braccio e generando come output comandi motori. Su attività viste durante l'addestramento, ha raggiunto il 97% di successo. Su istruzioni completamente nuove, ha comunque raggiunto il 76% — un miglioramento drammatico rispetto a qualsiasi approccio basato solo su simulazione.

RT-2 è andato oltre incorporando dati di immagini e testo su scala internet, dando al robot una forma di buon senso radicato nel mondo visivo più ampio anziché solo nel laboratorio di robotica. Questo è il salto concettuale chiave: invece di programmare i robot con regole, o addestrarli solo su dati specifici della robotica, i ricercatori hanno scoperto che la conoscenza generale del mondo — quella incorporata nei modelli visione-linguaggio durante il pretraining su scala web — si trasferiva sorprendentemente bene a compiti di manipolazione fisica.

L'implicazione pratica è significativa. Un robot che ha visto milioni di immagini di cucine, cassetti e tazze durante il pretraining arriva con una comprensione contestuale che i sistemi basati su regole non potrebbero mai acquisire. Non è certo quale tazza l'umano voglia, ma ha un prior ragionevole. Quel prior riduce drasticamente la quantità di dati di addestramento specifici del robot necessari per raggiungere livelli di prestazione utili.

I limiti che ancora frenano il settore

L'entusiasmo attuale è reale, ma vale la pena mappare ciò che rimane genuinamente irrisolto. I foundation model per la robotica affrontano un problema di dati che non esiste per i modelli linguistici nella stessa forma. I dati testuali sono abbondanti, economici e facilmente raccoglibili dal web. I dati di dimostrazione robotica di alta qualità — diversificati, fisicamente fondati e accuratamente etichettati — sono costosi da raccogliere, dipendenti dall'hardware e difficili da trasferire tra morfologie robotiche diverse.

I primi robot sociali illustrano una limitazione diversa: capacità senza affidabilità. Jibo, il robot sociale domestico sviluppato dal MIT che ha raccolto 3,7 milioni di dollari in crowdfunding e venduto a 749 dollari, aveva una visione avvincente ma è stato minato dalla tecnologia linguistica pre-LLM della sua epoca. Le sue conversazioni si basavano su snippet di risposta scriptati che rapidamente sembravano ripetitivi e superficiali. L'AI vocale di oggi trasformerebbe ciò che Jibo avrebbe potuto essere — ma la nuova generazione di giocattoli potenziati dall'AI introduce il rischio opposto. I sistemi scriptati non potevano uscire dai binari; i sistemi di AI generativa possono assolutamente farlo, come dimostrato da casi documentati di compagni AI che hanno dato indicazioni pericolose ai bambini.

Il settore ha scambiato un insieme di limitazioni (rigidità, fragilità) con un altro (imprevedibilità, incertezza sulla sicurezza). Nessun problema è completamente risolto. Ciò che è cambiato è che la traiettoria del miglioramento è ora misurabilmente più ripida.

Cosa significa per gli acquirenti di robotica e il mercato hardware

La rivoluzione dell'apprendimento AI non è solo una storia accademica — sta già rimodellando le valutazioni hardware in modi che contano per acquirenti e operatori in questo momento.

I robot le cui capacità erano bloccate alla loro programmazione originale si svalutano rapidamente nel mercato attuale. I bracci industriali di seconda generazione con programmi di movimento fissi hanno un valore di rivendita in calo poiché gli acquirenti si aspettano sempre più adattabilità. Nel frattempo, le piattaforme hardware progettate per eseguire software basato sull'apprendimento — con potenza di calcolo accessibile, API aperte e carichi utili sensoriali sufficienti — stanno mantenendo il valore in modo più robusto.

Per gli acquirenti che valutano acquisti oggi, diverse implicazioni emergono:

- L'estendibilità della piattaforma conta quanto la capacità attuale. Un cobot che esegue inferenza ML moderna localmente avrà una vita utile più lunga di uno bloccato in ambienti di programmazione specifici del venditore.

- Il prezzo dell'hardware usato riflette la prontezza AI. I robot di piattaforme che hanno ricevuto importanti aggiornamenti software basati sull'apprendimento mantengono valore; quelli abbandonati dai loro produttori stanno scontando significativamente.

- L'infrastruttura dati è il nuovo fattore differenziante. Gli acquirenti che schierano più unità dovrebbero pianificare la raccolta di dati di teleoperazione dal primo giorno — quei dati di dimostrazione diventano il corpus di addestramento per prestazioni migliori.

Per gli operatori che considerano un'implementazione entry-level, l'attuale mercato dei robot industriali usati offre accesso a hardware capace a costo ridotto, anche se gli acquirenti dovrebbero valutare attentamente le roadmap degli aggiornamenti software. Allo stesso modo, la crescente categoria cobot è particolarmente ben posizionata per beneficiare dello schieramento di foundation model, dato il contesto operativo intrinsecamente flessibile e adiacente all'uomo dei cobot.

Domande frequenti

Il motore principale è stata la maturazione dei foundation model AI — specificamente, la scoperta che i modelli visione-linguaggio addestrati su dati su scala internet potevano essere adattati per generare comandi motori robotici con una generalizzazione molto maggiore rispetto ai precedenti approcci basati su regole o solo simulazione. Gli investimenti sono aumentati dopo che la ricerca ha dimostrato che modelli come RT-2 potevano eseguire nuovi compiti senza addestramento specifico per il compito, sbloccando un percorso credibile verso robot generici. Le cifre recenti mostrano investimenti quadruplicati anno su anno, raggiungendo 6,1 miliardi di dollari.

Cos'è la randomizzazione del dominio in robotica e perché è importante?

La randomizzazione del dominio è una tecnica di addestramento in simulazione in cui migliaia di ambienti virtuali leggermente diversi vengono generati durante l'addestramento — variando illuminazione, attrito, colori degli oggetti e parametri fisici in modo casuale. Affronta il divario simulazione-realtà (il degrado delle prestazioni quando le politiche addestrate in simulazione vengono eseguite su hardware fisico) costringendo la politica appresa a essere robusta attraverso molte possibili configurazioni del mondo. Il Dactyl di OpenAI ha utilizzato questo approccio per risolvere il cubo di Rubik con una mano robotica, sebbene i tassi di successo si siano attestati al 60% per i livelli di difficoltà standard.

In che modo i foundation model per la robotica differiscono dagli LLM standard?

I modelli linguistici standard elaborano token di testo sia come input che come output. I foundation model per la robotica estendono questa architettura per trattare fotogrammi della telecamera, letture di sensori di profondità e posizioni delle articolazioni del robot come token di input aggiuntivi, e comandi di velocità del motore come token di output. Il compito di previsione centrale — "cosa viene dopo dato il contesto precedente?" — rimane strutturalmente simile. Il vantaggio critico è che il pretraining su dati visivi e linguistici su scala internet dà a questi modelli conoscenza del mondo e buon senso che i soli dati di dimostrazione robotica non possono fornire efficientemente.

I robot AI-adattivi renderanno rapidamente obsoleti i vecchi robot a programma fisso?

Non immediatamente. I robot industriali a programma fisso rimangono altamente convenienti per attività ad alto volume e bassa variazione come saldatura e stampaggio, dove l'adattabilità non fornisce valore. La pressione dell'obsolescenza è più alta nella logistica a mix variabile, nell'assemblaggio leggero e negli ambienti di servizio dove la variabilità delle attività è intrinseca. Gli acquirenti dovrebbero valutare se il loro profilo di attività specifico trae effettivamente beneficio dall'adattabilità prima di assumere che le piattaforme AI più recenti giustifichino il premio di prezzo rispetto all'hardware legacy collaudato.

Quali sono i principali problemi irrisolti nell'apprendimento dei robot oggi?

Tre sfide rimangono significative: (1) l'alto costo e la limitata disponibilità di dati di dimostrazione robotica diversificati rispetto ai dati testuali per i modelli linguistici; (2) l'imprevedibilità della sicurezza dei sistemi di AI generativa schierati in ambienti fisici, in particolare quelli che interagiscono con popolazioni vulnerabili; e (3) la manipolazione dextrosa affidabile — compiti motori fini come infilare cavi o maneggiare materiali deformabili ancora sconfiggono la maggior parte dei sistemi attuali in condizioni reali piuttosto che in ambienti di laboratorio controllati.

La rivoluzione dell'apprendimento dei robot è reale, ma non è finita. I foundation model hanno infranto il soffitto che i sistemi basati su regole imponevano, e i numeri degli investimenti riflettono un progresso tecnologico genuino piuttosto che pura speculazione. Il divario tra robot da fantascienza e hardware schierabile si è ridotto più negli ultimi tre anni che nei tre decenni precedenti.

Il prossimo vincolo non è algoritmico. Sono i dati, la validazione della sicurezza e l'affidabilità hardware su larga scala — i problemi ingegneristici duri che i soli finanziamenti non possono accelerare oltre un certo ritmo.

Quale approccio all'apprendimento dei robot — reinforcement learning, foundation model o dati di teleoperazione — pensi determinerà chi vincerà la corsa agli umanoidi?

Partecipa alla discussione

Which robot learning approach — RL, foundation models, or teleoperation data — will determine who wins the humanoid race?