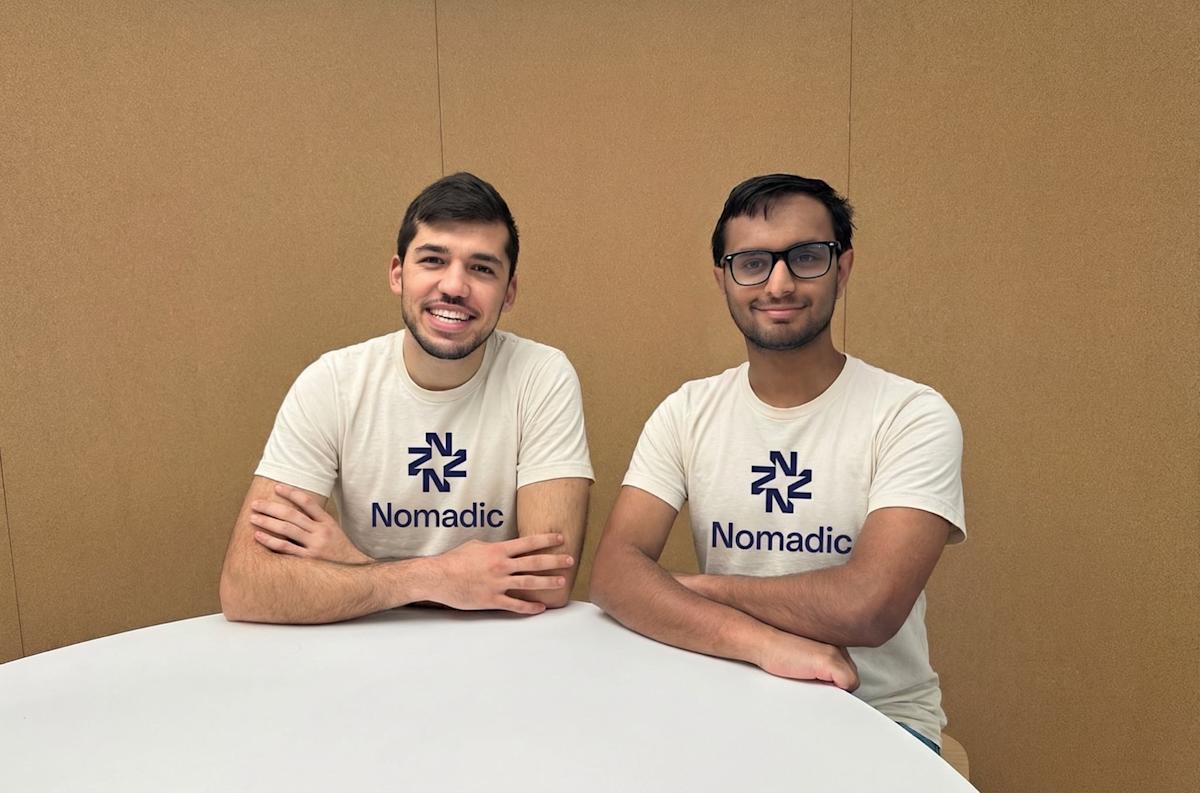

I veicoli autonomi e i robot generano più dati sensoriali di quanto la maggior parte delle organizzazioni possa effettivamente utilizzare. Nomadic ha raccolto 8,4 milioni di dollari in un round seed per risolvere questo problema — costruendo un layer infrastrutturale che converte filmati grezzi di AV e robot in dataset strutturati e ricercabili usando deep learning, affrontando un collo di bottiglia che silenziosamente limita il ritmo dello sviluppo dei sistemi autonomi in tutto il settore.

Indice

- Cosa fa esattamente Nomadic?

- Perché i dati di AV e robot sono così difficili da gestire?

- Come funziona l'approccio di deep learning di Nomadic?

- Cosa significa per la robotica e l'automazione?

- Domande frequenti

Cosa fa esattamente Nomadic?

Nomadic sta costruendo una piattaforma infrastrutturale per i dati che trasforma filmati grezzi e dati sensoriali catturati da veicoli autonomi e robot in dataset strutturati e interrogabili. Invece di lasciare i filmati grezzi in archivio — costosi da conservare, quasi impossibili da cercare — il sistema di Nomadic utilizza modelli di deep learning per taggare, classificare e indicizzare quei dati, così che gli ingegneri possano effettivamente trovare ciò di cui hanno bisogno.

Secondo TechCrunch, il round seed da 8,4 milioni posiziona Nomadic come infrastruttura per l'intero stack Physical AI — non solo per programmi AV, ma per qualsiasi sistema robotico che generi flussi continui di dati sensoriali da trasformare in segnale di training.

Pensatelo come la differenza tra un magazzino pieno di scatole non etichettate e un sistema di inventario completamente indicizzato. Il filmato esiste in entrambi i casi, ma solo una versione è operativamente utile. L'analogia però non regge su larga scala — il problema con i dati AV non è solo l'etichettatura, ma il volume enorme combinato con il costo dell'annotazione umana e la scarsità di casi limite critici per la sicurezza sepolti in ore di filmati di routine.

Perché i dati di AV e robot sono così difficili da gestire?

Un singolo veicolo autonomo può generare tra 1 e 40 terabyte di dati sensoriali grezzi al giorno, a seconda della sua dotazione di sensori — telecamere, LiDAR, radar, IMU. Una piccola flotta di dieci veicoli in operazione continua produce più dati a settimana di quanto la maggior parte delle pipeline dati aziendali sia progettata per gestire.

Il problema si aggrava in due direzioni. Primo, i costi di storage si accumulano rapidamente quando dati su scala petabyte devono essere conservati per training dei modelli, audit di sicurezza e revisioni normative. Secondo, e più importante, la maggior parte di quei dati è operativamente inerte — non può essere interrogata, filtrata o portata in superficie senza uno sforzo significativo di etichettatura manuale.

Per i team di robotica in particolare, questo crea un circolo vizioso doloroso:

- Distribuire robot sul campo

- Raccogliere enormi volumi di dati sensoriali

- Faticare a estrarre gli specifici scenari di fallimento, casi limite o eventi specifici del dominio necessari per migliorare il modello

- L'iterazione del training rallenta

- Le prestazioni in deployment ristagnano

I flussi di lavoro di annotazione umana — la soluzione tradizionale — non scalano economicamente. I costi di etichettatura per dataset di guida autonoma sono storicamente compresi tra 0,05 e 0,50 dollari per frame, e una singola ora di video a 30 fps contiene 108.000 frame. L'economia scoraggia attivamente i team dallo sfruttare tutto il data exhaust delle loro flotte.

Come funziona l'approccio di deep learning di Nomadic?

Il sistema principale di Nomadic applica modelli di deep learning ai filmati grezzi per estrarre automaticamente una struttura semantica dai flussi sensoriali. Invece di richiedere che gli ingegneri etichettino manualmente i filmati prima che diventino ricercabili, la piattaforma deduce cosa sta accadendo in una scena, tagga eventi e oggetti, e organizza l'output in forma interrogabile.

L'implicazione pratica è significativa: i team di robotica e AV possono formulare query in linguaggio naturale o strutturate — "mostrami tutte le istanze in cui il veicolo si è avvicinato a un pedone a meno di 2 metri sotto la pioggia" — e ottenere clip pertinenti da milioni di ore di filmati senza revisione manuale.

Questo approccio rispecchia ciò che i moderni database vettoriali fanno per il testo non strutturato, ma applicato a dati sensoriali multimodali che includono video, nuvole di punti e flussi IMU. Il modello di deep learning agisce come un layer di annotazione automatica, riducendo drasticamente il costo per esempio etichettato e aumentando la densità di segnale estraibile dai dati esistenti.

Nomadic vs. Approcci Tradizionali alle Pipeline Dati

| Approccio | Costo di Annotazione | Velocità di Query | Scalabilità | Recall di Casi Limite |

|---|---|---|---|---|

| Etichettatura manuale | Alto (0,05–0,50 $/frame) | Lenta | Scarsa | Dipende dal revisore |

| Auto-tagging basato su regole | Basso | Veloce | Moderata | Perde eventi nuovi |

| Deep learning Nomadic | Basso–Medio | Veloce | Alta | Buono su categorie addestrate |

| Nessuna pipeline (storage grezzo) | Nessuno | Nessuno | Alta (costo) | Zero |

Una nota importante: l'annotazione basata su deep learning eredita eventuali punti ciechi presenti nella distribuzione di training del modello. Per casi limite rari e critici per la sicurezza — esattamente gli eventi più preziosi per il training — un modello che non ha visto abbastanza esempi potrebbe comunque non riuscire a portarli in superficie in modo affidabile. La proposta di valore a lungo termine di Nomadic dipenderà probabilmente da quanto bene i suoi modelli generalizzeranno attraverso diverse implementazioni di robot e veicoli.

Cosa significa per la robotica e l'automazione

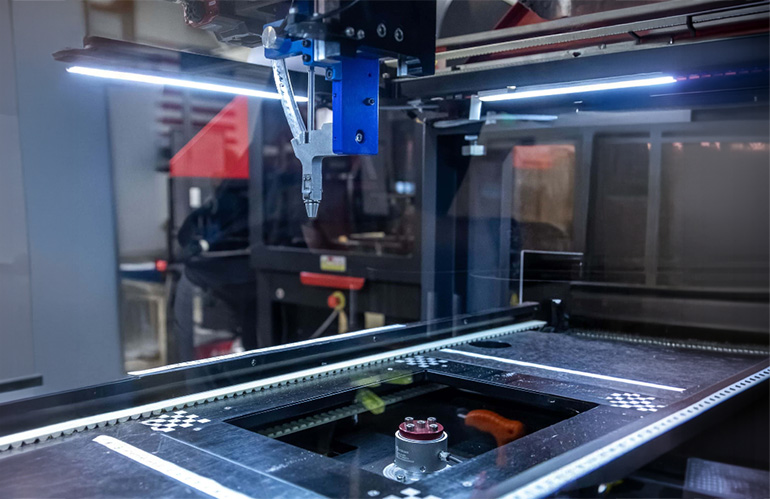

Il collo di bottiglia dei dati che Nomadic sta affrontando non è esclusivo dei veicoli autonomi. È lo stesso problema che affrontano gli AMR (autonomous mobile robot) nei magazzini, i robot di ispezione industriale, i sistemi di automazione agricola e i programmi di robot umanoidi — qualsiasi sistema di AI incarnata che genera dati percettivi continui nel mondo reale.

Per i team che gestiscono o acquistano flotte di robot, questo conta in due modi concreti.

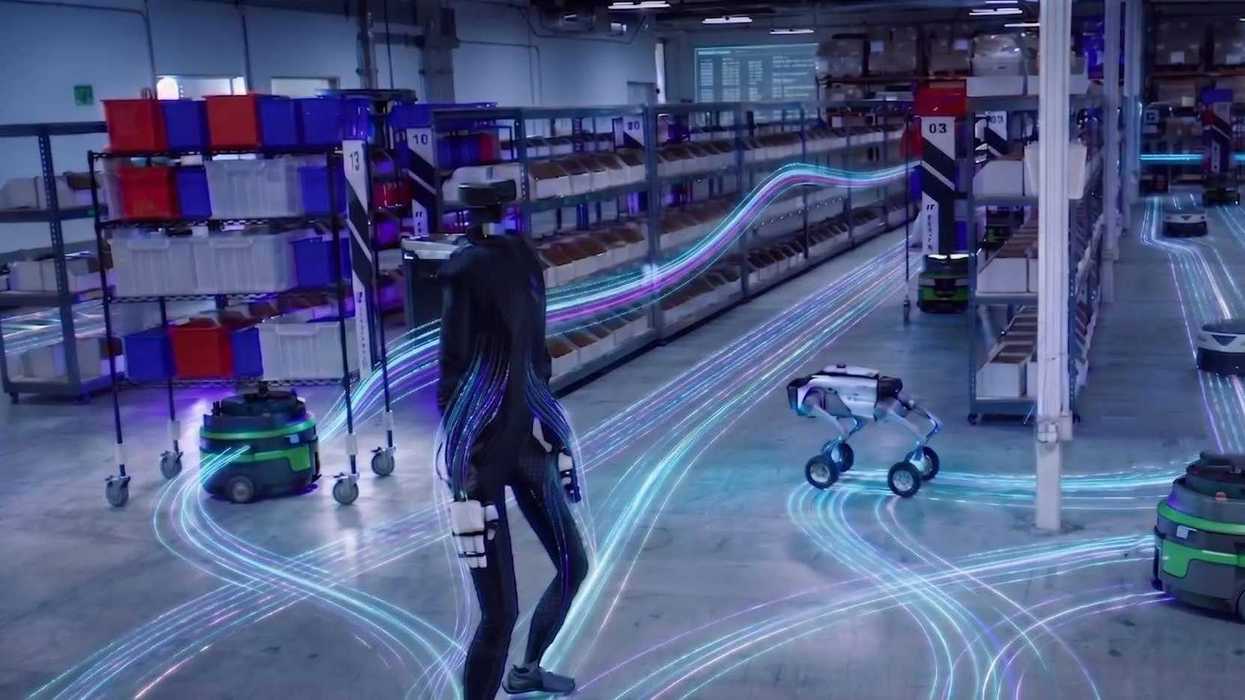

Velocità di training: Il tasso di miglioramento di un sistema robotico è direttamente vincolato dalla velocità con cui i team possono estrarre segnale di training significativo dai dati di deployment. Un'infrastruttura che accelera quel ciclo — anche di un fattore 2–3× — comprime proporzionalmente i tempi di miglioramento.

Intelligenza di flotta su larga scala: Man mano che le flotte di robot crescono, il valore operativo di quei dati sensoriali si estende oltre il training dei modelli. I dati strutturati sbloccano rilevamento di anomalie, segnali di manutenzione predittiva e benchmarking delle prestazioni tra unità — trasformando la flotta stessa in un sistema che si auto-documenta continuamente.

Per gli operatori che considerano l'uso di robot usati o ricondizionati — dove le configurazioni dei sensori possono variare e i dataset preesistenti sono meno curati — piattaforme come Nomadic diventano particolarmente rilevanti. Alimentare i dati di campo da robot industriali usati in pipeline di training strutturate è stato storicamente un processo manuale e costoso. L'infrastruttura di strutturazione automatica cambia questo calcolo.

La cifra di 8,4 milioni di dollari del round seed segnala anche dove stanno fluendo gli investimenti infrastrutturali nello stack Physical AI. L'hardware — i robot stessi — riceve l'attenzione. Ma il layer dati tra deployment e miglioramento del modello è sempre più il luogo in cui si costruisce il vantaggio competitivo e dove il capitale inizia a concentrarsi.

Gli operatori che valutano cobot usati in vendita o che sviluppano programmi di automazione su piccola scala dovrebbero includere i costi delle pipeline dati nel costo totale di deployment — una domanda a cui Nomadic si sta posizionando direttamente per rispondere.

Domande Frequenti

Nomadic è un'azienda di infrastruttura dati che utilizza il deep learning per convertire filmati sensoriali grezzi di veicoli autonomi e robot in dataset strutturati e ricercabili. Risolve il problema di scala dei dati dei sistemi autonomi — dove enormi volumi di filmati vengono generati sul campo ma rimangono operativamente inutilizzabili senza costosa annotazione manuale.

Quanti dati genera un veicolo autonomo al giorno?

Un singolo veicolo autonomo genera in genere tra 1 e 40 terabyte di dati sensoriali grezzi al giorno, a seconda della configurazione di telecamere, LiDAR e radar. Una flotta di dieci veicoli può accumulare centinaia di terabyte a settimana, rendendo l'elaborazione manuale economicamente insostenibile su larga scala.

In che modo l'approccio di deep learning di Nomadic differisce dall'etichettatura manuale?

L'etichettatura manuale costa tra 0,05 e 0,50 dollari per frame, rendendola proibitiva su scala di flotta. Nomadic applica modelli di deep learning per taggare e indicizzare automaticamente i filmati, consentendo agli ingegneri di interrogare grandi dataset senza revisione umana frame per frame — riducendo significativamente i costi di annotazione e il tempo per ottenere insight.

Il problema del collo di bottiglia dei dati riguarda anche robot diversi dai veicoli autonomi?

Sì. Qualsiasi sistema di AI incarnata — AMR nei magazzini, robot di ispezione, automazione agricola, piattaforme umanoidi — genera dati sensoriali continui che affrontano le stesse sfide di strutturazione e recupero. Il problema scala con la dimensione della flotta e le ore operative, indipendentemente dall'applicazione robotica specifica.

Cosa significa questo finanziamento per l'ecosistema Physical AI in generale?

Il round seed da 8,4 milioni di dollari segnala un crescente riconoscimento da parte degli investitori che il layer di infrastruttura dati — non solo l'hardware o i modelli AI core — è un collo di bottiglia critico nello sviluppo dei sistemi autonomi. L'investimento infrastrutturale nelle pipeline dati è un indicatore anticipatore di programmi di deployment Physical AI in maturazione.

Il data exhaust dei sistemi autonomi è sempre stato enorme. Il pezzo mancante è stato l'infrastruttura per trasformarlo in segnale utilizzabile. L'approccio di Nomadic — applicare il deep learning come layer di strutturazione automatica — affronta un vincolo che colpisce ogni organizzazione che distribuisce robot o veicoli su larga scala. Il round seed non risolverà il problema da un giorno all'altro, ma segna una chiara scommessa direzionale che il layer dati è dove si costruirà il prossimo vantaggio competitivo in Physical AI.

L'infrastruttura delle pipeline dati è il collo di bottiglia che limita il miglioramento della tua flotta di robot — o l'hardware è ancora il vincolo?

Partecipa alla discussione

Is data pipeline infrastructure the bottleneck limiting your robot fleet — or is hardware still the constraint?