Investeerders pompten in één recent jaar $6,1 miljard in humanoïde robots – vier keer het totale bedrag van het jaar ervoor. Die kapitaalgolf kwam niet door betere motoren of goedkopere actuatoren. Ze kwam door een fundamentele doorbraak in hoe robots leren, een doorbraak die sinds 2015 stilletjes is opgebouwd en nu van de sciencefictionrobot een plausibel technisch doel heeft gemaakt.

- Waarom robotleren na 2015 alles veranderde

- Van regels naar reinforcement: het simulatie-tijdperk

- Hoe fundamentmodellen robots gezond verstand gaven

- De beperkingen die de industrie nog steeds tegenhouden

- Wat dit betekent voor roboticakopers en de hardwaremarkt

- Veelgestelde vragen

Waarom robotleren na 2015 alles veranderde

Het grootste deel van de robotgeschiedenis bestond intelligentie uit regels – duizenden handgeschreven instructies geschreven door ingenieurs om elke voorzienbare situatie te dekken. Een robotarm die was vouwt, had expliciete logica nodig voor mouworiëntatie, stofstijfheid, kraagdetectie en tientallen randgevallen. De regelset explodeerde in complexiteit voordat hij ooit betrouwbaar werd.

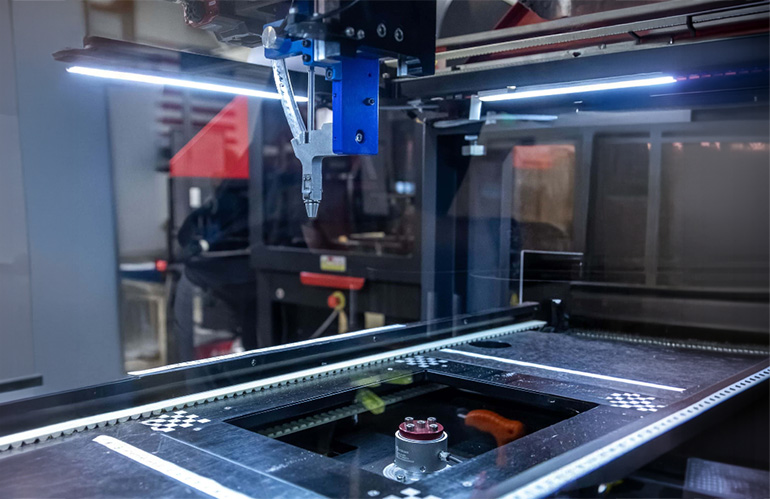

Die aanpak leverde betrouwbare industriële robots op voor gestructureerde omgevingen – laslijnen, pick-and-place cellen, transportsystemen – maar hij kon niet generaliseren. Verplaats dezelfde arm naar een andere context, verander de verlichting, introduceer een nieuwe objectvorm, en de prestaties stortten meteen in.

De kloof tussen wat robots konden doen en wat onderzoekers droomden dat ze konden doen, bleef hardnekkig groot. Rond 2015 verschoof de methodologie.

Volgens MIT Technology Review's diepgravende hedendaagse geschiedenis van robotleren was de cruciale verandering de overstap van regelcodering naar datagedreven trial-and-error – en vervolgens, na 2022, naar AI-fundamentmodellen die leerden van data op internetschaal in plaats van alleen handgemaakte simulaties.

Van regels naar reinforcement: het simulatie-tijdperk

Rond 2015 begonnen toonaangevende robotica-laboratoria handgeschreven regels te vervangen door reinforcement learning (RL) – een trainingsmethode waarbij een AI-agent beloningssignalen krijgt voor succesvolle acties en strafsignalen voor mislukkingen, en miljoenen keren iteraties om zijn eigen strategieën te ontdekken.

OpenAI's Dactyl-project, een vijfvingerige robothand die volledig in simulatie was getraind, toonde zowel de kracht als de kernbeperking van deze aanpak. Dactyl leerde kleine blokjes manipuleren door te trainen in digitale omgevingen – in wezen een virtuele fysica-engine – voordat hij op echte hardware werd ingezet. Het probleem: zelfs kleine discrepanties tussen de gesimuleerde wereld en de fysieke realiteit zorgden voor een sterke prestatievermindering.

De technische oplossing was domeinrandomisatie – het opzettelijk introduceren van willekeurige variatie over miljoenen gesimuleerde trainingsomgevingen. Wrijvingscoëfficiënten, verlichtingsomstandigheden, objectkleuren en oppervlaktestructureen werden willekeurig gevarieerd, zodat het getrainde beleid robuust genoeg zou zijn om de rommeligheid van de echte wereld aan te kunnen. De techniek werkte goed genoeg dat Dactyl uiteindelijk Rubiks Kubussen oploste – hoewel slechts 60% van de tijd bij standaardscrambles, dalend tot 20% bij moeilijkere configuraties.

Die cijfers zijn belangrijk om te begrijpen waar het veld op dat moment stond. Simulatie-getraind RL leverde indrukwekkende behendigheid op, maar de betrouwbaarheid was onvoldoende voor commerciële inzet. OpenAI sloot in 2021 zijn robotica-afdeling, wat het plafond weerspiegelde dat de techniek had bereikt.

De simulatie-naar-realiteit-kloof: belangrijkste technische uitdagingen

| Uitdaging | Beschrijving | Mitigatie gebruikt |

|---|---|---|

| Visuele mismatch | Kleuren en texturen verschillen van simulatie | Domeinrandomisatie |

| Fysieke eigenschappen | Wrijving, vervorming niet perfect gemodelleerd | Gerandomiseerde fysicaparameters |

| Sensorruis | Echte sensors introduceren latentie en fouten | Ruisinjectie in training |

| Mechanische slijtage | Actuatoren degraderen na verloop van tijd | Niet opgelost door sim-to-real alleen |

Hoe fundamentmodellen robots gezond verstand gaven

De komst van grote taalmodellen veranderde robotica diepgaander dan welke hardware-innovatie van het afgelopen decennium ook. De belangrijkste architecturale doorbraak was: LLM's leren door te voorspellen welk token (woord, subwoord of teken) als volgende komt in een reeks, waarbij ze enorme tekstcorpora verwerken om rijke interne representaties van taal en wereldkennis op te bouwen. Robotici stelden een voor de hand liggende maar transformerende vraag: zou dezelfde architectuur kunnen werken als de tokens sensoruitlezingen, camerabeelden en gewrichtsposities waren in plaats van woorden?

Google DeepMind's antwoord was RT-1 en de opvolger RT-2 (Robotic Transformer). RT-1 was getraind op 17 maanden teleoperatiegegevens met 700 verschillende taken, waarbij het camerabeelden en armgewrichtstoestanden van de robot als invoer kreeg en motorcommando's als uitvoer genereerde. Bij taken die het tijdens de training had gezien, behaalde het 97% succes. Bij volledig nieuwe instructies haalde het nog 76% – een dramatische verbetering ten opzichte van alles wat simulatie-only benaderingen hadden bereikt.

RT-2 ging verder door internet-schaal afbeeldingen en tekstdata te integreren, waardoor de robot een vorm van gezond verstand kreeg, geworteld in de bredere visuele wereld in plaats van alleen het roboticalab. Dit is de conceptuele sprong: in plaats van robots te programmeren met regels, of ze puur te trainen op robotspecifieke data, ontdekten onderzoekers dat algemene wereldkennis – de soort die in visie-taald modellen wordt ingebakken tijdens web-schaal pretraining – verrassend goed overdraagbaar bleek naar fysieke manipulatie taken.

De praktische implicatie is groot. Een robot die tijdens pretraining miljoenen afbeeldingen van keukens, laden en kopjes heeft gezien, arriveert met contextuele kennis die regelgebaseerde systemen nooit kunnen verwerven. Het is niet zeker welke kop de mens wil, maar het heeft een redelijke verwachting. Die verwachting vermindert dramatisch de hoeveelheid robotspecifieke trainingsdata die nodig is om bruikbare prestatieniveaus te bereiken.

De beperkingen die de industrie nog steeds tegenhouden

De huidige opwinding is echt, maar het is de moeite waard om in kaart te brengen wat nog steeds echt onopgelost is. Fundamentmodellen voor robotica hebben een dataprobleem dat niet in dezelfde vorm bestaat voor taalmodellen. Tekstdata is overvloedig, goedkoop en gemakkelijk van het web te schrapen. Hoogwaardige robotdemonstratiedata – divers, fysiek onderbouwd en nauwkeurig gelabeld – is duur om te verzamelen, hardware-afhankelijk en moeilijk over te dragen tussen robotmorfologieën.

Vroege sociale robots illustreren een andere beperking: capaciteit zonder betrouwbaarheid. Jibo, de door MIT ontwikkelde sociale thuisrobot die $3,7 miljoen aan crowdfunding ophaalde en $749 kostte, had een overtuigende visie, maar werd uiteindelijk ondermijnd door de pre-LLM taaltechnologie van zijn tijdperk. Zijn gesprekken vertrouwden op scriptmatige responsfragmenten die snel repetitief en oppervlakkig aanvoelden. De huidige stem-AI zou transformeren wat Jibo had kunnen zijn – maar de nieuwe generatie AI-aangedreven speelgoed brengt het tegenovergestelde risico met zich mee. Scriptmatige systemen konden niet ontsporen; generatieve AI-systemen kunnen dat absoluut wel, zoals gedocumenteerde gevallen van AI-companions die kinderen gevaarlijke adviezen gaven, hebben aangetoond.

Het veld heeft de ene reeks beperkingen (rigiditeit, breekbaarheid) ingeruild voor een andere (onvoorspelbaarheid, veiligheidsonzekerheid). Geen van beide problemen is volledig opgelost. Wat wel is veranderd, is dat de verbeteringstraject nu meetbaar steiler is.

Wat dit betekent voor roboticakopers en de hardwaremarkt

De AI-leerrevolutie is niet alleen een academisch verhaal – het hervormt al hardwarewaarderingen op manieren die er nu toe doen voor kopers en operators.

Robots waarvan de mogelijkheden waren vastgeklonken aan hun oorspronkelijke programmering, depreciëren snel in de huidige markt. Tweedehands industriële armen met vaste bewegingsprogramma's hebben een dalende restwaarde naarmate kopers steeds meer aanpasbaarheid verwachten. Ondertussen behouden hardwareplatforms die zijn ontworpen om op leren gebaseerde software te draaien – met toegankelijke rekenkracht, open API's en voldoende sensorladingen – hun waarde robuuster.

Voor kopers die vandaag aankopen evalueren, vallen verschillende implicaties op:

- Platformuitbreidbaarheid is net zo belangrijk als huidige capaciteit. Een cobot die moderne ML-inferentie lokaal draait, heeft een langere gebruiksduur dan een die vastzit aan leverancierspecifieke programmeeromgevingen.

- Tweedehandse hardwareprijzen weerspiegelen AI-gereedheid. Robots van platforms die grote op leren gebaseerde software-updates hebben ontvangen, behouden waarde; degenen die door hun fabrikanten zijn achtergelaten, worden aanzienlijk afgeprijsd.

- Datainfrastructuur is de nieuwe differentiator. Kopers die meerdere eenheden inzetten, moeten vanaf dag één plannen voor teleoperatiegegevensverzameling – die demonstratiedata wordt het trainingscorpus voor verbeterde prestaties.

Voor operators die instapdeployment overwegen, biedt de huidige tweedehands industriële robotmarkt toegang tot capabele hardware tegen gereduceerde kosten, hoewel kopers de roadmap voor software-updates zorgvuldig moeten beoordelen. Ook de groeiende cobot-categorie is bijzonder goed gepositioneerd om te profiteren van fundamentmodeldeployment, gezien de inherent flexibele, mens-gerelateerde operationele contexten van cobots.

Veelgestelde vragen

De belangrijkste drijfveer was de volwassenwording van AI-fundamentmodellen – specifiek de ontdekking dat visie-taald modellen getraind op internet-schaal data konden worden aangepast om robotmotorcommando's te genereren met een veel grotere generalisatie dan eerdere regelgebaseerde of simulatie-only benaderingen. Investeringen stegen nadat onderzoek aantoonde dat modellen zoals RT-2 nieuwe taken konden uitvoeren zonder taakspecifieke training, wat een geloofwaardig pad naar algemene robots ontsloot. Recente cijfers laten een verviervoudiging van investeringen jaar-op-jaar zien, tot $6,1 miljard.

Wat is domeinrandomisatie in robotica en waarom is het belangrijk?

Domeinrandomisatie is een simulatie-trainings techniek waarbij duizenden licht verschillende virtuele omgevingen worden gegenereerd tijdens training – variërend in verlichting, wrijving, objectkleuren en fysicaparameters willekeurig. Het adresseert de sim-to-real kloof (de prestatievermindering wanneer simulatie-getrainde beleidsmaatregelen op fysieke hardware worden uitgevoerd) door het geleerde beleid te dwingen robuust te zijn over veel mogelijke wereldconfiguraties. OpenAI's Dactyl gebruikte deze aanpak om Rubiks Kubussen op te lossen met een robothand, hoewel succespercentages plateauden op 60% voor standaardmoeilijkheidsniveaus.

Hoe verschillen fundamentmodellen voor robotica van standaard LLM's?

Standaard grote taalmodellen verwerken teksttokens als zowel invoer als uitvoer. Robotica-fundamentmodellen breiden deze architectuur uit om camerabeelden, dieptesensoruitlezingen en robotgewrichtsposities als extra invoertokens te behandelen, en motorsnelheidscommando's als uitvoertokens. De kerntaak – 'wat komt er nu gegeven eerdere context?' – blijft structureel vergelijkbaar. Het cruciale voordeel is dat pretraining op internet-schaal visuele en taaldata deze modellen wereldkennis en gezond verstand geeft die pure robotdemonstratiedata niet efficiënt kan bieden.

Zullen AI-adaptieve robots oudere vastgeprogrammeerde robots snel obsoleet maken?

Niet onmiddellijk. Vastgeprogrammeerde industriële robots blijven zeer kosteneffectief voor hoogvolume, laagvariatie taken zoals lassen en stampen, waar aanpasbaarheid geen waarde biedt. De druk op veroudering is het hoogst in logistiek met gemengde SKU's, lichte assemblage en serviceomgevingen waar taakvariabiliteit inherent is. Kopers moeten evalueren of hun specifieke taakprofiel daadwerkelijk profiteert van aanpasbaarheid voordat ze aannemen dat nieuwere AI-capabele platforms de meerprijs rechtvaardigen boven bewezen legacy-hardware.

Wat zijn de belangrijkste onopgeloste problemen in robotleren vandaag?

Drie uitdagingen blijven significant: (1) de hoge kosten en beperkte beschikbaarheid van diverse robotdemonstratiedata in vergelijking met tekstdata voor taalmodellen; (2) de veiligheidsonvoorspelbaarheid van generatieve AI-systemen die in fysieke omgevingen worden ingezet, vooral die interacteren met kwetsbare bevolkingsgroepen; en (3) betrouwbare behendige manipulatie – fijne motorische taken zoals kabels rijgen of vervormbare materialen hanteren overwinnen nog steeds de meeste huidige systemen in echte omstandigheden in plaats van gecontroleerde laboratoriuminstellingen.

De robot-leerrevolutie is echt, maar ze is niet voltooid. Fundamentmodellen hebben het plafond verbrijzeld dat regelgebaseerde systemen oplegden, en de investeringscijfers weerspiegelen echte technologische vooruitgang in plaats van pure speculatie. De kloof tussen sciencefictionrobots en inzetbare hardware is in de afgelopen drie jaar meer verkleind dan in de voorgaande drie decennia.

De volgende beperking is niet algoritmisch. Het is data, veiligheidsvalidatie en hardwarebetrouwbaarheid op schaal – de harde technische problemen die financiering alleen niet sneller kan versnellen dan een bepaald tempo.

Welke robot-leeraanpak – reinforcement learning, fundamentmodellen of teleoperatiegegevens – denk jij dat zal bepalen wie de humanoïde race wint?

Doe mee aan de discussie

Which robot learning approach — RL, foundation models, or teleoperation data — will determine who wins the humanoid race?