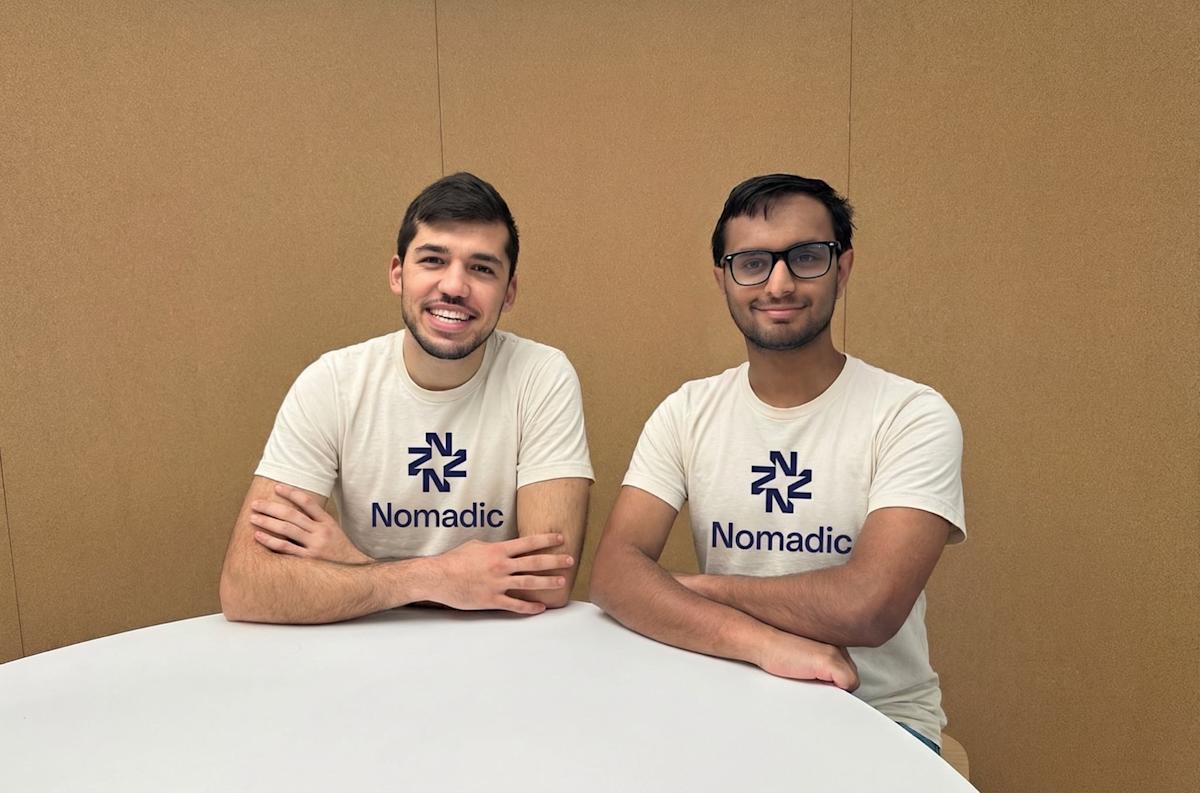

Autonome voertuigen en robots genereren meer sensordata dan de meeste organisaties daadwerkelijk kunnen gebruiken. Nomadic heeft $8,4 miljoen aan seed-financiering opgehaald om dat op te lossen — door een infrastructuurlaag te bouwen die ruwe AV- en robotbeelden met deep learning omzet in gestructureerde, doorzoekbare datasets. Daarmee pakt het een knelpunt aan dat de ontwikkeling van autonome systemen in de hele industrie stilletjes beperkt.

Inhoudsopgave

- Wat doet Nomadic precies?

- Waarom is AV- en robotdata zo moeilijk te beheren?

- Hoe werkt Nomadic's deep learning-aanpak?

- Wat betekent dit voor robotica en automatisering?

- Veelgestelde vragen

Wat doet Nomadic precies?

Nomadic bouwt een data-infrastructuurplatform dat ruwe video- en sensorbeelden van autonome voertuigen en robots omzet in gestructureerde, doorzoekbare datasets. In plaats van ruwe beelden die in opslag blijven liggen — duur om te bewaren, bijna niet te doorzoeken — gebruikt Nomadic's systeem deep learning-modellen om die data te taggen, classificeren en indexeren, zodat ingenieurs daadwerkelijk kunnen vinden wat ze nodig hebben.

Volgens TechCrunch positioneert de $8,4 miljoen seed-ronde Nomadic als infrastructuur voor de bredere Physical AI-stack — niet alleen voor AV-programma's, maar voor elk robotsysteem dat continue sensorstromen genereert die moeten worden omgezet in trainingssignaal.

Zie het als het verschil tussen een magazijn vol ongelabelde dozen en een volledig geïndexeerd inventoriesysteem. Het beeldmateriaal bestaat in beide gevallen, maar slechts één versie is operationeel bruikbaar. Die analogie schiet op schaal wel tekort — het probleem met AV-data is niet alleen het labelen, maar de combinatie van de enorme volumes, de kosten van menselijke annotatie en de schaarste aan veiligheidskritische randgevallen die verborgen zitten in uren routinebeelden.

Waarom is AV- en robotdata zo moeilijk te beheren?

Een enkel autonoom voertuig kan per dag tussen de 1 en 40 terabyte aan ruwe sensordata genereren, afhankelijk van de sensoruitrusting — camera's, LiDAR, radar, IMU. Een klein wagenpark van tien voertuigen die continu opereren, produceert per week meer data dan de meeste enterprise data-pijplijnen aankunnen.

Het probleem stapelt zich in twee richtingen op. Ten eerste lopen de opslagkosten snel op als petabyte-schaaldata bewaard moet blijven voor modeltraining, veiligheidsaudits en wettelijke toetsing. Ten tweede, en belangrijker, is het grootste deel van die data operationeel inert — het kan niet worden doorzocht, gefilterd of bovengehaald zonder aanzienlijke handmatige labelinspanning.

Voor roboticateams creëert dit een pijnlijke feedbacklus:

- Robots in het veld inzetten

- Enorme hoeveelheden sensordata verzamelen

- Worstelen om de specifieke faalscenario's, randgevallen of domeinspecifieke gebeurtenissen te extraheren die nodig zijn om het model te verbeteren

- Trainingsiteratie vertraagt

- Prestaties bij uitrol stagneren

Menselijke annotatieworkflows — de traditionele oplossing — zijn economisch niet schaalbaar. De labelkosten voor datasets voor autonoom rijden lagen historisch tussen $0,05 en $0,50 per frame, en een uur video op 30fps bevat 108.000 frames. De economie ontmoedigt teams actief om de volledige data-uitstoot van hun wagenpark te benutten.

Hoe werkt Nomadic's deep learning-aanpak?

Nomadic's kerntoepassing past deep learning-modellen toe op ruwe beelden om automatisch semantische structuur uit sensorstromen te halen. In plaats van dat ingenieurs beeldmateriaal handmatig moeten labelen voordat het doorzoekbaar wordt, leidt het platform af wat er in een scène gebeurt, tagt het gebeurtenissen en objecten, en organiseert het de output in doorzoekbare vorm.

De praktische implicatie is aanzienlijk: robotica- en AV-teams kunnen natuurlijke-taal- of gestructureerde queries uitvoeren — "toon me alle gevallen waarin het voertuig een voetganger naderde op minder dan 2 meter in de regen" — en relevante clips uit miljoenen uren beeldmateriaal halen zonder handmatige controle.

Deze aanpak weerspiegelt wat moderne vectordatabases doen voor ongestructureerde tekst, maar toegepast op multimodale sensordata waaronder video, puntwolken en IMU-stromen. Het deep learning-model fungeert als een automatische annotatielaag, waardoor de kosten per gelabeld voorbeeld drastisch dalen terwijl de dichtheid van extraheerbaar signaal uit bestaande data toeneemt.

Nomadic versus traditionele data-pijplijnbenaderingen

| Benadering | Annotatiekosten | Query-snelheid | Schaalbaarheid | Terugvinden randgevallen |

|---|---|---|---|---|

| Handmatig labelen | Hoog ($0,05–$0,50/frame) | Langzaam | Slecht | Afhankelijk van beoordelaar |

| Regelgebaseerd automatisch taggen | Laag | Snel | Matig | Mist nieuwe gebeurtenissen |

| Nomadic deep learning | Laag–Gemiddeld | Snel | Hoog | Sterk op getrainde categorieën |

| Geen pijplijn (ruwe opslag) | Geen | Geen | Hoog (kosten) | Nul |

Het vermelden waard: deep learning-gebaseerde annotatie erft de blinde vlekken die in de trainingsverdeling van het model zitten. Voor zeldzame, veiligheidskritische randgevallen — precies de gebeurtenissen die het meest waardevol zijn voor training — kan een model dat niet genoeg voorbeelden heeft gezien, ze mogelijk niet betrouwbaar naar boven halen. Nomadic's langetermijnwaardepropositie hangt waarschijnlijk af van hoe goed de modellen generaliseren over uiteenlopende robot- en voertuigimplementaties.

Wat betekent dit voor robotica en automatisering?

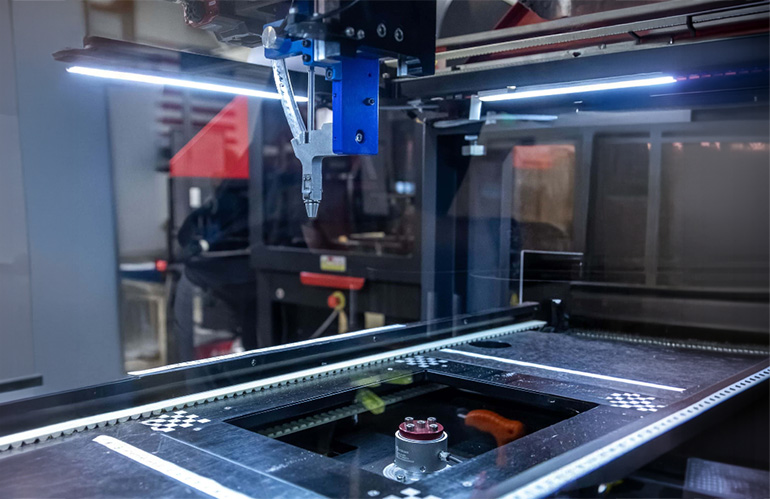

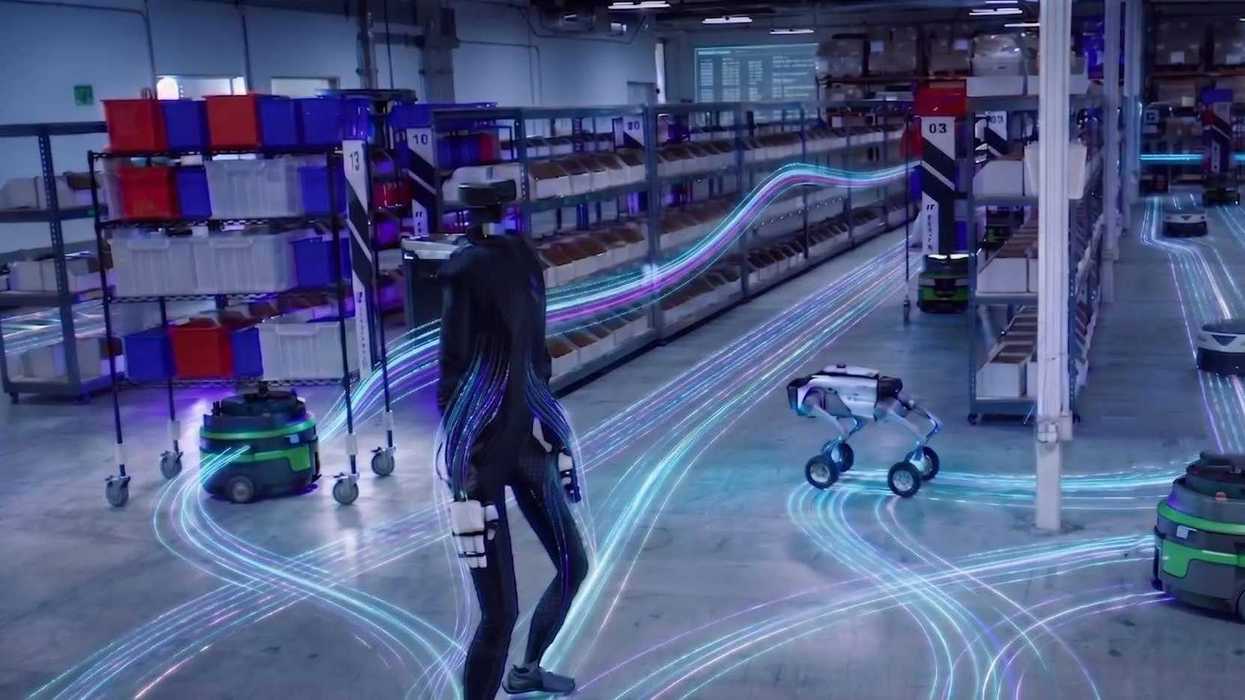

Het dataknelpunt dat Nomadic aanpakt, is niet uniek voor autonome voertuigen. Het is hetzelfde probleem waarmee warehouse AMR's (autonome mobiele robots), industriële inspectierobots, agrarische automatiseringssystemen en humanoïde robotprogramma's worden geconfronteerd — elk embodied AI-systeem dat continu perceptiedata genereert in de echte wereld.

Voor teams die robotvloten beheren of aanschaffen, is dit op twee concrete manieren van belang.

Trainingssnelheid: De snelheid waarmee een robotsysteem verbetert, wordt direct beperkt door hoe snel teams betekenisvolle trainingssignalen uit implementatiedata kunnen halen. Infrastructuur die die cyclus versnelt — zelfs met een factor 2–3 — verkort de verbeteringstijdlijn evenredig.

Vlootintelligentie op schaal: Naarmate robotvloten groeien, reikt de operationele waarde van die sensordata verder dan modeltraining. Gestructureerde data maakt anomaliedetectie, voorspellende onderhoudssignalen en prestatiebenchmarking tussen eenheden mogelijk — waardoor de robotvloot zelf een continu zelfdocumenterend systeem wordt.

Voor operators die gebruikte of gerenoveerde robotimplementaties overwegen — waar sensorconfiguraties kunnen variëren en bestaande datasets minder samengesteld zijn — worden platforms zoals Nomadic bijzonder relevant. Het voeden van velddata van gebruikte industriële robots terug in gestructureerde trainingspijplijnen was historisch een handmatig, duur proces. Geautomatiseerde structureringsinfrastructuur verandert die rekensom.

Het bedrag van $8,4 miljoen aan seed-financiering geeft ook aan waar infrastructuurinvesteringen in de Physical AI-stack naartoe gaan. Hardware — de robots zelf — trekt de aandacht. Maar de datalaag tussen implementatie en modelverbetering is steeds vaker waar concurrentievoordeel wordt opgebouwd en waar kapitaal zich begint te concentreren.

Operators die gebruikte cobots te koop evalueren of kleinschalige automatiseringsprogramma's opzetten, moeten datapijplijnkosten meenemen in de totale implementatiekosten — een vraag waar Nomadic zich direct op positioneert.

Veelgestelde vragen

Nomadic is een data-infrastructuurbedrijf dat deep learning gebruikt om ruwe sensorbeelden van autonome voertuigen en robots om te zetten in gestructureerde, doorzoekbare datasets. Het lost het schalingsprobleem van autonome systeemdata op — waarbij enorme hoeveelheden beeldmateriaal in het veld worden gegenereerd maar operationeel onbruikbaar blijven zonder dure handmatige annotatie.

Hoeveel data genereert een autonoom voertuig per dag?

Een enkel autonoom voertuig genereert doorgaans tussen de 1 en 40 terabyte aan ruwe sensordata per dag, afhankelijk van de camera-, LiDAR- en radarconfiguratie. Een wagenpark van tien voertuigen kan wekelijks honderden terabytes verzamelen, wat handmatige verwerking op schaal economisch onhoudbaar maakt.

Hoe verschilt Nomadic's deep learning-aanpak van handmatig labelen?

Handmatig labelen kost tussen $0,05 en $0,50 per frame, wat op vlootschaal prohibitief duur is. Nomadic past deep learning-modellen toe om beelden automatisch te taggen en indexeren, waardoor ingenieurs grote datasets kunnen doorzoeken zonder frame-voor-frame menselijke controle — wat de annotatiekosten en tijd tot inzicht aanzienlijk vermindert.

Heeft het dataknelpunt ook invloed op robots anders dan autonome voertuigen?

Ja. Elk embodied AI-systeem — warehouse AMR's, inspectierobots, agrarische automatisering, humanoïde platforms — genereert continue sensordata die dezelfde structurerings- en terugvinduitdagingen kent. Het probleem schaalt mee met de vlootgrootte en operationele uren, ongeacht de specifieke robottoepassing.

Wat betekent deze financiering voor het bredere Physical AI-ecosysteem?

De seed-ronde van $8,4 miljoen geeft aan dat investeerders steeds meer erkennen dat de data-infrastructuurlaag — niet alleen hardware of kern-AI-modellen — een kritiek knelpunt is in de ontwikkeling van autonome systemen. Infrastructuurinvesteringen in datapijplijnen zijn een belangrijke indicator van volwassen wordende Physical AI-implementatieprogramma's.

De data-uitstoot van autonome systemen is altijd enorm geweest. Het ontbrekende stuk was de infrastructuur om het om te zetten in bruikbaar signaal. Nomadic's aanpak — deep learning toepassen als een automatische structureringslaag — pakt een beperking aan die van invloed is op elke organisatie die robots of voertuigen op schaal inzet. De seed-financiering zal het probleem niet van de ene op de andere dag oplossen, maar het markeert een duidelijke richtinggevende gok dat de datalaag de volgende concurrentierand in Physical AI wordt.

Is de data-pijplijninfrastructuur het knelpunt dat de verbetering van uw robotvloot beperkt — of is de hardware nog de beperkende factor?

Doe mee aan de discussie

Is data pipeline infrastructure the bottleneck limiting your robot fleet — or is hardware still the constraint?