Investidores despejaram US$ 6,1 bilhões em robôs humanoides em um único ano recente — quatro vezes o total do ano anterior. Esse surto de capital não veio de motores melhores ou atuadores mais baratos. Veio de um avanço fundamental em como os robôs aprendem, um avanço que vem se construindo silenciosamente desde 2015 e agora tornou o robô de ficção científica um alvo plausível de engenharia.

- Por que o aprendizado de robôs mudou tudo depois de 2015

- Das regras ao reforço: a era da simulação

- Como os modelos fundacionais deram senso comum aos robôs

- Os limites que ainda seguram a indústria

- O que isso significa para compradores de robótica e o mercado de hardware

- Perguntas frequentes

Por que o aprendizado de robôs mudou tudo depois de 2015

Durante a maior parte da história da robótica, inteligência significava regras — milhares de instruções escritas à mão por engenheiros para cobrir todas as situações previsíveis. Um braço robótico dobrando roupa precisava de lógica explícita para orientação da manga, rigidez do tecido, detecção de colarinho e dezenas de casos extremos. O conjunto de regras explodia em complexidade antes mesmo de se tornar confiável.

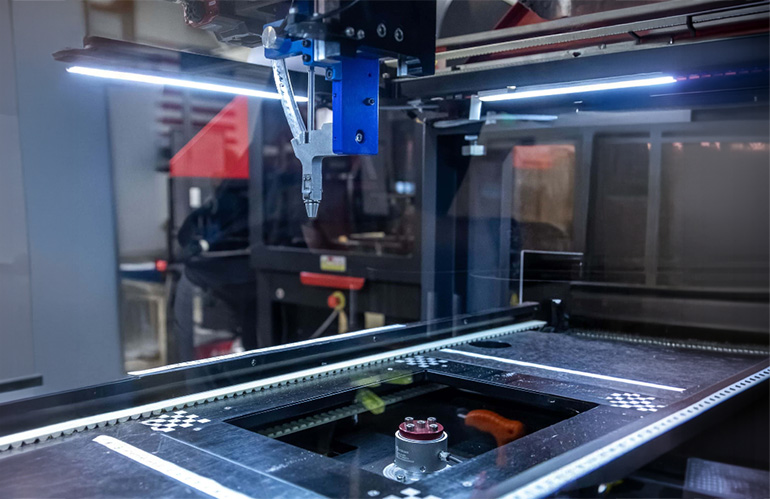

Essa abordagem produziu robôs industriais confiáveis para ambientes estruturados — linhas de solda, células pick-and-place, sistemas de transporte — mas não conseguia generalizar. Mova o mesmo braço para um contexto diferente, mude a iluminação, introduza uma nova forma de objeto, e o desempenho desabava imediatamente.

A lacuna entre o que os robôs podiam fazer e o que os pesquisadores sonhavam que eles poderiam fazer permanecia teimosamente grande. Então, por volta de 2015, a metodologia mudou.

De acordo com o mergulho profundo do MIT Technology Review na história contemporânea do aprendizado de robôs, a mudança crucial foi passar da codificação de regras para tentativa e erro orientada por dados — e depois, após 2022, para modelos fundacionais de IA que aprenderam com dados em escala de internet, em vez de apenas simulações artesanais.

Das regras ao reforço: a era da simulação

Por volta de 2015, os principais laboratórios de robótica começaram a substituir regras escritas à mão por aprendizado por reforço (RL) — um método de treinamento onde um agente de IA recebe sinais de recompensa por ações bem-sucedidas e sinais de penalidade por falhas, então itera milhões de vezes para descobrir suas próprias estratégias.

O projeto Dactyl da OpenAI, uma mão robótica de cinco dedos treinada inteiramente em simulação, demonstrou tanto o poder quanto a limitação central dessa abordagem. Dactyl aprendeu a manipular pequenos cubos treinando em ambientes digitais — essencialmente um motor de física virtual — antes de ser implantado em hardware real. O problema: mesmo discrepâncias menores entre o mundo simulado e a realidade física faziam o desempenho cair drasticamente.

A solução de engenharia foi a randomização de domínio — introduzir deliberadamente variação aleatória em milhões de ambientes de treinamento simulados. Coeficientes de atrito, condições de iluminação, cores de objetos e texturas de superfície eram variados aleatoriamente para que a política treinada fosse robusta o suficiente para lidar com a bagunça do mundo real. A técnica funcionou bem o suficiente para que Dactyl eventualmente resolvesse Cubos Mágicos — embora apenas 60% das vezes em embaralhamentos padrão, caindo para 20% em configurações mais difíceis.

Esses números importam para entender onde o campo estava na época. O RL treinado em simulação produziu destreza genuinamente impressionante, mas a confiabilidade era insuficiente para implantação comercial. A OpenAI fechou sua divisão de robótica em 2021, refletindo o teto que a técnica havia atingido.

A Lacuna Simulação-para-Realidade: Principais Desafios Técnicos

| Desafio | Descrição | Mitigação Usada |

|---|---|---|

| Incompatibilidade visual | Cores e texturas diferem da simulação | Randomização de domínio |

| Propriedades físicas | Atrito, deformação não perfeitamente modelados | Parâmetros físicos randomizados |

| Ruído de sensor | Sensores reais introduzem latência e erro | Injeção de ruído no treinamento |

| Desgaste mecânico | Atuadores degradam com o tempo | Não resolvido apenas por sim-para-real |

Como os modelos fundacionais deram senso comum aos robôs

A chegada dos grandes modelos de linguagem mudou a robótica mais profundamente do que qualquer avanço de hardware na última década. A percepção chave foi arquitetural: LLMs aprendem prevendo qual token (palavra, subpalavra ou caractere) vem a seguir em uma sequência, ingerindo vastos corpora de texto para construir representações internas ricas da linguagem e do conhecimento do mundo. Os roboticistas fizeram uma pergunta óbvia, mas transformadora — a mesma arquitetura poderia funcionar se os tokens fossem leituras de sensores, quadros de câmera e posições de juntas em vez de palavras?

A resposta do Google DeepMind foi o RT-1 e seu sucessor RT-2 (Robotic Transformer). O RT-1 foi treinado em 17 meses de dados de teleoperação cobrindo 700 tarefas distintas, recebendo visualizações da câmera do robô e estados das juntas do braço como entradas e gerando comandos motores como saídas. Em tarefas que vira durante o treinamento, alcançou 97% de sucesso. Em instruções totalmente novas, ainda conseguiu 76% — uma melhoria dramática em relação a qualquer abordagem apenas de simulação.

O RT-2 foi além ao incorporar dados de imagem e texto em escala de internet, dando ao robô uma forma de senso comum fundamentada no mundo visual mais amplo, não apenas no laboratório de robótica. Este é o salto conceitual chave: em vez de programar robôs com regras, ou treiná-los puramente em dados específicos de robôs, os pesquisadores descobriram que o conhecimento geral do mundo — o tipo embutido em modelos de visão-linguagem durante o pré-treinamento em escala web — transferia-se surpreendentemente bem para tarefas de manipulação física.

A implicação prática é significativa. Um robô que viu milhões de imagens de cozinhas, gavetas e copos durante o pré-treinamento chega com um entendimento contextual que sistemas baseados em regras nunca poderiam adquirir. Não tem certeza de qual copo o humano quer, mas tem um prior razoável. Esse prior reduz drasticamente a quantidade de dados de treinamento específicos de robôs necessária para alcançar níveis de desempenho úteis.

Os limites que ainda seguram a indústria

O entusiasmo atual é real, mas vale mapear o que permanece genuinamente não resolvido. Os modelos fundacionais para robótica enfrentam um problema de dados que não existe para modelos de linguagem da mesma forma. Dados de texto são abundantes, baratos e facilmente extraídos da web. Dados de demonstração robótica de alta qualidade — diversos, fisicamente fundamentados e rotulados com precisão — são caros de coletar, dependentes de hardware e difíceis de transferir entre morfologias de robôs.

Robôs sociais antigos ilustram uma limitação diferente: capacidade sem confiabilidade. O Jibo, o robô social doméstico desenvolvido pelo MIT que arrecadou US$ 3,7 milhões em crowdfunding e foi vendido a US$ 749, tinha uma visão convincente, mas foi, em última análise, prejudicado pela tecnologia de linguagem pré-LLM de sua época. Suas conversas dependiam de trechos de resposta scriptados que rapidamente pareciam repetitivos e superficiais. A IA de voz de hoje transformaria o que Jibo poderia ter sido — mas a nova geração de brinquedos alimentados por IA introduz o risco oposto. Sistemas scriptados não podiam sair dos trilhos; sistemas generativos de IA absolutamente podem, como casos documentados de companheiros de IA dando orientações perigosas a crianças demonstraram.

O campo trocou um conjunto de limitações (rigidez, fragilidade) por outro (imprevisibilidade, incerteza de segurança). Nenhum dos problemas está totalmente resolvido. O que mudou é que a trajetória de melhoria agora é mensuravelmente mais íngreme.

O que isso significa para compradores de robótica e o mercado de hardware

A revolução do aprendizado de IA não é apenas uma história acadêmica — já está remodelando as avaliações de hardware de maneiras que importam para compradores e operadores agora.

Robôs cujas capacidades estavam presas à sua programação original depreciam rapidamente no mercado atual. Braços industriais de segunda geração com programas de movimento fixos têm valor de revenda em declínio, à medida que os compradores esperam cada vez mais adaptabilidade. Enquanto isso, plataformas de hardware projetadas para executar software baseado em aprendizado — com computação acessível, APIs abertas e cargas úteis de sensores suficientes — estão mantendo valor de forma mais robusta.

Para compradores avaliando aquisições hoje, várias implicações se destacam:

- A extensibilidade da plataforma importa tanto quanto a capacidade atual. Um cobot que executa inferência moderna de ML localmente terá uma vida útil mais longa do que um preso a ambientes de programação específicos do fornecedor.

- O preço do hardware usado reflete a prontidão para IA. Robôs de plataformas que receberam grandes atualizações de software baseadas em aprendizado mantêm valor; aqueles abandonados por seus fabricantes estão com descontos significativos.

- A infraestrutura de dados é o novo diferencial. Compradores implantando múltiplas unidades devem planejar a coleta de dados de teleoperação desde o primeiro dia — esses dados de demonstração se tornam o corpus de treinamento para desempenho aprimorado.

Para operadores considerando implantação de nível básico, o atual mercado de robôs industriais usados oferece acesso a hardware capaz a custo reduzido, embora os compradores devam avaliar cuidadosamente os roteiros de atualização de software. Da mesma forma, a crescente categoria de cobots está particularmente bem posicionada para se beneficiar da implantação de modelos fundacionais, dados os contextos operacionais inerentemente flexíveis e adjacentes a humanos dos cobots.

Perguntas frequentes

O principal impulsionador foi o amadurecimento dos modelos fundacionais de IA — especificamente, a descoberta de que modelos de visão-linguagem treinados em dados em escala de internet podiam ser adaptados para gerar comandos motores de robôs com generalização muito maior do que as abordagens anteriores baseadas em regras ou apenas simulação. O investimento disparou depois que pesquisas demonstraram que modelos como o RT-2 podiam realizar tarefas novas sem treinamento específico para a tarefa, desbloqueando um caminho crível para robôs de uso geral. Números recentes mostram o investimento quadruplicando ano a ano, atingindo US$ 6,1 bilhões.

O que é randomização de domínio em robótica e por que isso importa?

Randomização de domínio é uma técnica de treinamento em simulação onde milhares de ambientes virtuais ligeiramente diferentes são gerados durante o treinamento — variando iluminação, atrito, cores de objetos e parâmetros físicos aleatoriamente. Ela aborda a lacuna sim-para-real (a degradação de desempenho quando políticas treinadas em simulação são executadas em hardware físico) forçando a política aprendida a ser robusta em muitas configurações possíveis do mundo. O Dactyl da OpenAI usou essa abordagem para resolver Cubos Mágicos com uma mão robótica, embora as taxas de sucesso tenham estabilizado em 60% para níveis de dificuldade padrão.

Como os modelos fundacionais para robótica diferem dos LLMs padrão?

Grandes modelos de linguagem padrão processam tokens de texto como entrada e saída. Os modelos fundacionais de robótica estendem essa arquitetura para tratar quadros de câmera, leituras de sensores de profundidade e posições de juntas do robô como tokens de entrada adicionais, e comandos de velocidade do motor como tokens de saída. A tarefa central de previsão — "o que vem a seguir dado o contexto anterior?" — permanece estruturalmente similar. A vantagem crítica é que o pré-treinamento em dados visuais e de linguagem em escala de internet dá a esses modelos conhecimento do mundo e senso comum que dados puros de demonstração robótica não podem fornecer de forma eficiente.

Robôs adaptáveis com IA tornarão obsoletos rapidamente os robôs fixos mais antigos?

Não imediatamente. Robôs industriais de programa fixo continuam altamente custo-efetivos para tarefas de alto volume e baixa variação, como soldagem e estampagem, onde a adaptabilidade não agrega valor. A pressão de obsolescência é maior em logística de SKU misto, montagem leve e ambientes de serviço onde a variabilidade de tarefas é inerente. Os compradores devem avaliar se seu perfil específico de tarefa realmente se beneficia da adaptabilidade antes de assumir que plataformas mais novas capazes de IA justificam o prêmio de preço sobre hardware legado comprovado.

Quais são os principais problemas não resolvidos no aprendizado de robôs hoje?

Três desafios permanecem significativos: (1) o alto custo e a disponibilidade limitada de dados diversos de demonstração robótica em comparação com dados de texto para modelos de linguagem; (2) a imprevisibilidade de segurança de sistemas generativos de IA implantados em ambientes físicos, particularmente aqueles que interagem com populações vulneráveis; e (3) manipulação dextra confiável — tarefas motoras finas como enfiar cabos ou manusear materiais deformáveis ainda derrotam a maioria dos sistemas atuais em condições do mundo real, em vez de ambientes de laboratório controlados.

A revolução do aprendizado de robôs é real, mas não está terminada. Os modelos fundacionais quebraram o teto que os sistemas baseados em regras impunham, e os números de investimento refletem progresso tecnológico genuíno, não pura especulação. A lacuna entre robôs de ficção científica e hardware implantável se estreitou mais nos últimos três anos do que nas três décadas anteriores.

A próxima restrição não é algorítmica. São dados, validação de segurança e confiabilidade de hardware em escala — os problemas difíceis de engenharia que apenas o financiamento não pode acelerar além de um certo ritmo.

Qual abordagem de aprendizado de robôs — aprendizado por reforço, modelos fundacionais ou dados de teleoperação — você acha que determinará quem vence a corrida dos humanoides?

Participe da discussão

Which robot learning approach — RL, foundation models, or teleoperation data — will determine who wins the humanoid race?