La mayoría de los benchmarks de navegación robótica entregan la solución antes incluso de que empiece la prueba: mapas predefinidos, objetos etiquetados y entornos estructurados. El Instituto de Robótica de la Universidad Carnegie Mellon está quitando deliberadamente esa red de seguridad. Su nuevo Desafío de Navegación por Visión y Lenguaje (VLN) elimina por completo la «ground truth», obligando a los sistemas participantes a interpretar datos sensoriales en bruto, razonar sobre espacios desconocidos y seguir instrucciones en lenguaje natural sin atajos precargados.

- ¿Qué es el Desafío de Navegación por Visión y Lenguaje de la CMU?

- Por qué eliminar la ground truth lo cambia todo

- Cómo funciona el desafío: de la simulación a robots reales

- ¿Qué aplicaciones desbloquea esta investigación?

- Qué significa esto para la robótica

- Preguntas frecuentes

¿Qué es el Desafío de Navegación por Visión y Lenguaje de la CMU?

El Desafío VLN es un concurso de investigación organizado por el Instituto de Robótica de la Universidad Carnegie Mellon que pone a prueba la capacidad de los sistemas autónomos para interpretar instrucciones en lenguaje natural y moverse por entornos físicos reales y sin estructurar, sin mapas previos ni datos de objetos etiquetados. Los equipos se encargan del software de razonamiento; la CMU aporta la plataforma hardware.

El desafío está en el centro de un campo que cada vez se conoce más como IA Física: la disciplina que convierte la comprensión lingüística y perceptiva en acciones fiables y encarnadas. Conseguir que un robot escuche «ve a la cocina y busca algo donde sentarte» y lo ejecute de verdad en un edificio que nunca ha visto sigue siendo uno de los problemas más difíciles y abiertos de la robótica. Según el Instituto de Robótica de Carnegie Mellon, esta fase del concurso está pensada específicamente para cerrar la brecha entre las demostraciones pulidas de laboratorio y la verdadera capacidad autónoma.

Por qué eliminar la ground truth lo cambia todo

La decisión más importante de esta edición es precisamente la eliminación de la ground truth: las etiquetas predefinidas, las identidades de objetos y las coordenadas espaciales que la mayoría de los benchmarks proporcionan de forma implícita. Obliga a los sistemas a hacer lo que hacemos los humanos de manera natural: llegar a un sitio nuevo y entenderlo sobre la marcha.

En los benchmarks VLN tradicionales, un robot puede «saber» que el objeto que tiene delante es una silla porque una etiqueta del dataset se lo dice. Aquí, los sistemas deben inferirlo únicamente a partir de datos LiDAR en bruto (detección y medición por luz, un sensor que genera nubes de puntos 3D con pulsos láser) y imágenes de cámara de 360 grados, exactamente los mismos que recibiría en un despliegue real.

La exigencia más profunda es el razonamiento semántico y espacial: no solo identificar qué es un objeto, sino entender qué función cumple en el contexto. Jingfan Tang, estudiante de intercambio del RI procedente de la Universidad Jiao Tong de Shanghái y coordinador del desafío, lo explicó con claridad: «Un pasillo no es solo un espacio estrecho. Conecta distintas habitaciones y determina cómo se mueven las personas dentro del edificio». Un sistema que solo clasifique un pasillo como «corredor» sin captar su función de conexión tomará decisiones de navegación deficientes en cuanto las instrucciones se vuelvan contextuales: «encuéntrame junto al pasillo cerca de la sala de conferencias».

Justo ahí es donde suelen fallar los sistemas de navegación basados en modelos de lenguaje grandes. Pueden analizar las instrucciones con fluidez, pero pierden coherencia cuando su modelo espacial del entorno es ambiguo o incompleto.

Cómo funciona el desafío: de la simulación a robots reales

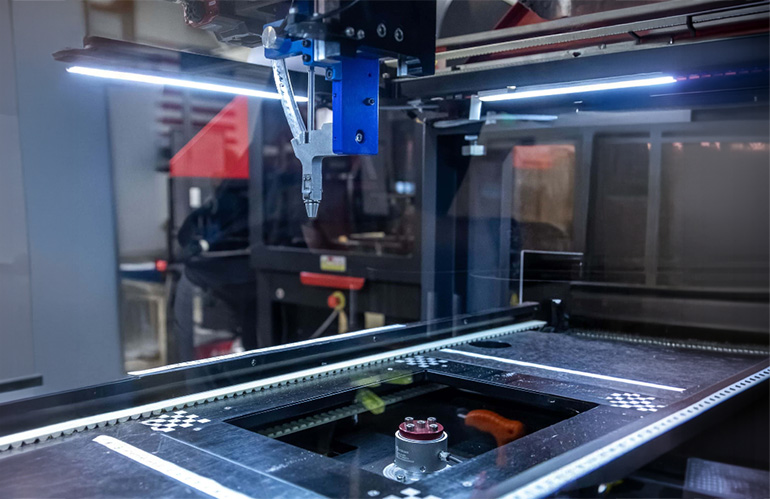

El concurso tiene una estructura de dos fases que eleva progresivamente el nivel de exigencia. Los equipos comienzan en un entorno de simulación a medida, donde desarrollan y someten a prueba sus arquitecturas de razonamiento sin limitaciones de hardware. La segunda fase los lleva a pruebas con robots físicos en la plataforma de la CMU —equipada con LiDAR 3D y cámara de 360 grados—, donde el ruido sensorial, las variaciones de luz y la incertidumbre física se vuelven factores inevitables.

| Fase | Entorno | Enfoque principal |

|---|---|---|

| Fase 1 | Simulación personalizada | Desarrollo de algoritmos, razonamiento semántico |

| Fase 2 | Hardware de robot real | Integración de sensores, robustez en el mundo real |

| Presentación final | IROS 2026, Pittsburgh | Resultados e intercambio de investigación |

Los equipos solo son responsables de la pila de software de razonamiento y navegación: el flujo que convierte datos de sensores y lenguaje en comandos de movimiento. La CMU suministra la plataforma física, de modo que la barrera de entrada se centra en la inteligencia y no en el acceso al hardware.

El desafío culminará con un taller en la Conferencia Internacional IEEE/RSJ de Robots y Sistemas Inteligentes (IROS) 2026, que se celebrará en Pittsburgh, donde los equipos presentarán sus resultados a la comunidad investigadora. Ji Zhang, científico de sistemas del RI que asesora al grupo, señaló que la CMU está especialmente bien situada para este reto gracias a su larga trayectoria construyendo sistemas que funcionan fuera de laboratorios controlados.

¿Qué aplicaciones desbloquea esta investigación?

Los avances que busca este desafío tienen implicaciones directas en varios ámbitos de despliegue robótico. Ji Zhang fue claro sobre lo que está en juego: «Los progresos en navegación por visión y lenguaje pueden dar lugar a asistentes domésticos más capaces, robots de búsqueda y rescate más eficaces y herramientas más inteligentes para la industria».

Desglosándolo por sectores:

Robótica de servicio y doméstica — Un asistente robótico capaz de recibir instrucciones habladas y moverse por una casa desconocida sin plano precargado supondría un salto enorme en usabilidad. Los robots domésticos actuales dependen casi siempre de sesiones iniciales de mapeo antes de poder operar con fiabilidad.

Búsqueda y rescate — Los escenarios de catástrofe son lo contrario de los conjuntos de datos estructurados. Los edificios se derrumban, los pasillos quedan bloqueados y no hay mapas previos. Robots que razonen espacialmente a partir de datos en tiempo real y respondan a instrucciones en lenguaje natural podrían operar donde fallan los sistemas basados en GPS o mapas.

Automatización industrial y logística — Los almacenes cambian de distribución. Las instalaciones nuevas requieren remapeado constante. Un sistema de navegación que infiera relaciones espaciales a partir de observaciones en bruto, en lugar de mapas preprogramados, reduce drásticamente la carga de integración al desplegar robots móviles autónomos en entornos dinámicos. Puedes explorar robots industriales en Botmarket para ver cómo las generaciones actuales manejan entornos estructurados; la investigación VLN apunta precisamente hacia donde debe ir la siguiente generación.

Qué significa esto para la robótica

El Desafío VLN de la CMU es una herramienta de calibración para todo el campo de la IA encarnada: obliga a confrontar el rendimiento en benchmarks con la robustez real.

Para los desarrolladores de hardware, el desafío señala dónde deben evolucionar los conjuntos de sensores. Los sistemas que dependen solo de LiDAR tienen dificultades con la semántica; los que usan solo cámaras luchan con la percepción de profundidad. La combinación que exige este reto impulsa la investigación en fusión sensorial.

Para los equipos de software e IA, eliminar la ground truth es un desafío directo a los enfoques actuales de modelos fundacionales. Los LLM y los modelos visión-lenguaje han demostrado gran capacidad para seguir instrucciones en entornos controlados. La pregunta que plantea este desafío es si esa capacidad sobrevive al contacto con la realidad física ruidosa, sin etiquetar y en bruto.

Para los compradores y operadores de robots móviles autónomos (AMR), especialmente en logística, sanidad y gestión de instalaciones, el flujo de investigación que alimenta desafíos como este alimenta directamente la próxima generación de hardware desplegable. Los sistemas que navegan sin mapeo previo reducen de forma significativa las fricciones de despliegue. Si estás evaluando robots colaborativos usados en venta o plataformas móviles autónomas, las capacidades que se están poniendo a prueba aquí representan lo que el mercado comercial ofrecerá en las próximas generaciones de hardware.

Su importancia más amplia es la creación de estándares. Uno de los objetivos explícitos es establecer un nuevo benchmark global para la IA Física, asegurando que las afirmaciones de inteligencia en investigación se traduzcan en acciones autónomas fiables en entornos no estructurados.

Preguntas frecuentes

Es un concurso de investigación organizado por el Instituto de Robótica de la Universidad Carnegie Mellon en el que los equipos desarrollan sistemas de software que permiten a los robots interpretar instrucciones en lenguaje natural y navegar por entornos físicos desconocidos usando solo datos de sensores en bruto, sin mapas predefinidos, objetos etiquetados ni información ambiental estructurada.

¿Qué hardware utilizan los participantes en el desafío?

La CMU proporciona una plataforma robótica equipada con sensores LiDAR 3D y una cámara de 360 grados. Los equipos se centran exclusivamente en construir el software de razonamiento y navegación que procesa esos datos y dirige la toma de decisiones del robot.

¿Por qué es importante eliminar la ground truth para la robótica del mundo real?

La ground truth —identidades de objetos pre-etiquetadas y coordenadas espaciales— no existe en despliegues reales. Eliminarla obliga a los sistemas a comportarse como lo harían en la práctica: infiriendo qué son los objetos y cómo se relacionan los espacios solo a partir de datos sensoriales en bruto. Así, el rendimiento en el benchmark se convierte en un predictor mucho más fiable de la capacidad real.

¿Cuándo y dónde concluye el Desafío VLN?

El desafío termina con un taller en la Conferencia Internacional IEEE/RSJ de Robots y Sistemas Inteligentes (IROS) 2026, que se celebrará en Pittsburgh. Los equipos presentarán sus resultados y hallazgos a la comunidad amplia de robótica e inteligencia artificial.

¿Cómo pueden registrarse los investigadores para el Desafío VLN?

Los investigadores pueden registrarse y consultar todos los detalles en el sitio web del Desafío VLN, gestionado por la iniciativa AI-Meets-Autonomy que coordina el concurso.

¿Qué industrias se benefician más de los avances en navegación por visión y lenguaje?

Las aplicaciones de mayor impacto son la robótica doméstica y de servicios (navegación en hogares desconocidos), las operaciones de búsqueda y rescate (entornos de desastre sin estructura) y la logística industrial (almacenes dinámicos donde los mapas cambian con frecuencia). Las tres requieren razonamiento espacial sin necesidad de conocimiento previo del entorno.

El Desafío VLN de la CMU supone un empujón deliberado contra el techo cómodo de la robótica de benchmarks: cambia los conjuntos de datos estructurados por el desorden del mundo real. Si la comunidad investigadora consigue estar a la altura de ese estándar o no marcará la trayectoria de la IA Física desplegable en los próximos años.

¿Qué sector —robótica doméstica, búsqueda y rescate o logística industrial— crees que se beneficiará primero de la navegación sin ground truth?

Únete a la discusión

Which sector do you think deploys ground-truth-free navigation first — home robotics, rescue, or logistics?