Los vehículos autónomos y los robots generan más datos de sensores de los que la mayoría de las organizaciones pueden realmente utilizar. Nomadic ha recaudado 8,4 millones de dólares en financiación semilla para solucionarlo, construyendo una capa de infraestructura que convierte las imágenes en bruto de AV y robots en conjuntos de datos estructurados y buscables mediante aprendizaje profundo, abordando un cuello de botella que limita silenciosamente el ritmo de desarrollo de sistemas autónomos en toda la industria.

Tabla de contenidos

- ¿Qué hace realmente Nomadic?

- ¿Por qué es tan difícil gestionar los datos de AV y robots?

- ¿Cómo funciona el enfoque de aprendizaje profundo de Nomadic?

- ¿Qué significa esto para la robótica y la automatización?

- Preguntas frecuentes

¿Qué hace realmente Nomadic?

Nomadic está construyendo una plataforma de infraestructura de datos que transforma el vídeo en bruto y las imágenes de sensores capturadas por vehículos autónomos y robots en conjuntos de datos estructurados y consultables. En lugar de que las imágenes en bruto permanezcan almacenadas —costosas de conservar, casi imposibles de buscar—, el sistema de Nomadic utiliza modelos de aprendizaje profundo para etiquetar, clasificar e indexar esos datos para que los ingenieros puedan encontrar lo que necesitan.

Según TechCrunch, la ronda semilla de 8,4 millones de dólares posiciona a Nomadic como infraestructura para el ecosistema de Physical AI en general —no solo para programas de AV, sino para cualquier sistema robótico que genere flujos continuos de sensores que deban convertirse en señal de entrenamiento.

Piense en ello como la diferencia entre un almacén lleno de cajas sin etiquetar y un sistema de inventario completamente indexado. Las imágenes existen de cualquier manera, pero solo una versión es operativamente útil. Esa analogía se desmorona a escala: el problema con los datos de AV no es solo el etiquetado, es el volumen absoluto combinado con el coste de la anotación humana y la escasez de casos límite críticos para la seguridad enterrados en horas de imágenes rutinarias.

¿Por qué es tan difícil gestionar los datos de AV y robots?

Un solo vehículo autónomo puede generar entre 1 y 40 terabytes de datos de sensores en bruto por día, dependiendo de su configuración de sensores (cámaras, LiDAR, radar, IMU). Una flota pequeña de diez vehículos en operación continua produce más datos por semana de los que la mayoría de las canalizaciones de datos empresariales fueron diseñadas para manejar.

El problema se agrava en dos direcciones. Primero, los costes de almacenamiento se acumulan rápidamente cuando se deben retener datos a escala de petabytes para entrenamiento de modelos, auditorías de seguridad y revisión regulatoria. Segundo, y más importante, la mayor parte de esos datos es operativamente inerte: no se pueden consultar, filtrar ni extraer sin un esfuerzo significativo de etiquetado manual.

Para los equipos de robótica en particular, esto crea un bucle de retroalimentación doloroso:

- Desplegar robots en el campo

- Recoger enormes volúmenes de datos de sensores

- Esforzarse por extraer los escenarios de fallo específicos, casos límite o eventos específicos del dominio necesarios para mejorar el modelo

- La iteración de entrenamiento se ralentiza

- El rendimiento de despliegue se estanca

Los flujos de trabajo de anotación humana —la solución tradicional— no escalan económicamente. Los costes de etiquetado para conjuntos de datos de conducción autónoma han oscilado históricamente entre 0,05 y 0,50 dólares por fotograma, y una sola hora de vídeo a 30 fps contiene 108.000 fotogramas. La economía desalienta activamente a los equipos a aprovechar todo el caudal de datos de sus flotas.

¿Cómo funciona el enfoque de aprendizaje profundo de Nomadic?

El sistema central de Nomadic aplica modelos de aprendizaje profundo a las imágenes en bruto para extraer automáticamente estructura semántica de los flujos de sensores. En lugar de requerir que los ingenieros etiqueten manualmente las imágenes antes de que sean buscables, la plataforma infiere lo que está sucediendo en una escena, etiqueta eventos y objetos, y organiza la salida en forma consultable.

La implicación práctica es significativa: los equipos de robótica y AV pueden emitir consultas en lenguaje natural o estructuradas —"muéstrame todas las instancias donde el vehículo se acercó a un peatón a menos de 2 metros bajo lluvia"— y obtener clips relevantes de millones de horas de imágenes sin revisión manual.

Este enfoque refleja lo que las bases de datos vectoriales modernas hacen con texto no estructurado, pero aplicado a datos de sensores multimodales que incluyen vídeo, nubes de puntos y flujos IMU. El modelo de aprendizaje profundo actúa como una capa de anotación automática, reduciendo drásticamente el coste por ejemplo etiquetado mientras aumenta la densidad de señal extraíble de los datos existentes.

Nomadic frente a enfoques tradicionales de canalización de datos

| Enfoque | Coste de anotación | Velocidad de consulta | Escalabilidad | Recuperación de casos límite |

|---|---|---|---|---|

| Etiquetado manual humano | Alto (0,05–0,50 $/fotograma) | Lenta | Baja | Dependiente del revisor |

| Etiquetado automático basado en reglas | Bajo | Rápida | Moderada | Omite eventos novedosos |

| Aprendizaje profundo de Nomadic | Bajo–Medio | Rápida | Alta | Fuerte en categorías entrenadas |

| Sin canalización (almacenamiento en bruto) | Ninguno | Ninguna | Alta (coste) | Cero |

El matiz que vale la pena señalar: la anotación basada en aprendizaje profundo hereda los puntos ciegos que existan en la distribución de entrenamiento del modelo. Para casos límite raros y críticos para la seguridad —exactamente los eventos más valiosos para el entrenamiento— un modelo que no haya visto suficientes ejemplos puede fallar al extraerlos de manera fiable. La propuesta de valor a largo plazo de Nomadic probablemente depende de qué tan bien se generalicen sus modelos en diversas implementaciones de robots y vehículos.

¿Qué significa esto para la robótica y la automatización?

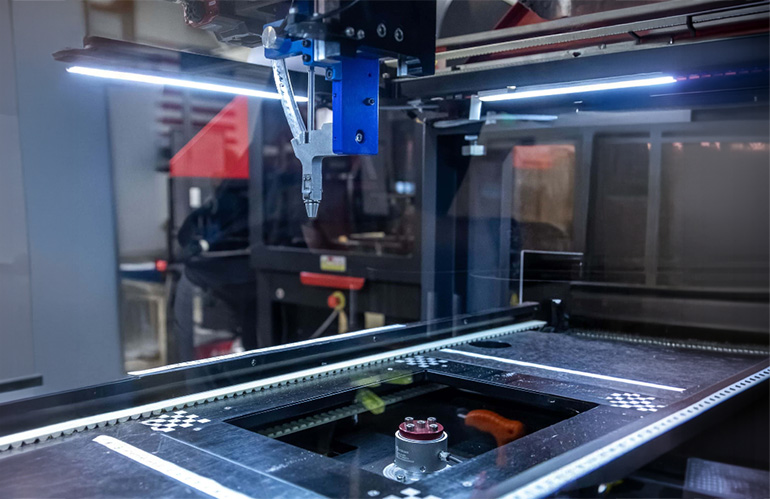

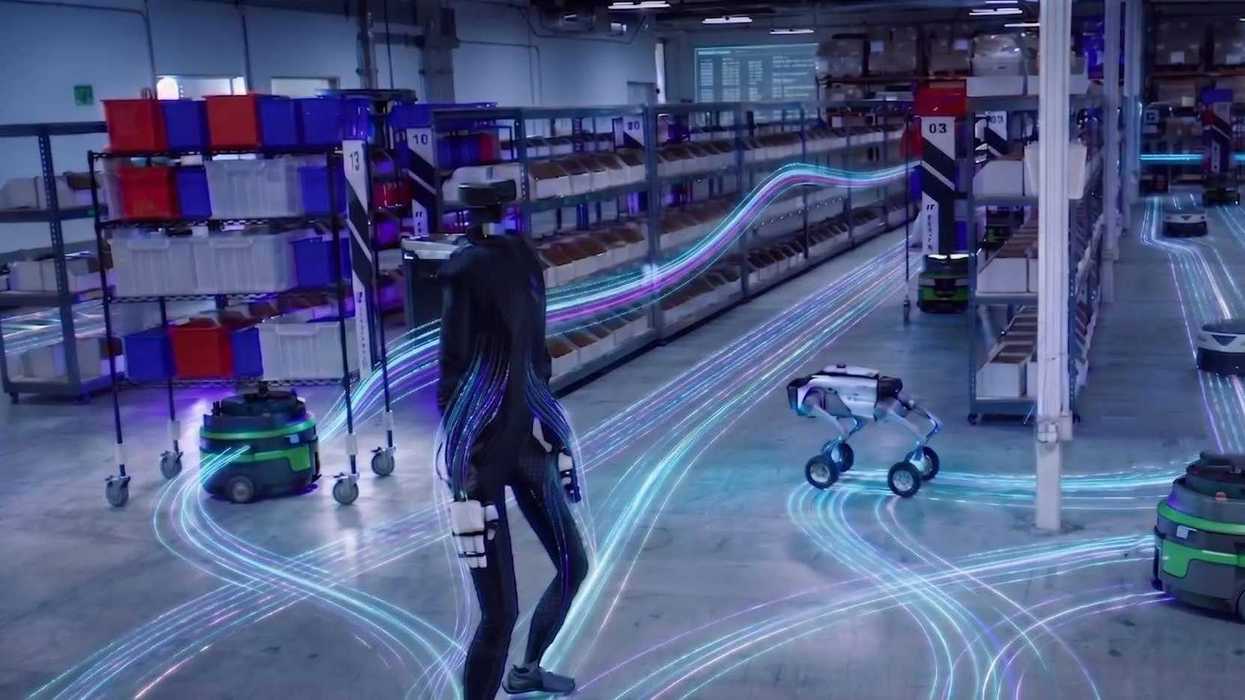

El cuello de botella de datos que Nomadic está atacando no es exclusivo de los vehículos autónomos. Es el mismo problema que enfrentan los AMR (robots móviles autónomos) de almacén, los robots de inspección industrial, los sistemas de automatización agrícola y los programas de robots humanoides —cualquier sistema de IA corpórea que genere datos perceptuales continuos en el mundo real.

Para los equipos que operan o adquieren flotas de robots, esto importa de dos maneras concretas.

Velocidad de entrenamiento: La tasa a la que un sistema robótico mejora está directamente limitada por la rapidez con que los equipos pueden extraer señal de entrenamiento significativa de los datos de despliegue. La infraestructura que acelera ese bucle —incluso por un factor de 2–3×— comprime el cronograma de mejora proporcionalmente.

Inteligencia de flota a escala: A medida que las flotas de robots crecen, el valor operativo de esos datos de sensores se extiende más allá del entrenamiento de modelos. Los datos estructurados permiten detección de anomalías, señales de mantenimiento predictivo y evaluación comparativa de rendimiento entre unidades —convirtiendo la propia flota de robots en un sistema que se autodocumenta continuamente.

Para los operadores que consideran implementaciones de robots usados o reacondicionados —donde las configuraciones de sensores pueden variar y los conjuntos de datos preexistentes están menos curados— plataformas como Nomadic se vuelven particularmente relevantes. Alimentar datos de campo de robots industriales usados de vuelta a canalizaciones de entrenamiento estructuradas ha sido históricamente un proceso manual y costoso. La infraestructura de estructuración automatizada cambia esa ecuación.

La cifra de 8,4 millones de dólares en financiación semilla también señala hacia dónde fluye la inversión en infraestructura en el ecosistema de Physical AI. El hardware —los robots mismos— recibe la atención. Pero la capa de datos entre el despliegue y la mejora del modelo es cada vez más donde se construye la ventaja competitiva y donde el capital comienza a concentrarse.

Los operadores que evalúan cobots usados en venta o construyen programas de automatización a pequeña escala deberían considerar los costes de la canalización de datos en el coste total de despliegue —una pregunta que Nomadic se está posicionando directamente para responder.

Preguntas frecuentes

Nomadic es una empresa de infraestructura de datos que utiliza aprendizaje profundo para convertir imágenes de sensores en bruto de vehículos autónomos y robots en conjuntos de datos estructurados y buscables. Resuelve el problema de escalado de los datos de sistemas autónomos, donde se generan vastos volúmenes de imágenes en el campo pero permanecen operativamente inutilizables sin anotación manual costosa.

¿Cuántos datos genera un vehículo autónomo por día?

Un solo vehículo autónomo genera típicamente entre 1 y 40 terabytes de datos de sensores en bruto por día, dependiendo de su configuración de cámaras, LiDAR y radar. Una flota de diez vehículos puede acumular cientos de terabytes semanalmente, haciendo que el procesamiento manual sea económicamente inviable a escala.

¿En qué se diferencia el enfoque de aprendizaje profundo de Nomadic del etiquetado manual?

El etiquetado manual cuesta entre 0,05 y 0,50 dólares por fotograma, lo que lo hace prohibitivamente caro a escala de flota. Nomadic aplica modelos de aprendizaje profundo para etiquetar e indexar imágenes automáticamente, permitiendo a los ingenieros consultar grandes conjuntos de datos sin revisión humana fotograma a fotograma —reduciendo significativamente el coste de anotación y el tiempo para obtener información.

¿El cuello de botella de datos afecta a robots más allá de los vehículos autónomos?

Sí. Cualquier sistema de IA corpórea —AMR de almacén, robots de inspección, automatización agrícola, plataformas humanoides— genera datos de sensores continuos que enfrentan los mismos desafíos de estructuración y recuperación. El problema escala con el tamaño de la flota y las horas de operación independientemente de la aplicación robótica específica.

¿Qué significa esta financiación para el ecosistema más amplio de Physical AI?

La ronda semilla de 8,4 millones de dólares señala un creciente reconocimiento de los inversores de que la capa de infraestructura de datos —no solo el hardware o los modelos centrales de IA— es un cuello de botella crítico en el desarrollo de sistemas autónomos. La inversión en infraestructura de canalizaciones de datos es un indicador adelantado de programas de despliegue de Physical AI en maduración.

Los datos residuales de los sistemas autónomos siempre han sido enormes. La pieza faltante ha sido la infraestructura para convertirlos en señal utilizable. El enfoque de Nomadic —aplicar aprendizaje profundo como capa de estructuración automática— aborda una limitación que afecta a toda organización que despliegue robots o vehículos a escala. La financiación semilla no resolverá el problema de la noche a la mañana, pero marca una apuesta direccional clara: la capa de datos es donde se construirá la próxima ventaja competitiva en Physical AI.

¿Es la infraestructura de la canalización de datos el cuello de botella que limita la mejora de su flota de robots, o el hardware sigue siendo la limitación?

Únete a la discusión

Is data pipeline infrastructure the bottleneck limiting your robot fleet — or is hardware still the constraint?