Les investisseurs ont versé 6,1 milliards de dollars dans les robots humanoïdes en une seule année récente — soit quatre fois le total de l'année précédente. Cette poussée de capitaux ne provient pas de meilleurs moteurs ou d'actionneurs moins chers. Elle vient d'une percée fondamentale dans la façon dont les robots apprennent, une percée qui se construit discrètement depuis 2015 et qui a désormais fait du robot de science-fiction une cible d'ingénierie plausible.

- Pourquoi l'apprentissage robotique a tout changé après 2015

- Des règles au renforcement : l'ère de la simulation

- Comment les modèles fondation ont donné du bon sens aux robots

- Les limites qui freinent encore l'industrie

- Ce que cela signifie pour les acheteurs de robotique et le marché du matériel

- Foire aux questions

Pourquoi l'apprentissage robotique a tout changé après 2015

Pendant la majeure partie de l'histoire de la robotique, l'intelligence signifiait des règles — des milliers d'instructions codées à la main par des ingénieurs pour couvrir chaque situation prévisible. Un bras robotique pliant du linge nécessitait une logique explicite pour l'orientation des manches, la rigidité du tissu, la détection du col et des dizaines de cas particuliers. L'ensemble de règles explosait en complexité avant même de devenir fiable.

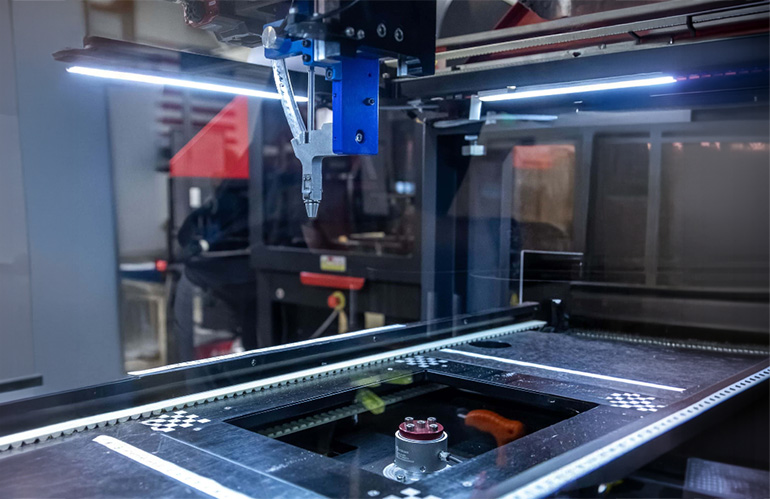

Cette approche a produit des robots industriels fiables pour des environnements structurés — lignes de soudage, cellules de pick-and-place, systèmes de convoyeurs — mais elle ne pouvait pas généraliser. Déplacez le même bras dans un contexte différent, changez l'éclairage, introduisez une nouvelle forme d'objet, et les performances s'effondraient immédiatement.

L'écart entre ce que les robots pouvaient faire et ce que les chercheurs rêvaient qu'ils puissent faire restait obstinément large. Puis, vers 2015, la méthodologie a changé.

Selon l'analyse approfondie de MIT Technology Review sur l'histoire contemporaine de l'apprentissage robotique, le changement crucial a été le passage du codage de règles à l'essai-erreur basé sur les données — puis, après 2022, aux modèles fondation d'IA qui ont appris à partir de données à l'échelle d'Internet plutôt que de simulations artisanales seules.

Des règles au renforcement : l'ère de la simulation

Vers 2015, les principaux laboratoires de robotique ont commencé à remplacer les règles écrites à la main par l'apprentissage par renforcement (RL) — une méthode d'entraînement où un agent IA reçoit des signaux de récompense pour les actions réussies et des signaux de pénalité pour les échecs, puis itère des millions de fois pour découvrir ses propres stratégies.

Le projet Dactyl d'OpenAI, une main robotique à cinq doigts entièrement entraînée en simulation, a démontré à la fois la puissance et la limitation centrale de cette approche. Dactyl a appris à manipuler de petits cubes en s'entraînant dans des environnements numériques — essentiellement un moteur physique virtuel — avant d'être déployé sur du matériel réel. Le problème : même des divergences mineures entre le monde simulé et la réalité physique entraînaient une dégradation brutale des performances.

La solution technique était la randomisation de domaine — l'introduction délibérée de variations aléatoires dans des millions d'environnements d'entraînement simulés. Les coefficients de friction, les conditions d'éclairage, les couleurs des objets et les textures de surface étaient tous variés aléatoirement afin que la politique entraînée soit suffisamment robuste pour gérer le désordre du monde réel. La technique a suffisamment bien fonctionné pour que Dactyl finisse par résoudre des cubes Rubik — bien que seulement 60 % du temps sur des mélanges standard, tombant à 20 % sur des configurations plus difficiles.

Ces chiffres comptent pour comprendre où en était le domaine à l'époque. Le RL entraîné en simulation produisait une dextérité véritablement impressionnante, mais la fiabilité était insuffisante pour un déploiement commercial. OpenAI a fermé sa division robotique en 2021, reflétant le plafond que la technique avait atteint.

Le fossé simulation-réalité : Défis techniques clés

| Défi | Description | Atténuation utilisée |

|---|---|---|

| Décalage visuel | Les couleurs et textures diffèrent de la simulation | Randomisation de domaine |

| Propriétés physiques | Friction, déformation non parfaitement modélisées | Paramètres physiques randomisés |

| Bruit des capteurs | Les vrais capteurs introduisent latence et erreur | Injection de bruit dans l'entraînement |

| Usure mécanique | Les actionneurs se dégradent avec le temps | Non résolu par le sim-to-real seul |

Comment les modèles fondation ont donné du bon sens aux robots

L'arrivée des grands modèles de langage a changé la robotique plus profondément que n'importe quelle avancée matérielle de la dernière décennie. L'idée clé était architecturale : les LLM apprennent en prédisant quel jeton (mot, sous-mot ou caractère) vient ensuite dans une séquence, en ingérant des corpus massifs de texte pour construire des représentations internes riches du langage et des connaissances du monde. Les roboticistes ont posé une question évidente mais transformative : cette même architecture pourrait-elle fonctionner si les jetons étaient des lectures de capteurs, des images de caméras et des positions articulaires au lieu de mots ?

La réponse de Google DeepMind a été RT-1 et son successeur RT-2 (Robotic Transformer). RT-1 a été entraîné sur 17 mois de données de téléopération couvrant 700 tâches distinctes, recevant des vues de caméra du robot et des états articulaires du bras en entrée et générant des commandes motrices en sortie. Sur les tâches qu'il avait vues pendant l'entraînement, il a atteint 97 % de succès. Sur des instructions entièrement nouvelles, il a encore réussi 76 % — une amélioration spectaculaire par rapport à tout ce que les approches uniquement basées sur la simulation avaient accompli.

RT-2 est allé plus loin en incorporant des données d'images et de texte à l'échelle d'Internet, donnant au robot une forme de bon sens ancré dans le monde visuel plus large plutôt que seulement le laboratoire de robotique. C'est le saut conceptuel clé : au lieu de programmer des robots avec des règles, ou de les entraîner uniquement sur des données spécifiques aux robots, les chercheurs ont découvert que les connaissances générales du monde — celles intégrées dans les modèles vision-langage lors du pré-entraînement à l'échelle du web — se transféraient étonnamment bien aux tâches de manipulation physique.

L'implication pratique est significative. Un robot qui a vu des millions d'images de cuisines, de tiroirs et de tasses lors du pré-entraînement arrive avec une compréhension contextuelle que les systèmes basés sur des règles ne pourraient jamais acquérir. Il n'est pas certain de quelle tasse l'humain veut, mais il a un a priori raisonnable. Cet a priori réduit considérablement la quantité de données d'entraînement spécifiques aux robots nécessaires pour atteindre des niveaux de performance utiles.

Les limites qui freinent encore l'industrie

L'excitation actuelle est réelle, mais il vaut la peine de cartographier ce qui reste véritablement non résolu. Les modèles fondation pour la robotique sont confrontés à un problème de données qui n'existe pas pour les modèles de langage sous la même forme. Les données textuelles sont abondantes, peu coûteuses et facilement extraites du web. Les données de démonstration robotique de haute qualité — diverses, physiquement ancrées et correctement étiquetées — sont coûteuses à collecter, dépendantes du matériel et difficiles à transférer entre différentes morphologies de robots.

Les premiers robots sociaux illustrent une limitation différente : la capacité sans fiabilité. Jibo, le robot social domestique développé par le MIT qui a levé 3,7 millions de dollars en crowdfunding et vendu à 749 $, avait une vision convaincante mais a finalement été miné par la technologie linguistique pré-LLM de son époque. Ses conversations reposaient sur des extraits de réponse scriptés qui devenaient rapidement répétitifs et superficiels. L'IA vocale d'aujourd'hui transformerait ce que Jibo aurait pu être — mais la nouvelle génération de jouets alimentés par l'IA introduit le risque inverse. Les systèmes scriptés ne pouvaient pas dérailler ; les systèmes d'IA générative le peuvent absolument, comme l'ont démontré des cas documentés de compagnons IA donnant des conseils dangereux aux enfants.

Le domaine a échangé un ensemble de limitations (rigidité, fragilité) contre un autre (imprévisibilité, incertitude sur la sécurité). Aucun des deux problèmes n'est entièrement résolu. Ce qui a changé, c'est que la trajectoire d'amélioration est désormais mesurablement plus raide.

Ce que cela signifie pour les acheteurs de robotique et le marché du matériel

La révolution de l'apprentissage IA n'est pas seulement une histoire académique — elle est déjà en train de remodeler les valorisations du matériel d'une manière qui importe aux acheteurs et opérateurs dès maintenant.

Les robots dont les capacités étaient verrouillées sur leur programmation d'origine se déprécient rapidement sur le marché actuel. Les bras industriels de deuxième génération avec des programmes de mouvement fixes voient leur valeur de revente diminuer alors que les acheteurs attendent de plus en plus d'adaptabilité. Pendant ce temps, les plateformes matérielles conçues pour exécuter des logiciels basés sur l'apprentissage — avec un calcul accessible, des API ouvertes et des charges utiles de capteurs suffisantes — conservent leur valeur plus solidement.

Pour les acheteurs qui évaluent des achats aujourd'hui, plusieurs implications se démarquent :

- L'extensibilité de la plateforme compte autant que la capacité actuelle. Un cobot qui exécute localement une inférence ML moderne aura une durée de vie utile plus longue qu'un autre verrouillé sur des environnements de programmation spécifiques au fournisseur.

- Le prix du matériel d'occasion reflète la préparation à l'IA. Les robots issus de plateformes ayant reçu des mises à jour logicielles majeures basées sur l'apprentissage conservent leur valeur ; ceux laissés pour compte par leurs fabricants sont fortement remisés.

- L'infrastructure de données est le nouveau différenciateur. Les acheteurs déployant plusieurs unités devraient planifier la collecte de données de téléopération dès le premier jour — ces données de démonstration deviennent le corpus d'entraînement pour des performances améliorées.

Pour les opérateurs envisageant un déploiement d'entrée de gamme, le marché actuel des robots industriels d'occasion offre un accès à du matériel capable à coût réduit, bien que les acheteurs doivent évaluer soigneusement les feuilles de route des mises à jour logicielles. De même, la catégorie des cobots en pleine croissance est particulièrement bien positionnée pour bénéficier du déploiement de modèles fondation, étant donné les contextes opérationnels intrinsèquement flexibles et proches des humains des cobots.

Foire aux questions

Le principal moteur a été la maturation des modèles fondation d'IA — en particulier la découverte que les modèles vision-langage entraînés sur des données à l'échelle d'Internet pouvaient être adaptés pour générer des commandes motrices robotiques avec une généralisation bien supérieure aux approches précédentes basées sur des règles ou uniquement sur la simulation. Les investissements ont bondi après que la recherche a démontré que des modèles comme RT-2 pouvaient effectuer des tâches nouvelles sans entraînement spécifique à la tâche, ouvrant une voie crédible vers des robots polyvalents. Les chiffres récents montrent un quadruplement des investissements d'une année sur l'autre, atteignant 6,1 milliards de dollars.

Qu'est-ce que la randomisation de domaine en robotique et pourquoi est-elle importante ?

La randomisation de domaine est une technique d'entraînement en simulation où des milliers d'environnements virtuels légèrement différents sont générés pendant l'entraînement — variant aléatoirement l'éclairage, la friction, les couleurs des objets et les paramètres physiques. Elle aborde le fossé sim-to-réalité (la dégradation des performances lorsque des politiques entraînées en simulation sont exécutées sur du matériel réel) en forçant la politique apprise à être robuste face à de nombreuses configurations possibles du monde. Le Dactyl d'OpenAI a utilisé cette approche pour résoudre un cube Rubik avec une main robotique, bien que les taux de succès aient plafonné à 60 % pour des niveaux de difficulté standard.

En quoi les modèles fondation pour la robotique diffèrent-ils des LLM standard ?

Les grands modèles de langage standard traitent les jetons de texte à la fois en entrée et en sortie. Les modèles fondation pour la robotique étendent cette architecture pour traiter les images de caméra, les lectures de capteurs de profondeur et les positions articulaires du robot comme jetons d'entrée supplémentaires, et les commandes de vitesse motrice comme jetons de sortie. La tâche de prédiction centrale — « que vient-il ensuite étant donné le contexte précédent ? » — reste structurellement similaire. L'avantage critique est que le pré-entraînement sur des données visuelles et linguistiques à l'échelle d'Internet donne à ces modèles des connaissances du monde et du bon sens que les seules données de démonstration robotique ne peuvent pas fournir efficacement.

Les robots adaptatifs par IA rendront-ils rapidement obsolètes les anciens robots à programme fixe ?

Pas immédiatement. Les robots industriels à programme fixe restent très rentables pour les tâches à volume élevé et faible variation comme le soudage et l'estampage, où l'adaptabilité n'apporte aucune valeur. La pression d'obsolescence est la plus élevée dans la logistique multi-SKU, l'assemblage léger et les environnements de service où la variabilité des tâches est inhérente. Les acheteurs doivent évaluer si leur profil de tâche spécifique bénéficie réellement de l'adaptabilité avant de supposer que les plateformes plus récentes capables d'IA justifient la prime de prix par rapport au matériel éprouvé et hérité.

Quels sont les principaux problèmes non résolus dans l'apprentissage robotique aujourd'hui ?

Trois défis restent significatifs : (1) le coût élevé et la disponibilité limitée de données de démonstration robotique diverses par rapport aux données textuelles pour les modèles de langage ; (2) l'imprévisibilité de sécurité des systèmes d'IA générative déployés dans des environnements physiques, en particulier ceux interagissant avec des populations vulnérables ; et (3) la manipulation dextre fiable — les tâches motrices fines comme enfiler des câbles ou manipuler des matériaux déformables déjouent encore la plupart des systèmes actuels dans des conditions du monde réel plutôt que dans des environnements de laboratoire contrôlés.

La révolution de l'apprentissage robotique est réelle, mais elle n'est pas terminée. Les modèles fondation ont brisé le plafond imposé par les systèmes basés sur des règles, et les chiffres d'investissement reflètent un progrès technologique authentique plutôt que de la pure spéculation. L'écart entre les robots de science-fiction et le matériel déployable s'est réduit davantage au cours des trois dernières années qu'au cours des trois décennies précédentes.

La prochaine contrainte n'est pas algorithmique. Ce sont les données, la validation de la sécurité et la fiabilité du matériel à grande échelle — les problèmes d'ingénierie difficiles que le financement seul ne peut accélérer au-delà d'un certain rythme.

Quelle approche d'apprentissage robotique — apprentissage par renforcement, modèles fondation ou données de téléopération — pensez-vous déterminera qui gagnera la course aux humanoïdes ?

Participez à la discussion

Which robot learning approach — RL, foundation models, or teleoperation data — will determine who wins the humanoid race?