Les véhicules autonomes et les robots génèrent plus de données de capteurs que la plupart des organisations ne peuvent réellement utiliser. Nomadic a levé 8,4 millions de dollars en financement d'amorçage pour y remédier — en construisant une couche d'infrastructure qui convertit les images brutes des véhicules autonomes et des robots en ensembles de données structurés et interrogeables grâce au deep learning, s'attaquant à un goulot d'étranglement qui freine silencieusement le développement des systèmes autonomes dans toute l'industrie.

Table des matières

- Que fait exactement Nomadic ?

- Pourquoi les données des véhicules autonomes et des robots sont-elles si difficiles à gérer ?

- Comment fonctionne l'approche deep learning de Nomadic ?

- Qu'est-ce que cela signifie pour la robotique et l'automatisation ?

- Foire aux questions

Que fait exactement Nomadic ?

Nomadic construit une plateforme d'infrastructure de données qui transforme les images vidéo brutes et les données de capteurs capturées par les véhicules autonomes et les robots en ensembles de données structurés et interrogeables. Au lieu de stocker des images brutes — coûteuses à conserver et presque impossibles à rechercher — le système de Nomadic utilise des modèles de deep learning pour étiqueter, classifier et indexer ces données afin que les ingénieurs puissent trouver ce dont ils ont besoin.

Selon TechCrunch, le tour de table d'amorçage de 8,4 millions de dollars positionne Nomadic comme une infrastructure pour la pile Physical AI au sens large — non seulement pour les programmes de véhicules autonomes, mais pour tout système robotique générant des flux de capteurs continus qui doivent être transformés en signal d'apprentissage.

Imaginez la différence entre un entrepôt rempli de boîtes non étiquetées et un système d'inventaire entièrement indexé. Les images existent dans les deux cas, mais seule une version est utile sur le plan opérationnel. Cette analogie a ses limites à grande échelle — le problème des données des véhicules autonomes n'est pas seulement l'étiquetage, c'est le volume combiné au coût de l'annotation humaine et à la rareté des cas limites critiques pour la sécurité enfouis dans des heures d'images de routine.

Pourquoi les données des véhicules autonomes et des robots sont-elles si difficiles à gérer ?

Un seul véhicule autonome peut générer entre 1 et 40 téraoctets de données brutes de capteurs par jour, selon sa configuration de capteurs — caméras, LiDAR, radar, IMU. Une petite flotte de dix véhicules en fonctionnement continu produit plus de données par semaine que la plupart des pipelines de données d'entreprise ne sont conçus pour en traiter.

Le problème se cumule dans deux directions. D'abord, les coûts de stockage s'accumulent rapidement lorsque des données à l'échelle du pétaoctet doivent être conservées pour l'apprentissage des modèles, les audits de sécurité et l'examen réglementaire. Ensuite, et plus important encore, la majeure partie de ces données est opérationnellement inerte — elle ne peut pas être interrogée, filtrée ou mise en surface sans un effort d'étiquetage manuel important.

Pour les équipes de robotique en particulier, cela crée une boucle de rétroaction douloureuse :

- Déployer des robots sur le terrain

- Collecter d'énormes volumes de données de capteurs

- Peiner à extraire les scénarios de défaillance, les cas limites ou les événements spécifiques au domaine nécessaires pour améliorer le modèle

- L'itération d'apprentissage ralentit

- Les performances de déploiement stagnent

Les workflows d'annotation humaine — la solution traditionnelle — ne passent pas à l'échelle économiquement. Les coûts d'étiquetage pour les ensembles de données de conduite autonome ont historiquement oscillé entre 0,05 $ et 0,50 $ par image, et une seule heure de vidéo à 30 images par seconde contient 108 000 images. L'économie décourage activement les équipes de tirer parti de l'intégralité des données générées par leurs flottes.

Comment fonctionne l'approche deep learning de Nomadic ?

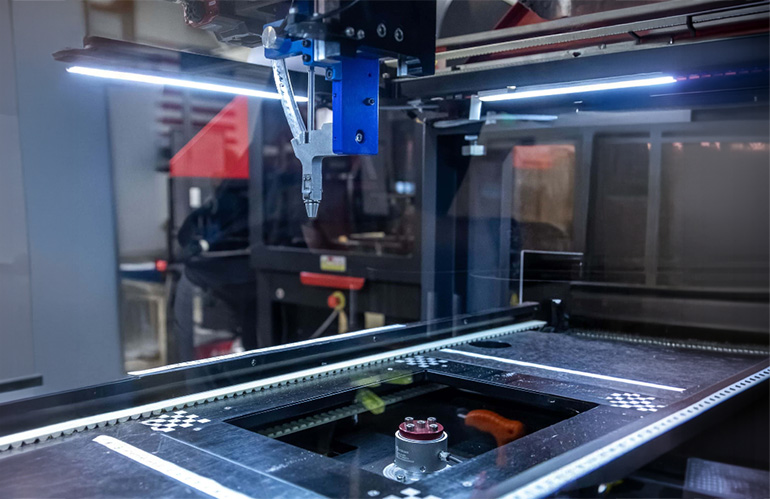

Le système central de Nomadic applique des modèles de deep learning aux images brutes pour extraire automatiquement une structure sémantique des flux de capteurs. Plutôt que d'obliger les ingénieurs à étiqueter manuellement les images avant qu'elles ne deviennent interrogeables, la plateforme déduit ce qui se passe dans une scène, étiquette les événements et les objets, et organise le résultat sous une forme interrogeable.

L'implication pratique est significative : les équipes de robotique et de véhicules autonomes peuvent formuler des requêtes en langage naturel ou structurées — « montrez-moi tous les cas où le véhicule s'est approché d'un piéton à moins de 2 mètres sous la pluie » — et faire remonter les séquences pertinentes à partir de millions d'heures d'images sans examen manuel.

Cette approche reflète ce que les bases de données vectorielles modernes font pour le texte non structuré, mais appliquée aux données multimodales des capteurs, y compris la vidéo, les nuages de points et les flux IMU. Le modèle de deep learning agit comme une couche d'annotation automatique, réduisant considérablement le coût par exemple étiqueté tout en augmentant la densité du signal extractible à partir des données existantes.

Nomadic vs. Approches traditionnelles des pipelines de données

| Approche | Coût d'annotation | Vitesse de requête | Évolutivité | Rappel des cas limites |

|---|---|---|---|---|

| Annotation humaine manuelle | Élevé (0,05–0,50 $/image) | Lent | Faible | Dépendant du relecteur |

| Auto-étiquetage par règles | Faible | Rapide | Modérée | Manque les événements nouveaux |

| Deep learning Nomadic | Faible–Moyen | Rapide | Élevée | Bon sur les catégories entraînées |

| Aucun pipeline (stockage brut) | Aucun | Aucune | Élevée (coût) | Zéro |

La mise en garde mérite d'être notée : l'annotation basée sur le deep learning hérite des angles morts de la distribution d'apprentissage du modèle. Pour les cas limites rares et critiques pour la sécurité — exactement les événements les plus précieux pour l'apprentissage — un modèle qui n'a pas vu assez d'exemples peut encore ne pas les faire remonter de manière fiable. La proposition de valeur à long terme de Nomadic dépendra probablement de la capacité de ses modèles à généraliser sur des déploiements divers de robots et de véhicules.

Qu'est-ce que cela signifie pour la robotique et l'automatisation ?

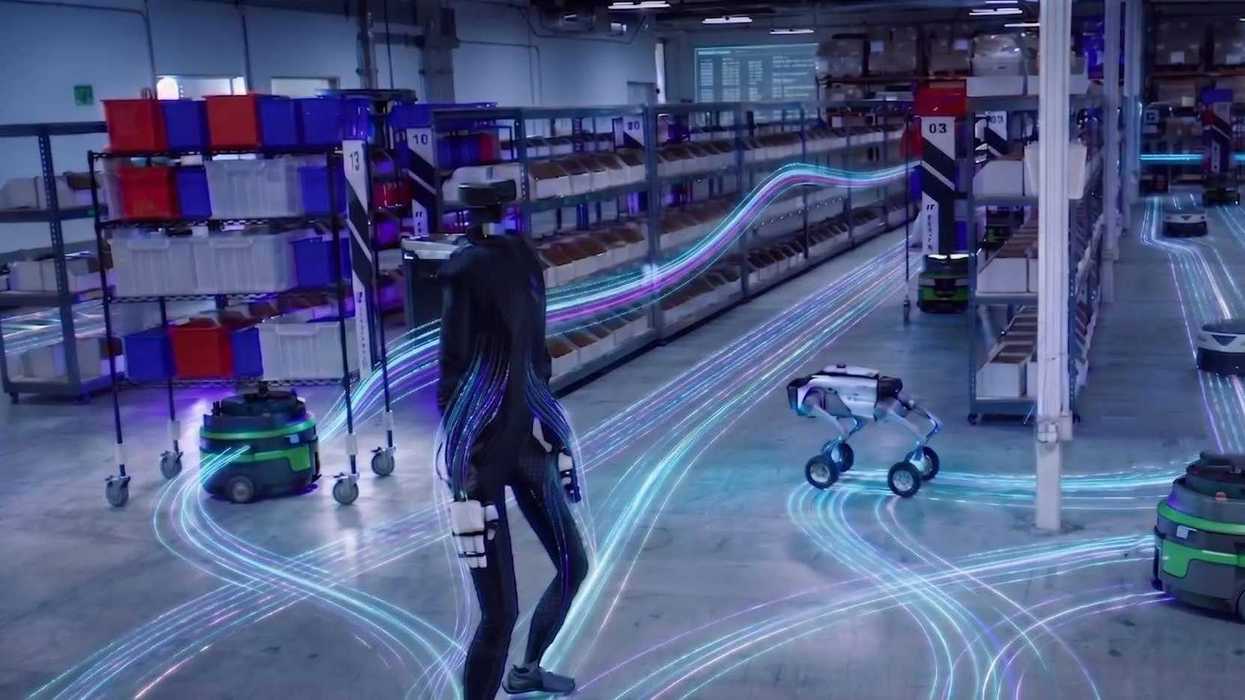

Le goulot d'étranglement des données auquel Nomadic s'attaque n'est pas propre aux véhicules autonomes. C'est le même problème auquel sont confrontés les AMR (robots mobiles autonomes) d'entrepôt, les robots d'inspection industrielle, les systèmes d'automatisation agricole et les programmes de robots humanoïdes — tout système d'IA incarné qui génère des données perceptuelles continues dans le monde réel.

Pour les équipes qui exploitent ou achètent des flottes de robots, cela compte de deux manières concrètes.

Vitesse d'apprentissage : Le rythme auquel un système robotique s'améliore est directement contraint par la rapidité avec laquelle les équipes peuvent extraire un signal d'apprentissage significatif des données de déploiement. Une infrastructure qui accélère cette boucle — même d'un facteur 2 à 3 — comprime proportionnellement le calendrier d'amélioration.

Intelligence de flotte à grande échelle : À mesure que les flottes de robots grandissent, la valeur opérationnelle de ces données de capteurs dépasse l'apprentissage des modèles. Les données structurées permettent la détection d'anomalies, les signaux de maintenance prédictive et l'analyse comparative des performances entre unités — transformant la flotte elle-même en un système qui s'auto-documente en continu.

Pour les opérateurs qui envisagent des déploiements de robots d'occasion ou reconditionnés — où les configurations de capteurs peuvent varier et les ensembles de données préexistants sont moins organisés — des plateformes comme Nomadic deviennent particulièrement pertinentes. Alimenter les pipelines d'apprentissage structuré avec des données de terrain provenant de robots industriels d'occasion a historiquement été un processus manuel et coûteux. Une infrastructure de structuration automatique change cette donne.

Le chiffre de 8,4 millions de dollars en amorçage indique également où les investissements dans l'infrastructure de la pile Physical AI se dirigent. Le matériel — les robots eux-mêmes — attire l'attention. Mais la couche de données entre le déploiement et l'amélioration du modèle est de plus en plus là où l'avantage concurrentiel se construit et où le capital commence à se concentrer.

Les opérateurs qui évaluent des cobots d'occasion à vendre ou qui mettent en place des programmes d'automatisation à petite échelle devraient intégrer les coûts du pipeline de données dans le coût total de déploiement — une question à laquelle Nomadic se positionne directement pour répondre.

Foire aux questions

Nomadic est une entreprise d'infrastructure de données qui utilise le deep learning pour convertir les images brutes de capteurs des véhicules autonomes et des robots en ensembles de données structurés et interrogeables. Elle résout le problème de passage à l'échelle des données des systèmes autonomes — où d'énormes volumes d'images sont générés sur le terrain mais restent opérationnellement inutilisables sans annotation manuelle coûteuse.

Quelle quantité de données un véhicule autonome génère-t-il par jour ?

Un seul véhicule autonome génère typiquement entre 1 et 40 téraoctets de données brutes de capteurs par jour, selon sa configuration de caméras, LiDAR et radar. Une flotte de dix véhicules peut accumuler des centaines de téraoctets par semaine, rendant le traitement manuel économiquement intenable à grande échelle.

En quoi l'approche deep learning de Nomadic diffère-t-elle de l'étiquetage manuel ?

L'étiquetage manuel coûte entre 0,05 $ et 0,50 $ par image, ce qui le rend prohibitif à l'échelle d'une flotte. Nomadic applique des modèles de deep learning pour étiqueter et indexer automatiquement les images, permettant aux ingénieurs d'interroger de grands ensembles de données sans examen image par image — réduisant considérablement le coût d'annotation et le temps nécessaire pour obtenir des informations.

Le goulot d'étranglement des données affecte-t-il les robots autres que les véhicules autonomes ?

Oui. Tout système d'IA incarné — AMR d'entrepôt, robots d'inspection, automatisation agricole, plates-formes humanoïdes — génère des données de capteurs continues qui rencontrent les mêmes défis de structuration et de récupération. Le problème s'aggrave avec la taille de la flotte et les heures d'opération, quelle que soit l'application robotique spécifique.

Que signifie ce financement pour l'écosystème Physical AI au sens large ?

Le tour d'amorçage de 8,4 millions de dollars signale une reconnaissance croissante des investisseurs que la couche d'infrastructure de données — et non seulement le matériel ou les modèles d'IA de base — est un goulot d'étranglement critique dans le développement des systèmes autonomes. L'investissement dans l'infrastructure des pipelines de données est un indicateur avancé de la maturation des programmes de déploiement de Physical AI.

Les données produites en continu par les systèmes autonomes ont toujours été énormes. L'élément manquant a été l'infrastructure pour les transformer en signal utilisable. L'approche de Nomadic — appliquer le deep learning comme couche de structuration automatique — répond à une contrainte qui affecte toute organisation déployant des robots ou des véhicules à grande échelle. Le financement d'amorçage ne résoudra pas le problème du jour au lendemain, mais il marque un pari directionnel clair : la couche de données est l'endroit où le prochain avantage concurrentiel dans le Physical AI se construit.

L'infrastructure du pipeline de données est-elle le goulot d'étranglement qui limite l'amélioration de votre flotte de robots — ou le matériel reste-t-il la contrainte ?

Participez à la discussion

Is data pipeline infrastructure the bottleneck limiting your robot fleet — or is hardware still the constraint?